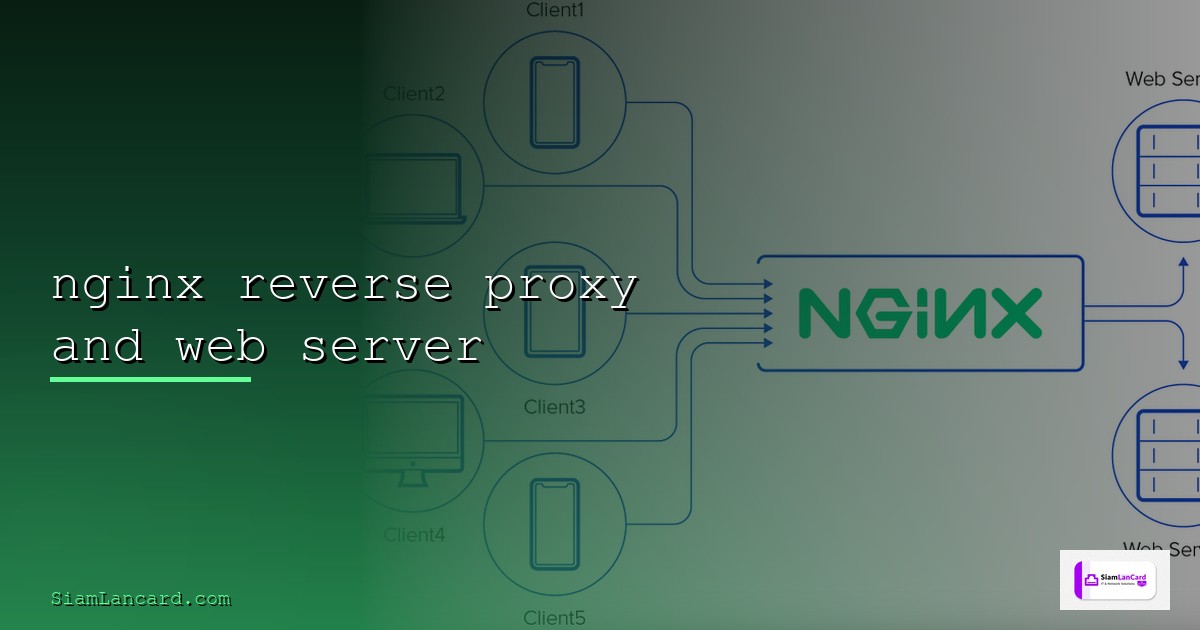

เว็บไซต์ของคุณเติบโตไม่หยุดหย่อนใช่ไหมครับ? ปัญหาคอขวด, ประสิทธิภาพตก หรือการรับมือกับผู้ใช้งานจำนวนมหาศาล คือสิ่งที่ผู้ดูแลระบบทุกคนต้องเจอครับ เมื่อแอปพลิเคชันหรือเว็บไซต์ของคุณได้รับความนิยมมากขึ้น การมีเซิร์ฟเวอร์เพียงตัวเดียวย่อมไม่เพียงพอต่อการรองรับโหลดที่เพิ่มขึ้นอย่างรวดเร็ว ทั้งยังมีความเสี่ยงสูงหากเซิร์ฟเวอร์นั้นเกิดล่มขึ้นมา ระบบทั้งหมดก็จะหยุดทำงานทันทีครับ นี่คือจุดที่แนวคิดของ Reverse Proxy และ Load Balancing เข้ามามีบทบาทสำคัญ และ Nginx ก็เป็นหนึ่งในเครื่องมือที่ได้รับความไว้วางใจและใช้งานอย่างแพร่หลายทั่วโลกในภารกิจนี้ครับ

บทความนี้จะเจาะลึกถึงวิธีการตั้งค่า Nginx ให้ทำงานเป็น Reverse Proxy และ Load Balancer เพื่อกระจายภาระงานไปยังเซิร์ฟเวอร์ Backend หลายตัวได้อย่างมีประสิทธิภาพสูงสุด ไม่ว่าคุณจะเป็นนักพัฒนา, ผู้ดูแลระบบ หรือเจ้าของธุรกิจที่ต้องการเพิ่มความเสถียรและความสามารถในการปรับขนาดของระบบ เราจะพาคุณไปทำความเข้าใจตั้งแต่พื้นฐานจนถึงการตั้งค่าขั้นสูง พร้อมตัวอย่างโค้ดที่ใช้งานได้จริง เพื่อให้คุณสามารถนำไปปรับใช้กับระบบของคุณได้ทันทีครับ มาเริ่มกันเลย!

สารบัญ

- ทำความเข้าใจ Nginx, Reverse Proxy และ Load Balancing

- ทำไมต้องใช้ Nginx สำหรับ Reverse Proxy Load Balancing?

- หลักการทำงานของ Nginx Reverse Proxy Load Balancing

- เตรียมความพร้อมก่อนการตั้งค่า

- ขั้นตอนการตั้งค่า Nginx Reverse Proxy Load Balancing (ภาคปฏิบัติ)

- ตัวอย่างการตั้งค่า Load Balancing Algorithms ยอดนิยม

- ฟีเจอร์เพิ่มเติมและเทคนิคขั้นสูง

- การตรวจสอบและแก้ไขปัญหาเบื้องต้น (Troubleshooting)

- เปรียบเทียบ Load Balancing Algorithms ที่แตกต่างกัน

- คำถามที่พบบ่อย (FAQ)

- สรุปและ Call to Action

ทำความเข้าใจ Nginx, Reverse Proxy และ Load Balancing

ก่อนที่เราจะลงมือตั้งค่า เรามาทำความเข้าใจแนวคิดพื้นฐานเหล่านี้กันก่อนครับ เพื่อให้เห็นภาพรวมและประโยชน์ของการใช้งานได้อย่างชัดเจน

Nginx คืออะไร?

Nginx (อ่านว่า “Engine-X”) คือซอฟต์แวร์โอเพนซอร์สที่มีประสิทธิภาพสูง สามารถทำหน้าที่ได้หลากหลาย ไม่ว่าจะเป็น Web Server, Reverse Proxy, Load Balancer, Mail Proxy และ HTTP Cache ครับ Nginx ถูกออกแบบมาเพื่อจัดการกับการเชื่อมต่อพร้อมกันจำนวนมากได้อย่างมีประสิทธิภาพ ใช้ทรัพยากรระบบน้อย ทำให้เหมาะสำหรับการใช้งานในสภาพแวดล้อมที่มีการรับส่งข้อมูลปริมาณสูง ซึ่งเป็นเหตุผลที่เว็บไซต์ขนาดใหญ่จำนวนมากเลือกใช้ Nginx เป็นส่วนสำคัญในโครงสร้างพื้นฐานของตนเองครับ

Reverse Proxy คืออะไร?

ลองจินตนาการว่าคุณมีเว็บไซต์ที่กำลังรันอยู่บนเซิร์ฟเวอร์ Backend จำนวนหนึ่งครับ แทนที่จะให้ผู้ใช้งานเชื่อมต่อตรงไปยังเซิร์ฟเวอร์เหล่านั้น Reverse Proxy จะทำหน้าที่เป็นตัวกลาง โดยเป็นจุดแรกที่ผู้ใช้งานจากภายนอกจะเข้ามาถึงครับ

Reverse Proxy คือเซิร์ฟเวอร์ที่อยู่ด้านหน้าของ Web Server (Backend Server) หนึ่งตัวหรือมากกว่า ทำหน้าที่รับคำขอจาก Client (ผู้ใช้งาน) และส่งต่อคำขอเหล่านั้นไปยัง Backend Server ที่เหมาะสม จากนั้นก็รับผลลัพธ์จาก Backend Server กลับมาส่งให้ Client ครับ

ประโยชน์ของ Reverse Proxy:

- เพิ่มความปลอดภัย: ซ่อน IP Address และรายละเอียดของ Backend Servers จากผู้ใช้งานภายนอก ทำให้แฮกเกอร์เข้าถึงเซิร์ฟเวอร์จริงได้ยากขึ้นครับ

- จัดการโหลด: เป็นจุดเริ่มต้นในการกระจายโหลดไปยัง Backend Servers หลายตัว (Load Balancing)

- SSL/TLS Termination: จัดการการเข้ารหัส/ถอดรหัส SSL/TLS เพียงจุดเดียวที่ Reverse Proxy ช่วยลดภาระงานของ Backend Servers

- Caching: สามารถแคชเนื้อหาบางอย่างไว้ที่ Reverse Proxy เพื่อลดการร้องขอไปยัง Backend Servers และเพิ่มความเร็วในการตอบสนองครับ

- Compression: บีบอัดข้อมูลก่อนส่งกลับไปยัง Client เพื่อลดปริมาณการส่งข้อมูล

Load Balancing คืออะไร?

เมื่อคุณมี Backend Servers มากกว่าหนึ่งตัว การส่งคำขอทั้งหมดไปยังเซิร์ฟเวอร์ใดเซิร์ฟเวอร์หนึ่งย่อมไม่ใช่ทางออกที่ดีครับ Load Balancing คือเทคนิคที่ใช้ในการกระจายภาระงาน (Traffic) อย่างชาญฉลาดไปยังเซิร์ฟเวอร์หลายตัว เพื่อเพิ่มประสิทธิภาพ, ความน่าเชื่อถือ และความสามารถในการปรับขนาดของระบบครับ

Load Balancer คืออุปกรณ์หรือซอฟต์แวร์ที่กระจายคำขอจาก Client ไปยัง Backend Servers หลายตัว เพื่อให้แน่ใจว่าไม่มีเซิร์ฟเวอร์ใดเซิร์ฟเวอร์หนึ่งทำงานหนักเกินไป และใช้ทรัพยากรของเซิร์ฟเวอร์ทั้งหมดได้อย่างมีประสิทธิภาพสูงสุดครับ

ประโยชน์ของ Load Balancing:

- เพิ่มความสามารถในการปรับขนาด (Scalability): สามารถเพิ่ม Backend Servers ได้ง่ายๆ เมื่อมีความต้องการเพิ่มขึ้น

- เพิ่มความพร้อมใช้งาน (High Availability): หาก Backend Server ตัวใดตัวหนึ่งล่ม Load Balancer จะหยุดส่ง Traffic ไปยังเซิร์ฟเวอร์นั้นและเปลี่ยนไปส่งยังเซิร์ฟเวอร์ที่ยังทำงานอยู่แทน ทำให้ระบบยังคงใช้งานได้ต่อเนื่องครับ

- เพิ่มประสิทธิภาพ (Performance): กระจายโหลด ทำให้แต่ละเซิร์ฟเวอร์ไม่ต้องทำงานหนักเกินไป ส่งผลให้การตอบสนองรวดเร็วขึ้น

- ลดเวลา Downtime: สามารถทำการบำรุงรักษาหรืออัปเดต Backend Server บางตัวได้โดยไม่กระทบต่อการทำงานของระบบโดยรวม

ทำไมต้องใช้ Nginx สำหรับ Reverse Proxy Load Balancing?

มีเหตุผลหลายประการที่ทำให้ Nginx เป็นตัวเลือกที่ยอดเยี่ยมสำหรับการทำ Reverse Proxy และ Load Balancing ครับ

- ประสิทธิภาพสูง: Nginx มีสถาปัตยกรรมแบบ Asynchronous, Event-driven ทำให้สามารถจัดการกับการเชื่อมต่อพร้อมกันจำนวนมากได้อย่างมีประสิทธิภาพสูง โดยใช้หน่วยความจำและ CPU น้อยกว่า Web Server แบบดั้งเดิมครับ

- ความเสถียรและความน่าเชื่อถือ: Nginx เป็นซอฟต์แวร์ที่ได้รับการพิสูจน์แล้วว่ามีความเสถียรและทนทาน เหมาะสำหรับสภาพแวดล้อมที่มีการจราจรหนาแน่น

- ความยืดหยุ่นในการกำหนดค่า: Nginx มีไฟล์คอนฟิกที่เข้าใจง่ายและมีความยืดหยุ่นสูง ทำให้สามารถกำหนดค่าได้อย่างละเอียดเพื่อตอบสนองความต้องการที่หลากหลายครับ

- ฟีเจอร์ที่ครบครัน: นอกจาก Reverse Proxy และ Load Balancing แล้ว Nginx ยังรองรับฟีเจอร์อื่นๆ เช่น SSL/TLS Termination, Caching, Gzip Compression, Health Checks และ Sticky Sessions (บางฟีเจอร์ขั้นสูงอาจต้องใช้ Nginx Plus)

- ชุมชนและการสนับสนุน: มีชุมชนผู้ใช้งานขนาดใหญ่และเอกสารประกอบที่ครบถ้วน ทำให้ง่ายต่อการหาข้อมูลและการแก้ไขปัญหาครับ

- การปรับขนาดที่ง่าย: การเพิ่มหรือลด Backend Servers ทำได้ง่าย เพียงแค่แก้ไขไฟล์คอนฟิกของ Nginx ครับ

หลักการทำงานของ Nginx Reverse Proxy Load Balancing

หลักการทำงานโดยรวมของ Nginx ที่ทำหน้าที่เป็น Reverse Proxy และ Load Balancer มีดังนี้ครับ

- Client Request: ผู้ใช้งาน (Client) ส่งคำขอ HTTP/HTTPS ไปยัง Nginx Server (ซึ่งเป็น Reverse Proxy)

- Nginx Intercepts: Nginx รับคำขอและพิจารณาว่าจะส่งคำขอไปที่ใด โดยอ้างอิงจากกฎการกำหนดค่าที่ตั้งไว้

- Load Balancing Decision: Nginx ใช้ Algorithm การทำ Load Balancing ที่กำหนดไว้ (เช่น Round Robin, Least Connections) เพื่อเลือก Backend Server ที่เหมาะสมที่สุดในการจัดการคำขอ

- Forward Request: Nginx ส่งต่อคำขอไปยัง Backend Server ที่ถูกเลือก

- Backend Server Processes: Backend Server ประมวลผลคำขอและส่งผลลัพธ์กลับมายัง Nginx

- Nginx Returns Response: Nginx รับผลลัพธ์จาก Backend Server และส่งกลับไปยัง Client ที่ร้องขอมาครับ

ประเภทของ Load Balancing Algorithms

Nginx รองรับ Algorithm การทำ Load Balancing หลายแบบ แต่ละแบบมีข้อดีและข้อเสียที่แตกต่างกันไปครับ

- Round Robin: เป็น Algorithm ที่เรียบง่ายที่สุด Nginx จะส่งคำขอไปยัง Backend Servers ทีละตัวตามลำดับวนไปเรื่อยๆ เช่น Server 1, Server 2, Server 3, Server 1, Server 2, Server 3… เหมาะสำหรับ Backend Servers ที่มีประสิทธิภาพใกล้เคียงกันครับ

- Least Connections: Nginx จะตรวจสอบจำนวนการเชื่อมต่อที่กำลังใช้งานอยู่ของแต่ละ Backend Server และส่งคำขอใหม่ไปยังเซิร์ฟเวอร์ที่มีการเชื่อมต่อน้อยที่สุด วิธีนี้ช่วยให้เซิร์ฟเวอร์ที่มีภาระงานน้อยกว่าได้รับ Traffic มากขึ้น ทำให้การกระจายโหลดเป็นไปอย่างมีสมดุลมากขึ้นครับ

- IP Hash: คำขอจะถูกกระจายตาม IP Address ของ Client โดยใช้ฟังก์ชัน Hash ทำให้ Client เดิมมักจะถูกส่งไปยัง Backend Server ตัวเดิมเสมอ วิธีนี้มีประโยชน์สำหรับแอปพลิเคชันที่ต้องการ Session Persistence โดยไม่ต้องใช้ Cookie ครับ

- Weighted Round Robin: คล้ายกับ Round Robin แต่คุณสามารถกำหนด “น้ำหนัก” (weight) ให้กับแต่ละ Backend Server ได้ Server ที่มีน้ำหนักมากก็จะได้รับคำขอมากขึ้นตามสัดส่วน เหมาะสำหรับกรณีที่ Backend Servers มีประสิทธิภาพไม่เท่ากันครับ

- Generic Hash: คล้ายกับ IP Hash แต่สามารถใช้ตัวแปรอื่นในการ Hash ได้ เช่น URI หรือ Argument ของคำขอ

- Least Time (Nginx Plus): เป็นฟีเจอร์ที่มีใน Nginx Plus (เวอร์ชันเสียเงิน) Nginx จะส่งคำขอไปยัง Backend Server ที่มีเวลาตอบสนองโดยเฉลี่ยน้อยที่สุดและมีจำนวนการเชื่อมต่อน้อยที่สุดครับ

เตรียมความพร้อมก่อนการตั้งค่า

เพื่อให้การตั้งค่า Nginx Reverse Proxy Load Balancing เป็นไปอย่างราบรื่น เรามาเตรียมความพร้อมในส่วนต่างๆ กันก่อนครับ

ข้อกำหนดเบื้องต้น

- Nginx Server: เซิร์ฟเวอร์ที่ติดตั้ง Nginx และจะทำหน้าที่เป็น Reverse Proxy/Load Balancer (เช่น ติดตั้งบน Ubuntu, CentOS หรือระบบปฏิบัติการ Linux อื่นๆ)

- Backend Servers: เซิร์ฟเวอร์ Web Application อย่างน้อย 2 ตัว (เช่น Apache, Nginx, Node.js, PHP-FPM) ที่รันแอปพลิเคชันเดียวกัน และพร้อมสำหรับการรับ Traffic

- IP Address: IP Address ของ Nginx Server และ Backend Servers แต่ละตัว

- ความรู้พื้นฐาน Linux: สามารถใช้คำสั่งพื้นฐานใน Terminal ได้

- สิทธิ์ผู้ดูแลระบบ: สิทธิ์ sudo หรือ root ในการแก้ไขไฟล์คอนฟิกและติดตั้งซอฟต์แวร์

โครงสร้าง Network (ตัวอย่าง)

สมมติว่าเรามีโครงสร้าง Network ดังนี้ครับ

- Nginx Load Balancer Server: IP

192.168.1.100(หรือ Public IP ของเว็บไซต์คุณ) - Backend Server 1: IP

192.168.1.101(รันแอปพลิเคชันบน Port 8080) - Backend Server 2: IP

192.168.1.102(รันแอปพลิเคชันบน Port 8080) - Domain Name:

yourwebsite.com

ในตัวอย่างนี้ เราจะให้ Nginx Server รับ Traffic ที่ Port 80 (HTTP) และ 443 (HTTPS) แล้วส่งต่อไปยัง Backend Servers ที่รันแอปพลิเคชันบน Port 8080 ครับ

DNS Configuration

คุณจะต้องชี้ Record ของ Domain Name ของคุณ (เช่น yourwebsite.com หรือ www.yourwebsite.com) ให้ไปยัง IP Address ของ Nginx Load Balancer Server ครับ

yourwebsite.com A 192.168.1.100

www.yourwebsite.com CNAME yourwebsite.com

หากคุณใช้ Public IP ของ Nginx Server อย่าลืมชี้ DNS ไปยัง Public IP นั้นด้วยนะครับ

ขั้นตอนการตั้งค่า Nginx Reverse Proxy Load Balancing (ภาคปฏิบัติ)

มาถึงส่วนที่สำคัญที่สุดครับ เราจะมาลงมือตั้งค่า Nginx ให้ทำงานเป็น Reverse Proxy และ Load Balancer กันทีละขั้นตอนครับ

การติดตั้ง Nginx (สำหรับผู้ที่ยังไม่มี)

หากคุณยังไม่ได้ติดตั้ง Nginx บนเซิร์ฟเวอร์ของคุณ สามารถติดตั้งได้ตามระบบปฏิบัติการที่คุณใช้งานครับ

สำหรับ Ubuntu/Debian:

sudo apt update

sudo apt install nginx -y

sudo systemctl enable nginx

sudo systemctl start nginx

สำหรับ CentOS/RHEL:

sudo yum install epel-release -y

sudo yum install nginx -y

sudo systemctl enable nginx

sudo systemctl start nginx

หลังจากติดตั้งเสร็จสิ้น ให้ตรวจสอบสถานะของ Nginx ว่าทำงานอยู่หรือไม่ครับ

sudo systemctl status nginx

และอย่าลืมเปิด Port 80 และ 443 บน Firewall ของ Nginx Server ด้วยนะครับ (ตัวอย่างสำหรับ UFW บน Ubuntu)

sudo ufw allow 'Nginx HTTP'

sudo ufw allow 'Nginx HTTPS'

sudo ufw enable

การกำหนดค่า Backend Servers

บน Backend Servers ทั้งสองตัว (192.168.1.101 และ 192.168.1.102) ตรวจสอบให้แน่ใจว่า Web Application ของคุณรันอยู่และสามารถเข้าถึงได้จาก Nginx Server ครับ

ตัวอย่างเช่น หากคุณมี Node.js App ที่รันบน Port 8080 หรือ Apache ที่รันเว็บไซต์ของคุณปกติที่ Port 80 แต่เราต้องการให้ Nginx เข้าถึงที่ Port อื่นเพื่อความชัดเจนในการแยกส่วนครับ

เพื่อให้เห็นความแตกต่างเมื่อทดสอบ คุณอาจจะตั้งค่าให้ Backend Server แต่ละตัวแสดงผลข้อความที่แตกต่างกัน เช่น “Hello from Server 1” และ “Hello from Server 2” ครับ

การตั้งค่า Nginx สำหรับ Reverse Proxy และ Load Balancing

ไฟล์คอนฟิกหลักของ Nginx มักจะอยู่ที่ /etc/nginx/nginx.conf ครับ แต่เราจะสร้างไฟล์คอนฟิกใหม่ในไดเรกทอรี /etc/nginx/conf.d/ หรือ /etc/nginx/sites-available/ เพื่อความเป็นระเบียบเรียบร้อยครับ

สร้างไฟล์คอนฟิกใหม่ เช่น /etc/nginx/conf.d/yourwebsite.conf

sudo nano /etc/nginx/conf.d/yourwebsite.conf

จากนั้นเพิ่มโค้ดด้านล่างนี้ครับ

# กำหนด upstream block สำหรับกลุ่ม Backend Servers

# ที่เราต้องการทำ Load Balancing

upstream backend_servers {

# Algorithm: Round Robin (ค่าเริ่มต้น ถ้าไม่ระบุ)

server 192.168.1.101:8080;

server 192.168.1.102:8080;

# สามารถเพิ่ม server อื่นๆ ได้ที่นี่

# server 192.168.1.103:8080;

# สำหรับการตั้งค่าขั้นสูง (เช่น Health Checks)

# max_fails=3 fail_timeout=30s;

}

# กำหนด server block สำหรับ Nginx Reverse Proxy

server {

listen 80; # Nginx จะรอรับคำขอที่ Port 80 (HTTP)

server_name yourwebsite.com www.yourwebsite.com; # Domain ของคุณ

# บันทึก Access Log และ Error Log

access_log /var/log/nginx/yourwebsite.access.log;

error_log /var/log/nginx/yourwebsite.error.log;

location / {

# ส่งต่อคำขอไปยังกลุ่ม backend_servers ที่เรากำหนดไว้

proxy_pass http://backend_servers;

# ตั้งค่า Header เพื่อส่งข้อมูลที่สำคัญไปยัง Backend Servers

# ซึ่ง Backend Servers อาจใช้ข้อมูลเหล่านี้ เช่น IP จริงของผู้ใช้งาน

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

# ตั้งค่า Timeout (optional)

proxy_connect_timeout 60s;

proxy_send_timeout 60s;

proxy_read_timeout 60s;

# ป้องกันไม่ให้ Nginx Cache Content (ถ้าต้องการให้ Backend จัดการ Caching)

proxy_no_cache $http_pragma $http_authorization;

proxy_buffering off;

}

# สำหรับการจัดการ Error Pages (optional)

error_page 500 502 503 504 /50x.html;

location = /50x.html {

root /usr/share/nginx/html;

}

}

คำอธิบายส่วนต่างๆ ของคอนฟิก:

upstream backend_servers { ... }: ส่วนนี้คือหัวใจของการทำ Load Balancing ครับ เรากำหนดชื่อกลุ่มของ Backend Servers ว่าbackend_serversและระบุ IP Address พร้อม Port ของ Backend Servers แต่ละตัวserver 192.168.1.101:8080;: ระบุ Backend Server แต่ละตัว Nginx จะใช้ Server เหล่านี้ในการกระจาย Trafficserver { ... }: เป็น Server Block หลักของ Nginx ที่รอรับคำขอจากภายนอกlisten 80;: บอกให้ Nginx รอรับคำขอ HTTP ที่ Port 80server_name yourwebsite.com www.yourwebsite.com;: กำหนดชื่อ Domain ที่ Nginx ควรจะตอบสนองlocation / { ... }: กำหนดการทำงานสำหรับทุกคำขอที่เข้ามาproxy_pass http://backend_servers;: คำสั่งนี้สำคัญมากครับ มันบอก Nginx ให้ส่งต่อคำขอที่เข้ามาไปยังกลุ่มbackend_serversที่เรากำหนดไว้ในupstreamblockproxy_set_header Host $host;: ส่งต่อ HeaderHostไปยัง Backend Server เพื่อให้ Backend รู้ว่าคำขอมาจาก Domain ไหนproxy_set_header X-Real-IP $remote_addr;: ส่ง IP Address จริงของผู้ใช้งานไปยัง Backend Server เพราะ Backend จะเห็น IP ของ Nginx แทนครับproxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;: คล้ายกับX-Real-IPแต่จะเก็บ IP Address ของ Proxy Servers ทั้งหมดที่คำขอผ่านเข้ามาproxy_set_header X-Forwarded-Proto $scheme;: บอก Backend ว่าการเชื่อมต่อเดิมที่ Client ทำกับ Nginx เป็น HTTP หรือ HTTPS

การทดสอบและเปิดใช้งาน

หลังจากบันทึกไฟล์คอนฟิกแล้ว ให้ทดสอบความถูกต้องของ syntax ครับ

sudo nginx -t

หากไม่มีข้อผิดพลาด (syntax is ok, test is successful) ให้รีโหลด Nginx เพื่อให้การตั้งค่าใหม่มีผลครับ

sudo systemctl reload nginx

ตอนนี้ลองเข้าถึง http://yourwebsite.com ผ่านเว็บเบราว์เซอร์ของคุณดูครับ คุณควรจะเห็นการตอบสนองจาก Backend Servers ของคุณ และหากคุณรีเฟรชหน้าบ่อยๆ คุณจะเห็นว่าคำขอถูกส่งไปยัง Server 1 และ Server 2 สลับกันไปมา (ในกรณีของ Round Robin) ครับ

ตัวอย่างการตั้งค่า Load Balancing Algorithms ยอดนิยม

มาดูตัวอย่างการตั้งค่าสำหรับ Load Balancing Algorithms แบบอื่นๆ กันครับ คุณสามารถเปลี่ยน Algorithm ได้โดยการแก้ไขในส่วนของ upstream block ครับ

Round Robin

เป็นค่าเริ่มต้น ไม่ต้องระบุ Algorithm ใดๆ ครับ

upstream backend_servers {

server 192.168.1.101:8080;

server 192.168.1.102:8080;

}

Least Connections

กระจายคำขอไปยังเซิร์ฟเวอร์ที่มีการเชื่อมต่อน้อยที่สุดครับ

upstream backend_servers {

least_conn; # ระบุ Algorithm ที่นี่

server 192.168.1.101:8080;

server 192.168.1.102:8080;

}

Weighted Round Robin

กำหนดน้ำหนักให้แต่ละเซิร์ฟเวอร์ Server ที่มีน้ำหนักมากจะได้รับคำขอมากกว่า

upstream backend_servers {

server 192.168.1.101:8080 weight=3; # Server 1 ได้รับ 3 เท่าของ Server 2

server 192.168.1.102:8080 weight=1; # Server 2 ได้รับ 1 เท่า

}

ในตัวอย่างนี้ Server 1 จะได้รับคำขอ 3 ใน 4 ครั้ง และ Server 2 จะได้รับ 1 ใน 4 ครั้งครับ

IP Hash

ใช้ IP Address ของ Client ในการ Hash เพื่อส่ง Client เดิมไปยัง Backend Server ตัวเดิม ช่วยเรื่อง Session Persistence ครับ

upstream backend_servers {

ip_hash; # ระบุ Algorithm ที่นี่

server 192.168.1.101:8080;

server 192.168.1.102:8080;

}

หลังจากแก้ไขคอนฟิก อย่าลืม sudo nginx -t และ sudo systemctl reload nginx ทุกครั้งนะครับ

ฟีเจอร์เพิ่มเติมและเทคนิคขั้นสูง

Nginx มีความสามารถมากกว่าแค่การทำ Reverse Proxy และ Load Balancing ครับ เรามาดูฟีเจอร์เพิ่มเติมและเทคนิคขั้นสูงที่สามารถนำมาปรับใช้ได้ เพื่อเพิ่มประสิทธิภาพและความปลอดภัยให้กับระบบของคุณครับ

SSL/TLS Termination

การจัดการ SSL/TLS Certificates ที่ Nginx Proxy แทนที่จะให้ Backend Servers แต่ละตัวจัดการเอง มีข้อดีคือลดภาระงานของ Backend และทำให้การจัดการ Certificate ง่ายขึ้นครับ

ในการตั้งค่า SSL/TLS คุณจะต้องมี SSL Certificate และ Private Key ครับ หากคุณยังไม่มี คุณสามารถใช้ Let’s Encrypt เพื่อขอ Certificate ฟรีได้ครับ

server {

listen 80;

server_name yourwebsite.com www.yourwebsite.com;

return 301 https://$host$request_uri; # Redirect HTTP to HTTPS

}

server {

listen 443 ssl http2; # Nginx จะรอรับคำขอที่ Port 443 (HTTPS)

server_name yourwebsite.com www.yourwebsite.com;

# ระบุเส้นทางของ SSL Certificate และ Private Key

ssl_certificate /etc/letsencrypt/live/yourwebsite.com/fullchain.pem;

ssl_certificate_key /etc/letsencrypt/live/yourwebsite.com/privkey.pem;

# ตั้งค่า SSL/TLS เพิ่มเติมเพื่อความปลอดภัย

ssl_protocols TLSv1.2 TLSv1.3;

ssl_ciphers 'ECDHE-ECDSA-AES128-GCM-SHA256:ECDHE-RSA-AES128-GCM-SHA256:ECDHE-ECDSA-AES256-GCM-SHA384:ECDHE-RSA-AES256-GCM-SHA384:DHE-RSA-AES128-GCM-SHA256:DHE-RSA-AES256-GCM-SHA384';

ssl_prefer_server_ciphers on;

ssl_session_cache shared:SSL:10m;

ssl_session_timeout 10m;

ssl_stapling on;

ssl_stapling_verify on;

resolver 8.8.8.8 8.8.4.4 valid=300s;

resolver_timeout 5s;

location / {

proxy_pass http://backend_servers;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme; # แจ้ง Backend ว่าเป็น HTTPS

}

}

Health Checks (การตรวจสอบสถานะ Backend Servers)

Nginx สามารถตรวจสอบสถานะของ Backend Servers ได้โดยอัตโนมัติ หาก Backend Server ใดล่ม Nginx จะหยุดส่ง Traffic ไปยัง Server นั้นชั่วคราวครับ

คุณสามารถใช้พารามิเตอร์ max_fails และ fail_timeout ใน upstream block ได้:

upstream backend_servers {

server 192.168.1.101:8080 max_fails=3 fail_timeout=30s;

server 192.168.1.102:8080 max_fails=3 fail_timeout=30s;

}

max_fails=3: ถ้า Nginx ไม่สามารถเชื่อมต่อกับ Backend Server นี้ได้ 3 ครั้งติดต่อกันfail_timeout=30s: Nginx จะถือว่า Backend Server นี้ล่ม และจะไม่ส่ง Traffic ไปยัง Server นี้เป็นเวลา 30 วินาที หลังจากนั้นจะลองส่งคำขอไปใหม่เพื่อตรวจสอบว่ากลับมาทำงานแล้วหรือยัง

สำหรับ Active Health Checks ที่ซับซ้อนกว่า (เช่น การส่ง HTTP Request ไปยัง Health Check Endpoint) จะต้องใช้ Nginx Plus ครับ

Sticky Sessions (Session Persistence)

ในบางแอปพลิเคชัน การที่ผู้ใช้งานคนเดิมถูกส่งไปยัง Backend Server ตัวเดิมตลอดการใช้งาน Session เดียวกันเป็นสิ่งสำคัญครับ เพื่อให้ข้อมูล Session ไม่หายไป Nginx สามารถทำ Sticky Sessions ได้

ip_hash: (ที่เราเห็นไปแล้ว) เป็นวิธีที่ง่ายที่สุด แต่หาก IP ผู้ใช้งานเปลี่ยน Session ก็จะหลุดได้- Nginx Plus (Sticky Module): Nginx Plus มีโมดูล

stickyที่ซับซ้อนกว่า โดยใช้ Cookie เพื่อระบุ Backend Server ให้ผู้ใช้งาน ทำให้มีความแม่นยำสูงกว่าครับ

# ตัวอย่างการใช้ cookie-based sticky sessions (Nginx Plus)

upstream backend_servers {

server 192.168.1.101:8080;

server 192.168.1.102:8080;

sticky cookie srv_id expires=1h domain=.yourwebsite.com path=/;

}

Caching ด้วย Nginx

Nginx สามารถแคชเนื้อหาแบบคงที่ (Static Content) หรือแม้แต่การตอบสนองจาก Backend Servers ได้ เพื่อลดภาระงานของ Backend และเพิ่มความเร็วในการตอบสนองครับ

# ใน http block (มักจะอยู่ใน /etc/nginx/nginx.conf)

http {

# กำหนดพื้นที่สำหรับ Cache

proxy_cache_path /var/cache/nginx levels=1:2 keys_zone=my_cache:10m max_size=10g

inactive=60m use_temp_path=off;

server {

# ... (ส่วน server block เดิม) ...

location / {

proxy_pass http://backend_servers;

# เปิดใช้งาน Cache

proxy_cache my_cache;

proxy_cache_valid 200 302 10m; # แคช Response Status 200, 302 เป็นเวลา 10 นาที

proxy_cache_valid 404 1m; # แคช 404 เป็นเวลา 1 นาที

proxy_cache_revalidate on;

proxy_cache_min_uses 1;

proxy_cache_use_stale error timeout updating http_500 http_502 http_503 http_504;

add_header X-Proxy-Cache $upstream_cache_status; # เพิ่ม Header เพื่อดูสถานะ Cache

# ... (proxy_set_header อื่นๆ) ...

}

}

}

อย่าลืมสร้างไดเรกทอรีสำหรับ Cache และกำหนดสิทธิ์ให้ Nginx สามารถเขียนได้ครับ

sudo mkdir -p /var/cache/nginx

sudo chown -R www-data:www-data /var/cache/nginx # สำหรับ Ubuntu

การตั้งค่า Caching ที่เหมาะสมสามารถเพิ่มประสิทธิภาพของเว็บไซต์ได้อย่างมากครับ

Gzip Compression

Nginx สามารถบีบอัดข้อมูลก่อนส่งไปยัง Client เพื่อลดขนาดของข้อมูลและเพิ่มความเร็วในการโหลดหน้าเว็บครับ

# ใน http block

http {

# ...

gzip on; # เปิดใช้งาน Gzip

gzip_vary on;

gzip_proxied any;

gzip_comp_level 6; # ระดับการบีบอัด (1-9, 6 เป็นค่าที่เหมาะสม)

gzip_buffers 16 8k;

gzip_http_version 1.1;

gzip_types text/plain text/css application/json application/javascript text/xml application/xml application/xml+rss text/javascript;

# ...

}

การบันทึก Log (Logging)

การบันทึก Log เป็นสิ่งสำคัญสำหรับการตรวจสอบและแก้ไขปัญหาครับ Nginx จะมี Access Log (บันทึกการเข้าถึง) และ Error Log (บันทึกข้อผิดพลาด) ครับ

คุณสามารถกำหนดรูปแบบ Log ได้เองใน http block และระบุไฟล์ Log ใน server block

# ใน http block

http {

log_format custom_log '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for" "$upstream_addr"';

server {

# ...

access_log /var/log/nginx/yourwebsite.access.log custom_log;

error_log /var/log/nginx/yourwebsite.error.log warn;

# ...

}

}

$upstream_addr: ตัวแปรนี้จะแสดง IP และ Port ของ Backend Server ที่ Nginx ส่งคำขอไปให้ ซึ่งมีประโยชน์มากในการตรวจสอบว่า Load Balancer ทำงานอย่างไรครับ

การตรวจสอบและแก้ไขปัญหาเบื้องต้น (Troubleshooting)

เมื่อเกิดปัญหา การรู้วิธีตรวจสอบและแก้ไขปัญหาเบื้องต้นจะช่วยประหยัดเวลาได้มากครับ

- ตรวจสอบ Syntax ของ Nginx:

sudo nginx -tนี่คือขั้นตอนแรกสุดที่ควรทำครับ หากมีข้อผิดพลาด Nginx จะบอกตำแหน่งและสาเหตุของปัญหา

- ตรวจสอบ Log Files:

- Error Log:

sudo tail -f /var/log/nginx/error.log(หรือไฟล์ที่คุณกำหนด) จะแสดงข้อผิดพลาดที่ Nginx พบ - Access Log:

sudo tail -f /var/log/nginx/access.log(หรือไฟล์ที่คุณกำหนด) จะแสดงคำขอที่เข้ามาและสถานะการตอบกลับ

Log เหล่านี้จะบอกได้ว่าปัญหาเกิดจาก Nginx เอง หรือจาก Backend Server ครับ

- Error Log:

- สถานะของ Nginx Service:

sudo systemctl status nginxตรวจสอบว่า Nginx ทำงานอยู่หรือไม่ หากไม่ ให้ลอง

sudo systemctl start nginxหรือsudo systemctl restart nginx - Firewall Configuration:

ตรวจสอบว่า Port 80 และ 443 (สำหรับ Nginx Server) และ Port ของ Backend Servers (เช่น 8080) ได้รับอนุญาตใน Firewall ของทุกเซิร์ฟเวอร์ที่เกี่ยวข้องหรือไม่ครับ

- สำหรับ UFW (Ubuntu):

sudo ufw status - สำหรับ firewalld (CentOS):

sudo firewall-cmd --list-all

- สำหรับ UFW (Ubuntu):

- Backend Server Status:

ตรวจสอบว่า Backend Servers ทำงานอยู่หรือไม่ และแอปพลิเคชันบน Backend สามารถเข้าถึงได้โดยตรงจาก Nginx Server (เช่น ใช้

curl http://192.168.1.101:8080จาก Nginx Server) - Network Connectivity:

ลองใช้

pingหรือtelnetจาก Nginx Server ไปยัง Backend Servers เพื่อตรวจสอบการเชื่อมต่อ Networkping 192.168.1.101 telnet 192.168.1.101 8080หาก

telnetไม่สามารถเชื่อมต่อได้ แสดงว่ามีปัญหาที่ Network, Firewall หรือ Backend Server ไม่ได้เปิด Port ดังกล่าวครับ - Nginx Configuration Best Practices:

ตรวจสอบว่าคุณไม่ได้ใส่

proxy_set_header Host $host;ผิดพลาด หรือไม่ได้ใส่proxy_passชี้ไปยัง IP ของ Nginx เองครับ

ด้วยการตรวจสอบอย่างเป็นระบบ คุณจะสามารถระบุและแก้ไขปัญหาได้อย่างรวดเร็วครับ อ่านเพิ่มเติมเกี่ยวกับการจัดการ Nginx

เปรียบเทียบ Load Balancing Algorithms ที่แตกต่างกัน

เพื่อช่วยให้คุณตัดสินใจเลือก Algorithm ที่เหมาะสมกับความต้องการของคุณ เรามาดูตารางเปรียบเทียบข้อดี ข้อเสีย และกรณีการใช้งานของ Algorithm ยอดนิยมกันครับ

| Algorithm | คำอธิบาย | ข้อดี | ข้อเสีย | กรณีการใช้งาน |

|---|---|---|---|---|

| Round Robin | ส่งคำขอไปยัง Backend Servers ทีละตัวตามลำดับวนไปเรื่อยๆ | ตั้งค่าง่าย, เข้าใจง่าย, กระจายโหลดได้เท่าเทียมกัน (หากเซิร์ฟเวอร์เหมือนกัน) | ไม่คำนึงถึงสถานะหรือโหลดจริงของเซิร์ฟเวอร์, อาจทำให้เซิร์ฟเวอร์ที่ช้าทำงานหนักเกินไป | Backend Servers ทุกตัวมีประสิทธิภาพใกล้เคียงกัน, โหลดของ Traffic ค่อนข้างคงที่ |

| Least Connections | ส่งคำขอไปยัง Backend Server ที่มีการเชื่อมต่อน้อยที่สุดในขณะนั้น | กระจายโหลดได้สมดุลกว่า Round Robin, คำนึงถึงภาระงานปัจจุบันของเซิร์ฟเวอร์ | ต้องใช้ทรัพยากรในการตรวจสอบสถานะการเชื่อมต่อ, อาจไม่เหมาะกับ Traffic ที่มี Session ยาวนาน | Backend Servers มีประสิทธิภาพไม่เท่ากัน, Traffic มีลักษณะเป็น Session สั้นๆ หรือต้องการการตอบสนองที่รวดเร็ว |

| Weighted Round Robin | คล้าย Round Robin แต่กำหนดน้ำหนักให้แต่ละเซิร์ฟเวอร์ Server ที่มีน้ำหนักมากจะได้รับคำขอมากกว่า | สามารถปรับการกระจายโหลดให้เหมาะกับประสิทธิภาพของแต่ละเซิร์ฟเวอร์ได้ | ยังไม่คำนึงถึงโหลดจริงของเซิร์ฟเวอร์แบบเรียลไทม์, ต้องคาดการณ์ประสิทธิภาพของเซิร์ฟเวอร์เพื่อกำหนดน้ำหนัก | Backend Servers มีประสิทธิภาพไม่เท่ากันอย่างชัดเจน, ต้องการควบคุมการกระจายโหลดด้วยตนเอง |

| IP Hash | ใช้ IP Address ของ Client ในการ Hash เพื่อส่ง Client เดิมไปยัง Backend Server ตัวเดิมเสมอ | รักษา Session Persistence ได้โดยไม่ต้องใช้ Cookie, ง่ายต่อการตั้งค่าสำหรับ Session-aware applications | หาก Backend Server ล่ม ผู้ใช้งานอาจถูกส่งไปยัง Server อื่น ทำให้ Session หลุดได้, หาก IP ของ Client เปลี่ยน Session ก็จะหลุด, อาจทำให้การกระจายโหลดไม่สมดุลหากมี IP ซ้ำกันจำนวนมาก | แอปพลิเคชันที่ต้องการ Session Persistence, ไม่ต้องการพึ่งพา Cookie, จำนวน Backend Servers ไม่มากเกินไป |

การเลือก Algorithm ที่เหมาะสมขึ้นอยู่กับลักษณะของแอปพลิเคชัน, โครงสร้างของ Backend Servers และความต้องการด้านประสิทธิภาพและ Session Management ของคุณครับ

คำถามที่พบบ่อย (FAQ)

Q1: Nginx Reverse Proxy ต่างจาก Forward Proxy อย่างไรครับ?

A1: Reverse Proxy จะอยู่ด้านหน้าของ Web Server (Backend) และทำหน้าที่เป็นตัวกลางรับคำขอจาก Client ภายนอก แล้วส่งต่อไปยัง Backend Server ครับ Client ไม่รู้ว่ากำลังสื่อสารกับ Backend Server ตัวใด แต่เห็นเพียง Reverse Proxy เท่านั้นครับ

ในทางกลับกัน Forward Proxy จะอยู่ด้านหน้าของ Client และทำหน้าที่เป็นตัวกลางในการส่งคำขอจาก Client ไปยังอินเทอร์เน็ตครับ Forward Proxy ช่วยให้ Client สามารถเข้าถึงเว็บไซต์ได้โดยซ่อน IP Address ของ Client และอาจช่วยในการกรองเนื้อหาหรือ Caching ได้ครับ Client รู้ว่ากำลังสื่อสารผ่าน Forward Proxy ครับ

Q2: จำเป็นต้องมี Nginx Plus สำหรับ Load Balancing หรือไม่ครับ?

A2: ไม่จำเป็นเสมอไปครับ Nginx (เวอร์ชันโอเพนซอร์สฟรี) มีความสามารถในการทำ Load Balancing ที่ยอดเยี่ยมอยู่แล้วครับ โดยรองรับ Algorithm พื้นฐานอย่าง Round Robin, Least Connections, Weighted Round Robin และ IP Hash

Nginx Plus (เวอร์ชันเสียเงิน) จะมีฟีเจอร์ขั้นสูงเพิ่มเติม เช่น Active Health Checks, Sticky Sessions ที่ใช้ Cookie, การตั้งค่าแบบไดนามิก (Dynamic Configuration) ผ่าน API และการตรวจสอบสถานะแบบเรียลไทม์ (Live Activity Monitoring) ซึ่งเหมาะสำหรับองค์กรขนาดใหญ่หรือระบบที่มีความซับซ้อนสูงครับ

Q3: จะเกิดอะไรขึ้นถ้า Backend Server ล่มไปหนึ่งตัวครับ?

A3: หาก Backend Server ตัวใดตัวหนึ่งล่ม Nginx Load Balancer จะตรวจพบได้ (โดยใช้กลไก Health Checks เช่น max_fails และ fail_timeout ที่เราตั้งค่าไว้) และจะหยุดส่ง Traffic ไปยัง Server ที่ล่มนั้นชั่วคราวครับ คำขอทั้งหมดจะถูกส่งไปยัง Backend Servers ตัวอื่นๆ ที่ยังทำงานอยู่ ทำให้ระบบของคุณยังคงใช้งานได้ต่อเนื่องครับ เมื่อ Server ที่ล่มกลับมาออนไลน์ Nginx ก็จะเริ่มส่ง Traffic กลับไปหา Server นั้นอีกครั้งครับ

Q4: Nginx สามารถทำ Load Balancing สำหรับ Database ได้ไหมครับ?

A4: โดยพื้นฐานแล้ว Nginx ถูกออกแบบมาเพื่อจัดการ Traffic ที่เป็น HTTP/HTTPS หรือ TCP/UDP ครับ Nginx สามารถทำ Load Balancing สำหรับ Database ได้ในระดับ TCP/UDP Proxy ครับ เช่น การเชื่อมต่อกับ MySQL หรือ PostgreSQL แต่ Nginx ไม่ได้มีความสามารถในการทำ Database-aware Load Balancing ที่ซับซ้อน (เช่น การแยก Read/Write Operations) เหมือนกับ Database Load Balancer เฉพาะทางครับ สำหรับ Load Balancing ในระดับแอปพลิเคชันที่ลึกซึ้งกว่า คุณอาจต้องใช้โซลูชันอื่นๆ ร่วมด้วยครับ

Q5: การใช้ Nginx Reverse Proxy มีผลต่อ SEO หรือไม่ครับ?

A5: โดยปกติแล้ว การใช้ Nginx Reverse Proxy ไม่ควรมีผลเสียต่อ SEO โดยตรงครับ ในทางกลับกัน อาจช่วยส่งเสริม SEO ได้ด้วยซ้ำครับ เพราะ Nginx ช่วยเพิ่มความเร็วในการโหลดเว็บไซต์, เพิ่มความเสถียร (High Availability) และจัดการ SSL/TLS ได้อย่างมีประสิทธิภาพ ซึ่งเป็นปัจจัยสำคัญที่ Google และ Search Engines อื่นๆ ใช้ในการจัดอันดับครับ

อย่างไรก็ตาม คุณต้องแน่ใจว่าได้ตั้งค่า Nginx อย่างถูกต้อง โดยเฉพาะอย่างยิ่งการส่งต่อ Header ที่สำคัญ เช่น Host, X-Real-IP และ X-Forwarded-Proto เพื่อให้ Backend Server ประมวลผลคำขอได้อย่างถูกต้อง และการจัดการ Redirect HTTP to HTTPS ที่เหมาะสมครับ

Q6: จะจัดการ Session สำหรับผู้ใช้งานอย่างไรในสภาพแวดล้อม Load Balancing ครับ?

A6: การจัดการ Session ในสภาพแวดล้อม Load Balancing เป็นเรื่องสำคัญเพื่อให้ผู้ใช้งานไม่หลุดออกจากระบบเมื่อคำขอถูกส่งไปยัง Backend Server ตัวอื่นครับ มีหลายวิธีในการจัดการ Session:

- Sticky Sessions: ใช้ Algorithm เช่น

ip_hashใน Nginx เพื่อส่งผู้ใช้งานคนเดิมไปยัง Backend Server ตัวเดิมตลอด Session หรือใช้โมดูลstickyใน Nginx Plus ที่ใช้ Cookie - Shared Session Storage: เก็บข้อมูล Session ไว้ในที่จัดเก็บส่วนกลางที่ Backend Servers ทุกตัวสามารถเข้าถึงได้ เช่น Redis, Memcached หรือ Database แทนที่จะเก็บไว้ในหน่วยความจำของแต่ละ Server ครับ

- Session Replication: ให้ Backend Servers คัดลอกข้อมูล Session ระหว่างกัน แต่เป็นวิธีที่ซับซ้อนและใช้ทรัพยากรมาก

วิธีที่แนะนำและได้รับความนิยมมากที่สุดคือการใช้ Shared Session Storage ครับ

สรุปและ Call to Action

การตั้งค่า Nginx เป็น Reverse Proxy และ Load Balancer เป็นก้าวสำคัญในการสร้างโครงสร้างพื้นฐานของเว็บไซต์และแอปพลิเคชันที่แข็งแกร่ง, ปรับขนาดได้ และมีความน่าเชื่อถือสูงครับ เราได้เรียนรู้ตั้งแต่พื้นฐานว่า Nginx คืออะไร, Reverse Proxy และ Load Balancing ทำงานอย่างไร ไปจนถึงการตั้งค่าจริงในแต่ละขั้นตอน รวมถึงฟีเจอร์ขั้นสูงและการแก้ไขปัญหาเบื้องต้นครับ

ด้วย Nginx คุณสามารถ:

- เพิ่มประสิทธิภาพและความเร็วในการตอบสนองของเว็บไซต์

- เพิ่มความเสถียรและลด Downtime ของระบบ

- จัดการ Traffic จำนวนมหาศาลได้อย่างมีประสิทธิภาพ

- เพิ่มความปลอดภัยให้กับ Backend Servers

- ปรับขนาดของระบบได้ตามความต้องการที่เพิ่มขึ้น

หากคุณพร้อมที่จะยกระดับโครงสร้างพื้นฐานของเว็บไซต์หรือแอปพลิเคชันของคุณให้มีประสิทธิภาพและความเสถียรสูงสุด อย่ารอช้าที่จะนำความรู้ในบทความนี้ไปประยุกต์ใช้ครับ

สำหรับองค์กรที่ต้องการ Cloud Server ประสิทธิภาพสูง หรือ VPS ที่พร้อมใช้งาน Nginx Load Balancing และต้องการผู้เชี่ยวชาญคอยดูแลและให้คำปรึกษาตลอด 24 ชั่วโมง SiamLancard.com พร้อมให้บริการโซลูชันที่เหมาะสมกับทุกความต้องการของคุณครับ ติดต่อเราวันนี้เพื่อรับคำปรึกษาฟรีและเริ่มสร้างระบบที่เหนือกว่าไปพร้อมกัน!