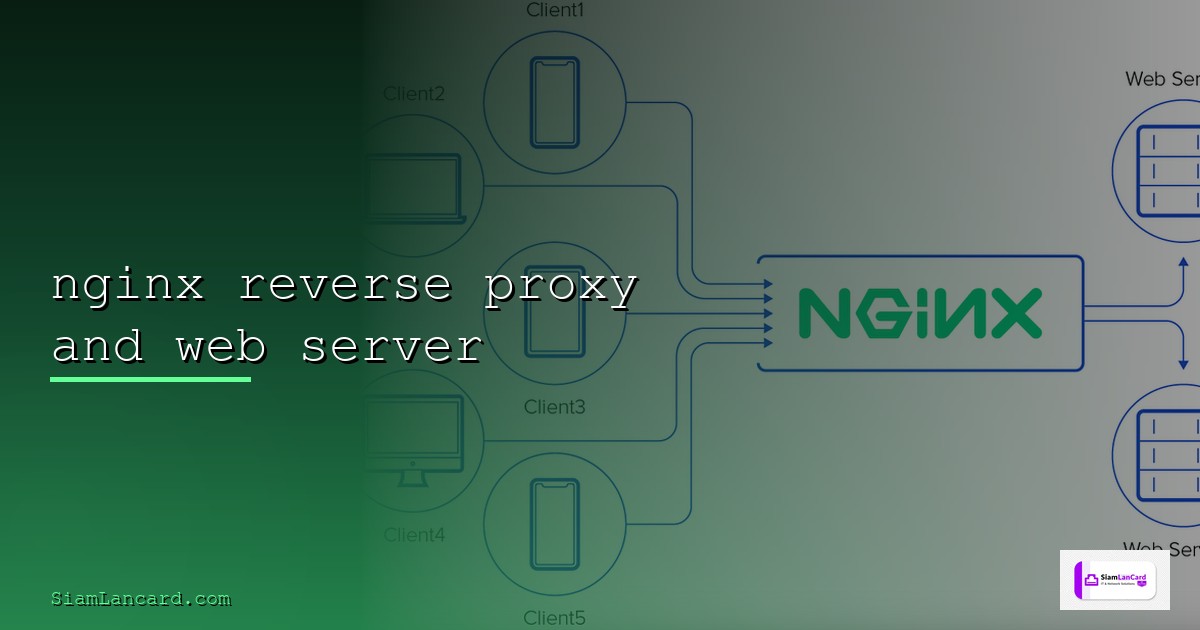

ในโลกดิจิทัลที่ขับเคลื่อนด้วยความเร็วสูงในปัจจุบัน เว็บไซต์และแอปพลิเคชันออนไลน์ไม่ได้เป็นเพียงแค่หน้าจอที่สวยงามอีกต่อไปครับ แต่เป็นหัวใจสำคัญของการดำเนินธุรกิจและความบันเทิง หากเว็บไซต์ของคุณต้องเผชิญกับผู้ใช้งานจำนวนมหาศาลตลอดเวลา หรือต้องการความมั่นคงและประสิทธิภาพที่ไร้ที่ติ การพึ่งพาเซิร์ฟเวอร์เดี่ยวเพียงเครื่องเดียวอาจไม่ใช่ทางออกที่ดีที่สุดอีกต่อไปครับ ความท้าทายเหล่านี้ทำให้แนวคิดของการกระจายโหลด (Load Balancing) และการใช้ Reverse Proxy กลายเป็นเทคโนโลยีที่ขาดไม่ได้ และเมื่อพูดถึงเครื่องมือที่ทรงพลังและยืดหยุ่นสำหรับการทำงานเหล่านี้ ชื่อของ Nginx (Engine-X) ก็มักจะถูกกล่าวถึงเป็นอันดับต้นๆ เสมอครับ

บทความนี้จะเจาะลึกถึงวิธีการตั้งค่า Nginx ให้ทำงานเป็น Reverse Proxy และ Load Balancer เพื่อช่วยให้โครงสร้างพื้นฐานเว็บไซต์ของคุณมีความสามารถในการรองรับการเข้าชมที่สูงขึ้น ลดความเสี่ยงของการหยุดทำงาน และเพิ่มประสิทธิภาพโดยรวม ไม่ว่าคุณจะเป็นนักพัฒนา ผู้ดูแลระบบ หรือเจ้าของธุรกิจที่ต้องการยกระดับประสิทธิภาพของเว็บไซต์ บทความนี้จะให้คู่มือที่ครบถ้วน เจาะลึก และนำไปใช้งานได้จริง เพื่อให้คุณสามารถนำ Nginx ไปใช้ประโยชน์ได้อย่างเต็มที่ครับ เรามาเริ่มต้นเดินทางสู่การสร้างระบบเว็บที่แข็งแกร่งและมีประสิทธิภาพไปด้วยกันเลยครับ

สารบัญ

- บทนำ: ทำไมต้อง Nginx Reverse Proxy Load Balancing?

- Nginx คืออะไร? ทำความรู้จักกับ Web Server อเนกประสงค์

- Reverse Proxy คืออะไร และสำคัญอย่างไร?

- Load Balancing คืออะไร? กระจายงานเพื่อประสิทธิภาพสูงสุด

- ทำไม Nginx ถึงเป็นตัวเลือกที่ดีสำหรับ Reverse Proxy Load Balancing?

- ประเภทของ Load Balancing Algorithms ใน Nginx

- เตรียมความพร้อมก่อนการตั้งค่า (Prerequisites)

- ขั้นตอนการตั้งค่า Nginx Reverse Proxy Load Balancing

- ขั้นตอนที่ 1: ติดตั้ง Nginx บนเซิร์ฟเวอร์หลัก

- ขั้นตอนที่ 2: ตั้งค่า Nginx เป็น Reverse Proxy พื้นฐาน

- ขั้นตอนที่ 3: เพิ่ม Backend Servers และตั้งค่า Load Balancing

- ขั้นตอนที่ 4: การจัดการ Session Persistence (Sticky Sessions)

- ขั้นตอนที่ 5: การตั้งค่า SSL/TLS Termination

- ขั้นตอนที่ 6: การตรวจสอบสถานะ Health Checks

- การปรับแต่งประสิทธิภาพและความปลอดภัย

- การมอนิเตอร์และแก้ไขปัญหา (Monitoring and Troubleshooting)

- คำถามที่พบบ่อย (FAQ)

- สรุป: ก้าวสู่โครงสร้างพื้นฐานเว็บที่แข็งแกร่ง

- Call to Action

บทนำ: ทำไมต้อง Nginx Reverse Proxy Load Balancing?

ในยุคที่ทุกธุรกิจต้องพึ่งพาแพลตฟอร์มออนไลน์ ไม่ว่าจะเป็นเว็บไซต์ E-commerce, แอปพลิเคชัน SaaS, หรือแม้แต่บล็อกส่วนตัว การที่ระบบสามารถรองรับการเข้าชมจำนวนมากได้อย่างราบรื่น และพร้อมใช้งานอยู่เสมอ (High Availability) คือกุญแจสำคัญสู่ความสำเร็จครับ

ลองจินตนาการว่าเว็บไซต์ของคุณกำลังได้รับความนิยมอย่างถล่มทลายจากแคมเปญการตลาดที่ประสบความสำเร็จ แต่ทันใดนั้น เซิร์ฟเวอร์กลับล่มลงเพราะรับโหลดไม่ไหว หรือการอัปเดตระบบทำให้เว็บไซต์ต้องหยุดชะงักเป็นเวลานาน สิ่งเหล่านี้ไม่เพียงแต่สร้างความไม่พอใจให้กับผู้ใช้งานเท่านั้น แต่ยังส่งผลเสียต่อชื่อเสียงและรายได้ของธุรกิจอีกด้วยครับ

นี่คือจุดที่ Nginx Reverse Proxy Load Balancing เข้ามามีบทบาทสำคัญ เทคโนโลยีนี้ช่วยให้คุณสามารถกระจายการทำงานของเว็บไซต์ไปยังเซิร์ฟเวอร์หลายๆ เครื่องได้ ทำให้ระบบมีความยืดหยุ่น ทนทานต่อความผิดพลาด และสามารถปรับขนาดได้ง่ายขึ้นเมื่อความต้องการเพิ่มขึ้นครับ นอกจากนี้ Nginx ยังนำเสนอคุณสมบัติด้านความปลอดภัยและการเพิ่มประสิทธิภาพอื่นๆ ที่จะช่วยยกระดับโครงสร้างพื้นฐานของคุณให้ก้าวไปอีกขั้นครับ

Nginx คืออะไร? ทำความรู้จักกับ Web Server อเนกประสงค์

Nginx (ออกเสียงว่า “Engine-X”) ไม่ใช่แค่ Web Server ทั่วไป แต่เป็นซอฟต์แวร์โอเพนซอร์สที่ทรงพลังและได้รับความนิยมอย่างแพร่หลายในฐานะ Web Server, Reverse Proxy, Load Balancer, HTTP Cache และ Media Streamer ครับ Nginx ถูกสร้างขึ้นโดย Igor Sysoev ในปี 2004 โดยมีจุดประสงค์หลักเพื่อแก้ไขปัญหา C10k (คือปัญหาที่ Web Server ทั่วไปไม่สามารถจัดการการเชื่อมต่อพร้อมกันได้ถึง 10,000 การเชื่อมต่อ) ด้วยสถาปัตยกรรมแบบ Asynchronous, Event-driven ที่แตกต่างจาก Web Server แบบเดิมๆ อย่าง Apache ครับ

ความโดดเด่นของ Nginx อยู่ที่ความสามารถในการจัดการการเชื่อมต่อจำนวนมากพร้อมกันได้อย่างมีประสิทธิภาพ ใช้ทรัพยากรน้อย และมีความเร็วสูง ทำให้เป็นตัวเลือกอันดับต้นๆ สำหรับเว็บไซต์และแอปพลิเคชันที่มีการเข้าชมสูง เช่น Netflix, Dropbox, WordPress.com และหลายๆ บริษัทชั้นนำทั่วโลกครับ

Reverse Proxy คืออะไร และสำคัญอย่างไร?

ก่อนที่เราจะพูดถึง Load Balancing เรามาทำความเข้าใจกับแนวคิดของ Reverse Proxy กันก่อนครับ

การทำงานของ Reverse Proxy

โดยทั่วไปเมื่อผู้ใช้งาน (Client) ต้องการเข้าถึงเว็บไซต์ พวกเขาจะส่งคำขอไปยัง Web Server โดยตรงครับ แต่ Reverse Proxy จะเข้ามาเป็น “ตัวกลาง” ระหว่างผู้ใช้งานกับ Web Server จริงๆ ครับ

เมื่อผู้ใช้งานส่งคำขอมาที่ Reverse Proxy (ซึ่งก็คือ Nginx ของเรา) Nginx จะรับคำขอนั้นไว้ จากนั้น Nginx จะตัดสินใจว่าจะส่งคำขอต่อไปยัง Web Server Backend เครื่องใดเครื่องหนึ่ง (ที่อยู่ภายในเครือข่ายของเรา) เพื่อประมวลผลครับ เมื่อ Web Server Backend ประมวลผลเสร็จและส่งผลลัพธ์กลับมาที่ Nginx, Nginx ก็จะส่งผลลัพธ์นั้นกลับไปยังผู้ใช้งานราวกับว่าผู้ใช้งานได้เชื่อมต่อกับ Nginx โดยตรงครับ

ลองนึกภาพเหมือนกับพนักงานต้อนรับส่วนหน้าของโรงแรม (Nginx) ที่รับคำขอจากลูกค้า (ผู้ใช้งาน) และส่งต่อให้แผนกที่เกี่ยวข้อง (Backend Servers) จัดการ ไม่ว่าจะเป็นแผนกเช็คอิน แผนกทำความสะอาด หรือแผนกบริการห้องพักครับ ลูกค้าไม่จำเป็นต้องรู้ว่ามีแผนกใดบ้างอยู่เบื้องหลัง เพียงแค่สื่อสารกับพนักงานต้อนรับเท่านั้นครับ

ประโยชน์ของ Reverse Proxy

การใช้ Reverse Proxy ไม่ได้มีแค่การเป็นตัวกลางเท่านั้น แต่ยังให้ประโยชน์มากมายครับ:

- ความปลอดภัย (Security): Reverse Proxy ช่วยปกปิด IP Address และรายละเอียดของ Backend Servers จากภายนอก ทำให้ผู้โจมตีเข้าถึงเซิร์ฟเวอร์หลักได้ยากขึ้น และยังสามารถทำหน้าที่เป็นด่านแรกในการกรองคำขอที่ไม่พึงประสงค์หรือการโจมตีบางประเภทได้ครับ

- การเพิ่มประสิทธิภาพ (Performance Optimization): Nginx สามารถทำ Caching Content ได้ ทำให้คำขอสำหรับไฟล์คงที่ (Static files) เช่น รูปภาพ CSS หรือ JavaScript ไม่จำเป็นต้องส่งไปถึง Backend Server ทุกครั้ง ช่วยลดภาระงานของ Backend และเพิ่มความเร็วในการตอบสนองครับ

- SSL/TLS Termination: Reverse Proxy สามารถจัดการการถอดรหัส SSL/TLS (Encrypt/Decrypt) ได้ ทำให้ Backend Servers ไม่ต้องรับภาระในการเข้ารหัส/ถอดรหัสข้อมูล ช่วยลดภาระงานและเพิ่มประสิทธิภาพให้กับ Backend ครับ

- การบีบอัดข้อมูล (Compression): Nginx สามารถบีบอัดข้อมูล (เช่น Gzip) ก่อนส่งกลับไปยัง Client เพื่อลดปริมาณข้อมูลที่ส่งผ่านเครือข่าย ทำให้การโหลดหน้าเว็บเร็วขึ้นครับ

- การทำ Load Balancing: นี่คือประโยชน์หลักที่เราจะพูดถึงในบทความนี้ครับ Reverse Proxy สามารถกระจายคำขอของผู้ใช้งานไปยัง Backend Servers หลายเครื่องได้

- การจัดการ Microservices: ในสถาปัตยกรรม Microservices, Reverse Proxy เป็นสิ่งสำคัญในการ Routing คำขอไปยังบริการที่ถูกต้อง

- A/B Testing และ Traffic Routing: สามารถกำหนดเงื่อนไขเพื่อส่งผู้ใช้งานไปยัง Backend Server ที่แตกต่างกันได้ เช่น ส่งผู้ใช้งานบางส่วนไปยังเวอร์ชันทดสอบของเว็บไซต์

Load Balancing คืออะไร? กระจายงานเพื่อประสิทธิภาพสูงสุด

เมื่อเว็บไซต์หรือแอปพลิเคชันของคุณเติบโตและมีผู้ใช้งานจำนวนมากขึ้นเรื่อยๆ เซิร์ฟเวอร์เดี่ยวอาจไม่สามารถรองรับปริมาณการเข้าชมที่สูงขึ้นได้อีกต่อไปครับ หรืออาจจะรับไหว แต่ประสิทธิภาพก็จะลดลงอย่างเห็นได้ชัด การเพิ่มพลังประมวลผลของเซิร์ฟเวอร์เดี่ยว (Scaling Up) มีขีดจำกัดและมีค่าใช้จ่ายสูง การแก้ปัญหาที่ดีกว่าคือการเพิ่มจำนวนเซิร์ฟเวอร์ (Scaling Out) และใช้เทคโนโลยี Load Balancing เข้ามาช่วยครับ

Load Balancing คือกระบวนการกระจายปริมาณงาน (Workload) ของการเข้าชมเครือข่ายหรือแอปพลิเคชันไปยังเซิร์ฟเวอร์หลายเครื่องครับ โดยมีเป้าหมายเพื่อเพิ่มประสิทธิภาพสูงสุด ลดเวลาแฝง (Latency) เพิ่มความสามารถในการรองรับการเข้าชม (Throughput) และป้องกันไม่ให้เซิร์ฟเวอร์ใดเซิร์ฟเวอร์หนึ่งทำงานหนักเกินไปจนเกิดการหยุดชะงักครับ

ความสำคัญของ Load Balancing

- เพิ่มความพร้อมใช้งาน (High Availability): หากเซิร์ฟเวอร์ Backend เครื่องใดเครื่องหนึ่งล้มเหลว Load Balancer จะหยุดส่งคำขอไปยังเซิร์ฟเวอร์นั้น และเปลี่ยนไปส่งคำขอไปยังเซิร์ฟเวอร์ที่ยังทำงานได้อยู่ ทำให้ผู้ใช้งานยังคงเข้าถึงเว็บไซต์ได้โดยไม่มีสะดุดครับ

- ปรับปรุงประสิทธิภาพ (Improved Performance): การกระจายโหลดช่วยให้ไม่มีเซิร์ฟเวอร์ใดทำงานหนักเกินไป ทำให้ทุกเซิร์ฟเวอร์สามารถตอบสนองคำขอได้อย่างรวดเร็วและสม่ำเสมอ

- ปรับขนาดได้ง่าย (Scalability): เมื่อความต้องการเพิ่มขึ้น คุณสามารถเพิ่ม Backend Servers เข้าไปในกลุ่มได้ง่ายๆ โดยไม่ต้องปรับเปลี่ยนโครงสร้างพื้นฐานเดิมมากนัก ทำให้ระบบของคุณพร้อมสำหรับการเติบโตในอนาคตครับ

- ลดเวลาหยุดทำงาน (Reduced Downtime): ไม่ว่าจะเกิดจากความผิดพลาดของฮาร์ดแวร์ ซอฟต์แวร์ หรือการบำรุงรักษา คุณก็สามารถถอดเซิร์ฟเวอร์ออกจากกลุ่มเพื่อซ่อมแซมได้โดยที่เว็บไซต์ยังคงทำงานอยู่ได้ครับ

- ความยืดหยุ่น (Flexibility): ช่วยให้สามารถอัปเดตหรือทดสอบเวอร์ชันใหม่ของแอปพลิเคชันบนเซิร์ฟเวอร์บางเครื่องก่อนที่จะปล่อยให้ผู้ใช้งานทุกคนได้ใช้

ทำไม Nginx ถึงเป็นตัวเลือกที่ดีสำหรับ Reverse Proxy Load Balancing?

ในตลาดมี Load Balancer และ Reverse Proxy ให้เลือกมากมาย แล้วทำไม Nginx ถึงเป็นตัวเลือกที่ได้รับความนิยมและแนะนำสำหรับงานนี้ล่ะครับ?

ประสิทธิภาพและความเร็ว

ดังที่กล่าวไป Nginx ถูกออกแบบมาเพื่อจัดการการเชื่อมต่อจำนวนมากพร้อมกันได้อย่างมีประสิทธิภาพ ด้วยสถาปัตยกรรมแบบ Event-driven ทำให้ Nginx สามารถใช้ทรัพยากร CPU และ Memory ได้อย่างคุ้มค่ากว่า Web Server แบบ Process-based ทั่วไปครับ ส่งผลให้สามารถรองรับการเข้าชมได้สูง ตอบสนองเร็ว และมี Latency ต่ำ ซึ่งเป็นสิ่งสำคัญสำหรับเว็บไซต์ที่มีผู้ใช้งานจำนวนมากครับ

ความยืดหยุ่นและการตั้งค่าที่ง่าย

ไฟล์คอนฟิกูเรชันของ Nginx มีโครงสร้างที่ชัดเจน อ่านง่าย และมีความยืดหยุ่นสูง ทำให้สามารถปรับแต่งการทำงานต่างๆ ได้อย่างละเอียด ไม่ว่าจะเป็นการกำหนด Routing Rules, การตั้งค่า Caching, การจัดการ SSL/TLS หรือการกำหนด Load Balancing Algorithms ที่หลากหลายครับ

ความสามารถหลากหลาย

Nginx ไม่ได้เป็นแค่ Load Balancer หรือ Reverse Proxy เท่านั้น แต่ยังมีความสามารถอื่นๆ ที่เป็นประโยชน์อย่างมากในระบบนิเวศของเว็บ:

- เป็น Web Server สำหรับ Static Content ที่รวดเร็ว

- HTTP Cache เพื่อลดภาระ Backend

- SSL/TLS Termination และ Security Features

- Rate Limiting เพื่อป้องกันการโจมตีแบบ DoS/DDoS

- รองรับ HTTP/2 และ WebSocket

ชุมชนและการสนับสนุน

Nginx เป็นโครงการ Open Source ที่มีชุมชนผู้ใช้งานและนักพัฒนาขนาดใหญ่ทั่วโลก ทำให้มีแหล่งข้อมูล เอกสารประกอบ และการสนับสนุนมากมายที่คุณสามารถหาได้ง่ายเมื่อพบปัญหาครับ นอกจากนี้ยังมี Nginx Plus ซึ่งเป็นเวอร์ชันเชิงพาณิชย์ที่มาพร้อมคุณสมบัติขั้นสูงและการสนับสนุนจาก Nginx Inc. โดยตรงครับ

ประเภทของ Load Balancing Algorithms ใน Nginx

Nginx มี Load Balancing Algorithms หลายประเภทให้เลือกใช้ ขึ้นอยู่กับความต้องการและลักษณะของแอปพลิเคชันของคุณครับ

Round Robin (ค่าเริ่มต้น)

- การทำงาน: Nginx จะกระจายคำขอของผู้ใช้งานไปยัง Backend Servers ในกลุ่มตามลำดับครับ เช่น ถ้ามี Server A, B, C คำขอแรกไป A, คำขอที่สองไป B, คำขอที่สามไป C, คำขอที่สี่กลับไป A วนไปเรื่อยๆ ครับ

- เหมาะสำหรับ: แอปพลิเคชันที่ Backend Servers มีความสามารถในการประมวลผลใกล้เคียงกัน และไม่มีความจำเป็นต้องรักษา Session ของผู้ใช้งานให้อยู่บนเซิร์ฟเวอร์เดิม

- ข้อดี: ใช้งานง่าย ตั้งค่าง่าย และกระจายโหลดได้ค่อนข้างสม่ำเสมอ

- ข้อเสีย: ไม่ได้คำนึงถึงภาระงานปัจจุบันของเซิร์ฟเวอร์ หากมีเซิร์ฟเวอร์ใดทำงานหนักกว่า อาจจะยังคงได้รับคำขอเท่ากับเซิร์ฟเวอร์อื่น

upstream backend_servers {

server 192.168.1.101;

server 192.168.1.102;

server 192.168.1.103;

}Least Connected

- การทำงาน: Nginx จะส่งคำขอไปยัง Backend Server ที่มีการเชื่อมต่อน้อยที่สุดในขณะนั้นครับ

- เหมาะสำหรับ: แอปพลิเคชันที่คำขอแต่ละรายการอาจใช้เวลาในการประมวลผลแตกต่างกันไป เช่น การดาวน์โหลดไฟล์ขนาดใหญ่ หรือการประมวลผลข้อมูลที่ซับซ้อน ช่วยให้เซิร์ฟเวอร์ที่ว่างกว่าได้ทำงานก่อน

- ข้อดี: ช่วยให้การกระจายโหลดมีประสิทธิภาพมากขึ้น โดยพิจารณาจากภาระงานจริงของเซิร์ฟเวอร์

- ข้อเสีย: อาจจะซับซ้อนกว่า Round Robin เล็กน้อยในการคำนวณจำนวนการเชื่อมต่อ

upstream backend_servers {

least_conn;

server 192.168.1.101;

server 192.168.1.102;

server 192.168.1.103;

}IP Hash

- การทำงาน: Nginx จะใช้ IP Address ของผู้ใช้งานเป็นตัวกำหนดว่าคำขอนั้นจะถูกส่งไปยัง Backend Server เครื่องใดครับ นั่นหมายความว่าผู้ใช้งานคนเดิมจะถูกส่งไปยัง Backend Server เครื่องเดิมเสมอครับ

- เหมาะสำหรับ: แอปพลิเคชันที่ต้องการ Session Persistence หรือ Sticky Sessions ซึ่งหมายถึงการที่ผู้ใช้งานต้องเชื่อมต่อกับ Backend Server เดิมตลอดช่วง Session การใช้งาน เพื่อรักษาข้อมูล Session หรือสถานะต่างๆ

- ข้อดี: ง่ายต่อการทำ Session Persistence โดยไม่ต้องใช้ Cookie หรือกลไกอื่นเพิ่มเติม

- ข้อเสีย: หากมี Backend Server ใดล่มลง Session ของผู้ใช้งานบนเซิร์ฟเวอร์นั้นจะหายไป และอาจทำให้เกิดการกระจายโหลดที่ไม่สมดุลได้ หากมีผู้ใช้งานจำนวนมากมาจาก IP Address กลุ่มเดียวกัน

upstream backend_servers {

ip_hash;

server 192.168.1.101;

server 192.168.1.102;

server 192.168.1.103;

}Generic Hash (Nginx Plus)

- การทำงาน: คล้ายกับ IP Hash แต่สามารถใช้ตัวแปรใดๆ ก็ได้ในการสร้าง Hash Key แทนที่จะเป็นแค่ IP Address ครับ เช่น คุณอาจจะใช้ URI หรือ HTTP Header เป็น Hash Key

- เหมาะสำหรับ: การทำ Session Persistence ที่ยืดหยุ่นกว่า IP Hash หรือการทำ Caching ตาม Key ที่กำหนดเอง

upstream backend_servers {

hash $request_uri consistent; # ใช้ URI เป็น key

server 192.168.1.101;

server 192.168.1.102;

server 192.168.1.103;

}Least Time (Nginx Plus)

- การทำงาน: Nginx จะส่งคำขอไปยัง Backend Server ที่มีเวลาตอบสนองเฉลี่ยที่เร็วที่สุดและมีจำนวนการเชื่อมต่อน้อยที่สุดครับ

- เหมาะสำหรับ: แอปพลิเคชันที่ต้องการประสิทธิภาพสูงสุด โดยพิจารณาทั้งความเร็วในการตอบสนองและภาระงานของเซิร์ฟเวอร์

upstream backend_servers {

least_time header; # หรือ least_time last_byte;

server 192.168.1.101;

server 192.168.1.102;

server 192.168.1.103;

}Random (Nginx Plus)

- การทำงาน: Nginx จะสุ่มเลือก Backend Server ที่จะส่งคำขอไปให้

- เหมาะสำหรับ: สถานการณ์ที่ต้องการกระจายโหลดแบบสุ่ม หรือเมื่อต้องการลดผลกระทบจาก Caching ของ DNS

upstream backend_servers {

random two least_conn; # เลือก 2 ตัวที่ random แล้วส่งไปตัวที่มี least_conn

server 192.168.1.101;

server 192.168.1.102;

server 192.168.1.103;

}ตารางเปรียบเทียบ Load Balancing Algorithms

เพื่อความเข้าใจที่ชัดเจนยิ่งขึ้น นี่คือตารางเปรียบเทียบ Load Balancing Algorithms ที่มีใน Nginx ครับ

| Algorithm | การทำงาน | ข้อดี | ข้อเสีย | เหมาะสำหรับ | Nginx เวอร์ชัน |

|---|---|---|---|---|---|

| Round Robin | กระจายคำขอตามลำดับวนไปเรื่อยๆ | ตั้งค่าง่าย, กระจายโหลดสม่ำเสมอเบื้องต้น | ไม่พิจารณาภาระงานจริงของเซิร์ฟเวอร์ | Backend Servers มีความสามารถเท่ากัน, ไม่ต้องการ Sticky Session | Open Source & Plus |

| Least Connected | ส่งคำขอไปยังเซิร์ฟเวอร์ที่มีการเชื่อมต่อน้อยที่สุด | กระจายโหลดได้สมดุลตามภาระงานจริง | ซับซ้อนกว่า Round Robin เล็กน้อย | คำขอใช้เวลาประมวลผลต่างกัน, ต้องการประสิทธิภาพที่ดีขึ้น | Open Source & Plus |

| IP Hash | ใช้ IP ผู้ใช้งานเป็น key เพื่อส่งไปยังเซิร์ฟเวอร์เดิม | ง่ายต่อการทำ Session Persistence (Sticky Session) | อาจทำให้โหลดไม่สมดุล, Session หายหากเซิร์ฟเวอร์ล่ม | แอปพลิเคชันที่ต้องการ Sticky Session | Open Source & Plus |

| Generic Hash | ใช้ตัวแปรใดๆ เป็น key ในการทำ Hash | ยืดหยุ่นกว่า IP Hash ในการทำ Sticky Session/Caching | ต้องใช้ Nginx Plus | Sticky Session ที่ซับซ้อนขึ้น, Advanced Caching | Nginx Plus |

| Least Time | ส่งคำขอไปยังเซิร์ฟเวอร์ที่เร็วที่สุดและมี Active Connection น้อยที่สุด | ประสิทธิภาพสูงสุด, พิจารณาทั้งความเร็วและภาระงาน | ต้องใช้ Nginx Plus | แอปพลิเคชันที่ต้องการความเร็วและการตอบสนองสูง | Nginx Plus |

| Random | สุ่มเลือกเซิร์ฟเวอร์ | กระจายโหลดแบบสุ่ม, ลดผลกระทบจาก DNS Caching | ต้องใช้ Nginx Plus | กรณีพิเศษที่ต้องการความสุ่ม, ทดสอบ | Nginx Plus |

การเลือก Algorithm ที่เหมาะสมจะช่วยให้ระบบของคุณทำงานได้อย่างมีประสิทธิภาพสูงสุดครับ

เตรียมความพร้อมก่อนการตั้งค่า (Prerequisites)

ก่อนที่เราจะลงมือตั้งค่า Nginx ให้ทำหน้าที่เป็น Reverse Proxy Load Balancer มีสิ่งที่เราต้องเตรียมความพร้อมและทำความเข้าใจก่อนครับ

เซิร์ฟเวอร์ Nginx

คุณต้องมีเซิร์ฟเวอร์ (Virtual Machine หรือ Physical Server) อย่างน้อยหนึ่งเครื่องที่จะใช้ติดตั้ง Nginx เพื่อเป็น Reverse Proxy Load Balancer ครับ เซิร์ฟเวอร์นี้ควรมีทรัพยากร (CPU, RAM) เพียงพอที่จะจัดการการเชื่อมต่อขาเข้าและกระจายโหลดไปยัง Backend Servers ได้อย่างมีประสิทธิภาพ

Backend Servers (Web Servers)

คุณต้องมี Backend Servers อย่างน้อยสองเครื่องขึ้นไป (เช่น เซิร์ฟเวอร์ที่รัน Apache, Nginx ตัวอื่น, Node.js, PHP-FPM, Python Gunicorn, Java Tomcat หรือแอปพลิเคชันใดๆ ก็ตาม) ที่จะทำหน้าที่ประมวลผลคำขอจริงครับ เซิร์ฟเวอร์เหล่านี้ไม่จำเป็นต้องติดตั้ง Nginx ก็ได้ แต่ต้องสามารถรับคำขอ HTTP/HTTPS ได้ตามปกติ และควรมี IP Address ส่วนตัวที่ Nginx Reverse Proxy สามารถเข้าถึงได้ (เช่น IP ภายในเครือข่ายเดียวกัน) ครับ

- Backend Server 1:

192.168.1.101 - Backend Server 2:

192.168.1.102 - Backend Server 3:

192.168.1.103

สำหรับบทความนี้ เราจะสมมติว่า Backend Servers ของคุณกำลังรัน Web Server เช่น Apache หรือ Nginx และพร้อมที่จะรับคำขอ HTTP บนพอร์ต 80 ครับ

โดเมนและ DNS

คุณจะต้องมีชื่อโดเมน (เช่น yourwebsite.com) ที่ต้องการให้ Nginx จัดการ และต้องตั้งค่า DNS A record ของโดเมนนั้นให้ชี้ไปยัง IP Address สาธารณะของเซิร์ฟเวอร์ Nginx Reverse Proxy ของคุณครับ

yourwebsite.com-> Public IP ของ Nginx Reverse Proxy

ความเข้าใจพื้นฐาน Command Line

คุณควรมีความคุ้นเคยกับการใช้งาน Command Line Interface (CLI) ของ Linux เบื้องต้น เช่น การติดตั้งแพ็คเกจ การแก้ไขไฟล์ การรีสตาร์ทบริการ และการตรวจสอบสถานะของบริการต่างๆ ครับ

เมื่อคุณเตรียมสิ่งเหล่านี้พร้อมแล้ว เราก็พร้อมที่จะเข้าสู่ขั้นตอนการตั้งค่า Nginx Reverse Proxy Load Balancing กันแล้วครับ

ขั้นตอนการตั้งค่า Nginx Reverse Proxy Load Balancing

เราจะมาดูขั้นตอนการติดตั้งและตั้งค่า Nginx เพื่อให้ทำหน้าที่เป็น Reverse Proxy และ Load Balancer อย่างละเอียดครับ

ขั้นตอนที่ 1: ติดตั้ง Nginx บนเซิร์ฟเวอร์หลัก

เริ่มต้นด้วยการติดตั้ง Nginx บนเซิร์ฟเวอร์ที่คุณต้องการให้เป็น Reverse Proxy Load Balancer ครับ

สำหรับ Debian/Ubuntu

sudo apt update

sudo apt install nginx -y

sudo systemctl enable nginx

sudo systemctl start nginxสำหรับ CentOS/RHEL

sudo yum install epel-release -y

sudo yum install nginx -y

sudo systemctl enable nginx

sudo systemctl start nginxหลังจากติดตั้งเสร็จ คุณควรจะสามารถเข้าถึง IP Address สาธารณะของเซิร์ฟเวอร์ Nginx ผ่านเว็บเบราว์เซอร์ได้ และเห็นหน้าเว็บต้อนรับของ Nginx ครับ

ขั้นตอนที่ 2: ตั้งค่า Nginx เป็น Reverse Proxy พื้นฐาน

เราจะเริ่มต้นด้วยการตั้งค่า Nginx ให้เป็น Reverse Proxy พื้นฐานก่อนที่จะเพิ่ม Load Balancing เข้าไปครับ

สร้างไฟล์คอนฟิกูเรชันสำหรับเว็บไซต์

โดยทั่วไปไฟล์คอนฟิกูเรชันของ Nginx จะอยู่ในไดเรกทอรี /etc/nginx/ ครับ เราจะสร้างไฟล์คอนฟิกูเรชันใหม่สำหรับเว็บไซต์ของคุณใน /etc/nginx/conf.d/ หรือ /etc/nginx/sites-available/ (แล้วสร้าง symlink ไปที่ sites-enabled/) ครับ

ในตัวอย่างนี้ เราจะใช้ /etc/nginx/conf.d/ ซึ่งเป็นวิธีที่นิยมสำหรับคอนฟิกูเรชันที่ง่ายกว่าครับ

sudo nano /etc/nginx/conf.d/yourwebsite.confตัวอย่างคอนฟิกูเรชัน (Reverse Proxy อย่างเดียว)

ในตัวอย่างนี้ Nginx จะทำหน้าที่เป็น Reverse Proxy ไปยัง Backend Server เพียงเครื่องเดียวที่ 192.168.1.101 ครับ

server {

listen 80;

server_name yourwebsite.com www.yourwebsite.com;

location / {

proxy_pass http://192.168.1.101:80;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}listen 80;: Nginx จะฟังการเชื่อมต่อ HTTP บนพอร์ต 80 ครับserver_name yourwebsite.com www.yourwebsite.com;: กำหนดชื่อโดเมนที่ Nginx จะรับคำขอlocation / { ... }: บล็อกนี้จะจัดการคำขอทั้งหมดที่เข้ามาproxy_pass http://192.168.1.101:80;: นี่คือหัวใจของการเป็น Reverse Proxy ครับ Nginx จะส่งต่อคำขอทั้งหมดไปยัง Backend Server ที่ IP192.168.1.101บนพอร์ต 80 ครับproxy_set_header ...;: บรรทัดเหล่านี้มีความสำคัญมากครับ มันจะส่งข้อมูลสำคัญจาก Client (เช่น IP Address, Hostname) ไปยัง Backend Server เพื่อให้ Backend Server สามารถรับรู้ข้อมูลต้นทางที่แท้จริงได้ ซึ่งจำเป็นสำหรับการ Logging, Security และการทำงานของแอปพลิเคชันครับ

ทดสอบและรีโหลด Nginx

หลังจากบันทึกไฟล์คอนฟิกูเรชันแล้ว ให้ทดสอบความถูกต้องของคอนฟิกูเรชัน Nginx ครับ

sudo nginx -tหากไม่มีข้อผิดพลาด คุณจะเห็นข้อความประมาณว่า syntax is ok และ test is successful จากนั้นให้รีโหลด Nginx เพื่อให้การตั้งค่าใหม่มีผลครับ

sudo systemctl reload nginxตอนนี้เมื่อคุณเข้าถึง yourwebsite.com ผ่านเว็บเบราว์เซอร์ Nginx จะส่งต่อคำขอของคุณไปยัง Backend Server 192.168.1.101 ครับ

ขั้นตอนที่ 3: เพิ่ม Backend Servers และตั้งค่า Load Balancing

ถึงเวลาที่เราจะเพิ่ม Load Balancing เข้าไปในคอนฟิกูเรชันครับ เราจะใช้ Directive ที่เรียกว่า upstream เพื่อกำหนดกลุ่มของ Backend Servers ครับ

กำหนดกลุ่ม Upstream Servers

แก้ไขไฟล์ /etc/nginx/conf.d/yourwebsite.conf อีกครั้งครับ เพิ่มบล็อก upstream ด้านนอกบล็อก server ครับ

upstream backend_servers {

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

# สามารถกำหนดน้ำหนัก (weight) ได้

# server 192.168.1.101:80 weight=3;

# server 192.168.1.102:80 weight=1;

}

server {

listen 80;

server_name yourwebsite.com www.yourwebsite.com;

location / {

proxy_pass http://backend_servers; # ชี้ไปที่ชื่อ upstream block

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}ในบล็อก upstream backend_servers เราได้กำหนด Backend Servers 3 เครื่องครับ และใน location / เราเปลี่ยน proxy_pass ให้ชี้ไปที่ชื่อของบล็อก upstream แทน IP Address โดยตรงครับ

โดยค่าเริ่มต้น Nginx จะใช้ Load Balancing Algorithm แบบ Round Robin ครับ

เลือก Load Balancing Algorithm

คุณสามารถกำหนด Algorithm อื่นๆ ได้โดยเพิ่ม Directive เข้าไปในบล็อก upstream ครับ

ตัวอย่างคอนฟิกูเรชัน (Load Balancing: Round Robin)

เป็นค่าเริ่มต้น ไม่ต้องระบุ Algorithm ใดๆ เพิ่มเติมในบล็อก upstream ครับ

upstream backend_servers {

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}

# ... ส่วน server block เหมือนเดิม ...ตัวอย่างคอนฟิกูเรชัน (Load Balancing: Least Connected)

เพิ่ม least_conn; เข้าไปในบล็อก upstream ครับ

upstream backend_servers {

least_conn;

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}

# ... ส่วน server block เหมือนเดิม ...ตัวอย่างคอนฟิกูเรชัน (Load Balancing: IP Hash)

เพิ่ม ip_hash; เข้าไปในบล็อก upstream ครับ

upstream backend_servers {

ip_hash;

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}

# ... ส่วน server block เหมือนเดิม ...หลังจากแก้ไขไฟล์คอนฟิกูเรชันแล้ว อย่าลืม

sudo nginx -tและ

sudo systemctl reload nginxทุกครั้งนะครับ

ขั้นตอนที่ 4: การจัดการ Session Persistence (Sticky Sessions)

ในบางแอปพลิเคชัน โดยเฉพาะเว็บแอปพลิเคชันที่มีสถานะ (Stateful applications) เช่น ตะกร้าสินค้าใน E-commerce หรือหน้า Login การที่ผู้ใช้งานคนเดิมถูกส่งไปยัง Backend Server เครื่องเดิมตลอด Session การใช้งานเป็นสิ่งสำคัญครับ หากคำขอของผู้ใช้งานถูกส่งไปยังเซิร์ฟเวอร์คนละเครื่องในระหว่าง Session ข้อมูล Session อาจจะหายไปและทำให้ประสบการณ์การใช้งานแย่ลงครับ

ทำไมต้องใช้ Session Persistence?

เพื่อรักษาข้อมูล Session ของผู้ใช้งานให้อยู่บนเซิร์ฟเวอร์เดิม หากไม่มี Session Persistence ผู้ใช้งานอาจต้อง Login ใหม่ หรือข้อมูลในตะกร้าสินค้าหายไปครับ

การตั้งค่าด้วย IP Hash

วิธีที่ง่ายที่สุดในการทำ Session Persistence ใน Nginx Open Source คือการใช้ ip_hash Algorithm ตามที่เราได้กล่าวไปแล้วครับ

upstream backend_servers {

ip_hash;

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}ข้อจำกัดของ ip_hash คือหาก IP Address ของผู้ใช้งานเปลี่ยนไป (เช่น เปลี่ยนเครือข่าย Wi-Fi) Session ก็อาจจะเปลี่ยนเซิร์ฟเวอร์ได้ และหาก Backend Server ที่รับ Session ล่มลง Session นั้นก็จะหายไปครับ

การตั้งค่าด้วย Cookie (Nginx Plus)

สำหรับ Nginx Plus มี Directive sticky ที่สามารถใช้ Cookie เพื่อทำ Session Persistence ได้อย่างมีประสิทธิภาพกว่าครับ

upstream backend_servers {

sticky learn

create=$cookie_mysessioncookie

lookup=$cookie_mysessioncookie

zone=client_sessions:1m;

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}การใช้ sticky ด้วย Cookie จะช่วยให้ Session Persistence มีความเสถียรมากกว่า ip_hash ครับ

ขั้นตอนที่ 5: การตั้งค่า SSL/TLS Termination

การทำ SSL/TLS Termination ที่ Reverse Proxy (Nginx) หมายถึงการให้ Nginx รับผิดชอบในการถอดรหัสการเชื่อมต่อ HTTPS จาก Client ครับ หลังจากที่ Nginx ถอดรหัสแล้ว ก็จะส่งคำขอไปยัง Backend Servers แบบ HTTP ธรรมดา (หรือ HTTPS อีกครั้งก็ได้) ครับ

ประโยชน์ของการทำ SSL Termination ที่ Reverse Proxy

- ลดภาระ Backend Servers: การเข้ารหัสและถอดรหัส SSL/TLS เป็นกระบวนการที่ใช้ทรัพยากร CPU สูง การให้ Nginx จัดการภาระนี้ ช่วยให้ Backend Servers มีทรัพยากรมากขึ้นในการประมวลผลแอปพลิเคชันหลักครับ

- จัดการใบรับรองรวมศูนย์: ใบรับรอง SSL/TLS ทั้งหมดจะถูกติดตั้งและจัดการที่ Nginx เพียงที่เดียว ทำให้ง่ายต่อการต่ออายุหรือเปลี่ยนแปลงใบรับรองครับ

- เพิ่มประสิทธิภาพ: Nginx สามารถใช้ Hardware acceleration สำหรับ SSL/TLS ได้

การเตรียมใบรับรอง SSL

คุณจะต้องมีใบรับรอง SSL/TLS (เช่น จาก Let’s Encrypt, Comodo, DigiCert) และ Private Key ครับ สมมติว่าไฟล์ของคุณอยู่ที่:

/etc/nginx/ssl/yourwebsite.com.crt/etc/nginx/ssl/yourwebsite.com.key

หากคุณใช้ Let’s Encrypt คุณสามารถใช้ Certbot เพื่อติดตั้งและตั้งค่า SSL ได้อย่างง่ายดายครับ อ่านเพิ่มเติมเกี่ยวกับการติดตั้ง Let’s Encrypt กับ Nginx

ตัวอย่างคอนฟิกูเรชัน (SSL Termination)

แก้ไขไฟล์ /etc/nginx/conf.d/yourwebsite.conf ให้รับการเชื่อมต่อ HTTPS ครับ

upstream backend_servers {

least_conn; # หรือ algorithm อื่นๆ

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}

# HTTP to HTTPS Redirection

server {

listen 80;

server_name yourwebsite.com www.yourwebsite.com;

return 301 https://$host$request_uri;

}

# HTTPS Server Block

server {

listen 443 ssl http2;

server_name yourwebsite.com www.yourwebsite.com;

ssl_certificate /etc/nginx/ssl/yourwebsite.com.crt;

ssl_certificate_key /etc/nginx/ssl/yourwebsite.com.key;

ssl_protocols TLSv1.2 TLSv1.3;

ssl_ciphers 'TLS_AES_128_GCM_SHA256:TLS_AES_256_GCM_SHA384:TLS_CHACHA20_POLY1305_SHA256:ECDHE-RSA-AES128-GCM-SHA256:ECDHE-RSA-AES256-GCM-SHA384';

ssl_prefer_server_ciphers off;

ssl_session_cache shared:SSL:10m;

ssl_session_timeout 1d;

ssl_session_tickets off;

ssl_stapling on;

ssl_stapling_verify on;

resolver 8.8.8.8 8.8.4.4 valid=300s;

resolver_timeout 5s;

add_header Strict-Transport-Security "max-age=63072000; includeSubDomains; preload";

add_header X-Frame-Options DENY;

add_header X-Content-Type-Options nosniff;

add_header X-XSS-Protection "1; mode=block";

location / {

proxy_pass http://backend_servers; # ส่งต่อไปยัง backend แบบ HTTP ธรรมดา

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}ในตัวอย่างนี้ เราได้เพิ่ม server block สำหรับพอร์ต 80 เพื่อทำ HTTP to HTTPS Redirection และ server block สำหรับพอร์ต 443 เพื่อรับการเชื่อมต่อ HTTPS พร้อมการตั้งค่า SSL/TLS ที่แนะนำเพื่อความปลอดภัยครับ

อย่าลืม

sudo nginx -tและ

sudo systemctl reload nginxครับ

ขั้นตอนที่ 6: การตรวจสอบสถานะ Health Checks

Health Checks เป็นคุณสมบัติที่สำคัญของ Load Balancing ครับ มันช่วยให้ Load Balancer สามารถตรวจจับได้ว่า Backend Server เครื่องใดเครื่องหนึ่งล้มเหลวหรือไม่ตอบสนอง และจะหยุดส่งคำขอไปยังเซิร์ฟเวอร์นั้นโดยอัตโนมัติ เพื่อให้มั่นใจว่าผู้ใช้งานจะไม่ได้รับ Error ครับ

ประโยชน์ของ Health Checks

- เพิ่มความน่าเชื่อถือ: ระบบยังคงทำงานได้แม้มี Backend Server ล้มเหลว

- ประสบการณ์ผู้ใช้งานที่ดีขึ้น: ผู้ใช้งานจะไม่เห็นหน้า Error จากเซิร์ฟเวอร์ที่ล่ม

- การบำรุงรักษา: คุณสามารถนำเซิร์ฟเวอร์ออกจากการให้บริการเพื่อบำรุงรักษาได้โดยที่ระบบยังคงทำงานอยู่

การตั้งค่า Health Checks (Basic)

ใน Nginx Open Source คุณสามารถใช้พารามิเตอร์ down, backup, max_fails, และ fail_timeout ในบล็อก upstream ได้ครับ

upstream backend_servers {

least_conn;

server 192.168.1.101:80 max_fails=3 fail_timeout=30s;

server 192.168.1.102:80 max_fails=3 fail_timeout=30s;

server 192.168.1.103:80 max_fails=3 fail_timeout=30s;

# server 192.168.1.104:80 backup; # เซิร์ฟเวอร์สำรอง จะถูกใช้เมื่อเซิร์ฟเวอร์หลักทั้งหมดล่ม

}max_fails=3: หาก Nginx ไม่สามารถเชื่อมต่อกับเซิร์ฟเวอร์ได้ 3 ครั้งติดต่อกันfail_timeout=30s: เซิร์ฟเวอร์นั้นจะถูกพิจารณาว่าล่มเป็นเวลา 30 วินาทีครับ Nginx จะลองส่งคำขอไปใหม่หลังจาก 30 วินาที และหากสำเร็จก็จะกลับมาใช้งานได้ตามปกติครับdown: ใช้เพื่อทำเครื่องหมายว่าเซิร์ฟเวอร์นั้นไม่พร้อมใช้งานเป็นการชั่วคราว (เช่น กำลังบำรุงรักษา)backup: เซิร์ฟเวอร์นี้จะถูกใช้เมื่อเซิร์ฟเวอร์หลักทั้งหมดในกลุ่มupstreamไม่พร้อมใช้งาน

นี่คือ Health Check พื้นฐานที่ Nginx Open Source มีให้ ซึ่งเป็นการตรวจสอบแบบ Passive Health Check คือจะตรวจสอบเมื่อมีการพยายามเชื่อมต่อเท่านั้นครับ

การตั้งค่า Health Checks (Advanced with Nginx Plus)

Nginx Plus มี Active Health Checks ที่มีความสามารถสูงกว่ามากครับ โดยจะมีการส่งคำขอทดสอบไปยัง Backend Servers เป็นประจำเพื่อตรวจสอบสถานะ ซึ่งสามารถกำหนดเงื่อนไขการตรวจสอบได้หลากหลาย เช่น ตรวจสอบ HTTP Status Code, เนื้อหาในหน้าเว็บ, หรือแม้กระทั่งการเชื่อมต่อ TCP ครับ

upstream backend_servers {

zone servers 64k; # จำเป็นสำหรับ health_check

server 192.168.1.101:80;

server 192.168.1.102:80;

server 192.168.1.103:80;

}

server {

# ... (ส่วนอื่น ๆ ของ server block) ...

location / {

proxy_pass http://backend_servers;

health_check; # เปิดใช้งาน health check ใน location นี้

# หรือ health_check uri=/health interval=5s fails=2 passes=3; เพื่อกำหนดรายละเอียด

}

}คุณสมบัติ Active Health Checks ใน Nginx Plus ช่วยให้ระบบมีความยืดหยุ่นและน่าเชื่อถือสูงมากครับ อ่านเพิ่มเติมเกี่ยวกับ Nginx Plus

การปรับแต่งประสิทธิภาพและความปลอดภัย

นอกจากการเป็น Reverse Proxy และ Load Balancer แล้ว Nginx ยังสามารถช่วยปรับปรุงประสิทธิภาพและความปลอดภัยของเว็บไซต์คุณได้อีกด้วยครับ

Buffer และ Timeout Settings

การตั้งค่า Buffer และ Timeout ที่เหมาะสมช่วยเพิ่มประสิทธิภาพและป้องกันปัญหาการเชื่อมต่อครับ

server {

# ...

proxy_connect_timeout 5s; # เวลาที่ Nginx พยายามเชื่อมต่อไปยัง Backend

proxy_send_timeout 5s; # เวลาที่ Nginx รอการส่งข้อมูลไปยัง Backend

proxy_read_timeout 15s; # เวลาที่ Nginx รอการอ่านข้อมูลจาก Backend

proxy_buffers 4 32k; # จำนวนและขนาดของ Buffer ที่ใช้เก็บข้อมูลจาก Backend

proxy_buffer_size 64k; # ขนาดของ Buffer สำหรับ Header จาก Backend

# ...

}Caching

Nginx สามารถทำ Caching ได้ในระดับ HTTP เพื่อลดภาระของ Backend Servers และเพิ่มความเร็วในการตอบสนองสำหรับ Static content หรือ Dynamic content ที่ไม่เปลี่ยนแปลงบ่อยครับ

# กำหนดพื้นที่สำหรับ cache

proxy_cache_path /var/cache/nginx levels=1:2 keys_zone=my_cache:10m inactive=60m use_temp_path=off;

server {

# ...

location / {

proxy_cache my_cache;

proxy_cache_valid 200 302 10m; # cache response code 200, 302 เป็นเวลา 10 นาที

proxy_cache_valid 404 1m; # cache response code 404 เป็นเวลา 1 นาที

proxy_cache_revalidate on;

proxy_cache_min_uses 1;

proxy_cache_background_update on;

proxy_cache_lock on;

add_header X-Cache-Status $upstream_cache_status;

proxy_pass http://backend_servers;

# ...

}

}Rate Limiting

ป้องกันการโจมตีแบบ Brute-force หรือ DoS/DDoS โดยการจำกัดจำนวนคำขอที่ผู้ใช้งานสามารถส่งมาได้ในช่วงเวลาหนึ่งครับ

# กำหนด zone สำหรับ rate limiting (จำกัด 100 คำขอต่อนาทีต่อ IP)

limit_req_zone $binary_remote_addr zone=mylimit:10m rate=100r/m;

server {

# ...

location / {

limit_req zone=mylimit burst=5 nodelay; # อนุญาตให้มี burst ได้ 5 คำขอ

proxy_pass http://backend_servers;

# ...

}

# ...

}Web Application Firewall (WAF) Integration

คุณสามารถรวม Nginx เข้ากับ WAF เช่น ModSecurity เพื่อเพิ่มชั้นความปลอดภัยในการป้องกันการโจมตีระดับแอปพลิเคชัน เช่น SQL Injection, XSS, หรือการโจมตี OWASP Top 10 อื่นๆ ครับ

# ตัวอย่างการเปิดใช้งาน ModSecurity (ต้องติดตั้ง ModSecurity Nginx Connector ก่อน)

# load_module modules/ngx_http_modsecurity_module.so; # ในไฟล์ nginx.conf

# server {

# # ...

# location / {

# modsecurity on;

# modsecurity_rules_file /etc/nginx/modsec/modsecurity.conf;

# proxy_pass http://backend_servers;

# # ...

# }

# }การมอนิเตอร์และแก้ไขปัญหา (Monitoring and Troubleshooting)

การเข้าใจวิธีการมอนิเตอร์และแก้ไขปัญหา Nginx เป็นสิ่งสำคัญเพื่อให้ระบบของคุณทำงานได้อย่างราบรื่นครับ

Nginx Logs

Nginx มี Access Log และ Error Log ที่เป็นประโยชน์อย่างมากในการตรวจสอบการทำงานและแก้ไขปัญหาครับ

- Access Log: บันทึกทุกคำขอที่เข้ามา (เช่น IP ผู้ใช้งาน, URI, Status Code, เวลาในการตอบสนอง)

- Error Log: บันทึกข้อผิดพลาดที่เกิดขึ้นใน Nginx

ไฟล์ Log มักจะอยู่ที่ /var/log/nginx/access.log และ /var/log/nginx/error.log ครับ

tail -f /var/log/nginx/access.log

tail -f /var/log/nginx/error.logคุณสามารถปรับระดับความละเอียดของ Error Log ได้ในไฟล์ nginx.conf หลัก:

error_log /var/log/nginx/error.log warn; # สามารถเปลี่ยนเป็น info, notice, debug ได้Nginx Status Module

Nginx มีโมดูล ngx_http_stub_status_module ที่ช่วยให้คุณสามารถดูข้อมูลสถานะการทำงานของ Nginx ได้แบบเรียลไทม์ เช่น จำนวนการเชื่อมต่อที่ใช้งานอยู่ จำนวนคำขอที่ประมวลผลไปแล้ว เป็นต้นครับ

เปิดใช้งานโดยเพิ่มในไฟล์คอนฟิกูเรชัน:

server {

listen 80;

server_name your_nginx_ip_or_hostname; # หรือจะใช้ localhost ก็ได้

location /nginx_status {

stub_status on;

allow 127.0.0.1; # อนุญาตให้เข้าถึงจาก IP นี้เท่านั้น

deny all;

}

}จากนั้นคุณสามารถเข้าถึงได้ที่ http://your_nginx_ip/nginx_status ครับ

เครื่องมือภายนอก

สำหรับการมอนิเตอร์ระดับ Production คุณอาจต้องการใช้เครื่องมือภายนอก เช่น:

- Prometheus & Grafana: สำหรับการรวบรวมและแสดงผล Metric ต่างๆ ของ Nginx และ Backend Servers

- ELK Stack (Elasticsearch, Logstash, Kibana): สำหรับการรวบรวม วิเคราะห์ และแสดงผล Log

- Datadog, New Relic, Dynatrace: เครื่องมือ APM (Application Performance Monitoring) เชิงพาณิชย์

คำถามที่พบบ่อย (FAQ)

Nginx Reverse Proxy แตกต่างจาก Forward Proxy อย่างไรครับ?

ครับ ทั้ง Reverse Proxy และ Forward Proxy เป็นตัวกลางในการสื่อสาร แต่มีทิศทางการทำงานที่ตรงกันข้ามกันครับ

- Forward Proxy: ทำงานในฝั่ง Client ครับ ผู้ใช้งาน (Client) จะตั้งค่าเบราว์เซอร์หรือแอปพลิเคชันให้ส่งคำขอทั้งหมดผ่าน Forward Proxy ก่อนที่ Proxy จะส่งคำขอออกไปที่อินเทอร์เน็ตครับ ประโยชน์คือการซ่อน IP ของ Client, การเข้าถึงเนื้อหาที่ถูกบล็อกในบางพื้นที่, หรือการทำ Caching เพื่อเพิ่มความเร็วครับ

- Reverse Proxy: ทำงานในฝั่ง Server ครับ ตั้งอยู่ด้านหน้าของ Web Server จริงๆ และรับคำขอจาก Client โดยตรง จากนั้น Reverse Proxy จะส่งต่อคำขอเหล่านั้นไปยัง Backend Servers ที่เหมาะสมครับ ประโยชน์คือการเพิ่มความปลอดภัย, Load Balancing, SSL Termination และ Caching ครับ

สรุปง่ายๆ คือ Forward Proxy ปกป้อง Client และทำหน้าที่แทน Client ส่วน Reverse Proxy ปกป้อง Server และทำหน้าที่แทน Server ครับ

เราควรใช้ Load Balancing Algorithm แบบไหนดีที่สุดครับ?

ไม่มี Algorithm ไหนที่ดีที่สุดสำหรับทุกสถานการณ์ครับ การเลือก Algorithm ที่เหมาะสมขึ้นอยู่กับลักษณะของแอปพลิเคชันของคุณ:

- Round Robin: เหมาะสำหรับ Backend Servers ที่มีทรัพยากรและความสามารถเท่ากัน และคำขอแต่ละรายการมีภาระงานใกล้เคียงกันครับ เป็นตัวเลือกเริ่มต้นที่ดีที่สุดครับ

- Least Connected: เหมาะสำหรับแอปพลิเคชันที่คำขอแต่ละรายการมีภาระงานที่แตกต่างกันอย่างมากครับ ช่วยกระจายโหลดได้สมดุลมากขึ้นโดยพิจารณาจากภาระงานจริงของเซิร์ฟเวอร์ครับ

- IP Hash: จำเป็นเมื่อคุณต้องการ Session Persistence (Sticky Sessions) โดยไม่ต้องการใช้ Cookie หรือกลไกที่ซับซ้อนกว่าครับ

- Nginx Plus Algorithms (Least Time, Generic Hash, Random): เหมาะสำหรับ Production Environment ที่ต้องการประสิทธิภาพสูงสุด, มีความซับซ้อนในการจัดการ Session หรือต้องการความยืดหยุ่นในการกระจายโหลดครับ

สิ่งสำคัญคือต้องทดสอบและมอนิเตอร์ประสิทธิภาพของระบบด้วย Algorithm ต่างๆ เพื่อหาตัวเลือกที่เหมาะสมที่สุดสำหรับคุณครับ

Nginx สามารถทำ Load Balancing ให้กับ Database Servers ได้ไหมครับ?

Nginx โดยปกติแล้วถูกออกแบบมาเพื่อจัดการการเชื่อมต่อ HTTP/HTTPS ครับ แม้ว่า Nginx จะมีโมดูล Stream (TCP/UDP) ที่สามารถใช้ทำ Load Balancing สำหรับโปรโตคอลที่ไม่ใช่ HTTP ได้ (เช่น TCP สำหรับ Database Servers) แต่มันก็ไม่ได้มีความสามารถที่ซับซ้อนเท่ากับ Load Balancer เฉพาะทางสำหรับ Database ครับ

สำหรับการทำ Load Balancing ให้กับ Database Servers โดยเฉพาะ มักนิยมใช้โซลูชันที่ออกแบบมาโดยเฉพาะ เช่น:

- HAProxy: เป็น Load Balancer ที่มีความสามารถสูงและยืดหยุ่นมาก สามารถทำ Load Balancing ได้ทั้ง HTTP และ TCP/SSL ครับ

- ProxySQL: สำหรับ MySQL โดยเฉพาะ สามารถทำ Load Balancing, Failover, Query Rewriting และ Caching ได้ครับ

- Driver-level Load Balancing: บาง Database Driver มีความสามารถในการเชื่อมต่อไปยัง Database Cluster และกระจาย Query ได้เองครับ

ดังนั้น โดยสรุปคือ Nginx สามารถทำ Load Balancing สำหรับ Database (TCP) ได้ในระดับพื้นฐาน แต่หากต้องการคุณสมบัติขั้นสูงและประสิทธิภาพที่ดีที่สุด ควรพิจารณาใช้เครื่องมือเฉพาะทางครับ

ถ้า Nginx Reverse Proxy ล่ม จะเกิดอะไรขึ้นครับ?

หาก Nginx Reverse Proxy ซึ่งเป็น Single Point of Failure ล่มลง เว็บไซต์หรือแอปพลิเคชันทั้งหมดของคุณก็จะหยุดทำงานและไม่สามารถเข้าถึงได้ทันทีครับ ไม่ว่า Backend Servers จะยังคงทำงานอยู่ก็ตาม เพราะ Nginx เป็นด่านหน้าในการรับคำขอทั้งหมดครับ

เพื่อป้องกันปัญหานี้ คุณควรตั้งค่า High Availability (HA) สำหรับ Nginx Reverse Proxy ของคุณด้วยครับ โดยทั่วไปจะทำได้โดย:

- มี Nginx Reverse Proxy สองเครื่องหรือมากกว่า: ทำงานแบบ Active-Passive หรือ Active-Active

- ใช้ Virtual IP (VIP) หรือ Floating IP: ร่วมกับเครื่องมือเช่น Keepalived หรือ Pacemaker/Corosync เพื่อให้ IP Address สาธารณะสามารถย้ายไปยัง Nginx ตัวสำรองได้โดยอัตโนมัติหาก Nginx ตัวหลักล้มเหลวครับ

การทำ HA สำหรับ Nginx Reverse Proxy เป็นสิ่งสำคัญอย่างยิ่งสำหรับ Production Environment เพื่อลด Downtime และเพิ่มความเสถียรของระบบโดยรวมครับ

Nginx Plus คุ้มค่ากับการลงทุนไหมครับ?

การตัดสินใจว่าจะลงทุนใน Nginx Plus หรือไม่นั้นขึ้นอยู่กับความต้องการและขนาดของธุรกิจของคุณครับ Nginx Plus เป็นเวอร์ชันเชิงพาณิชย์ของ Nginx ที่มาพร้อมกับคุณสมบัติและบริการเพิ่มเติมที่ไม่มีใน Nginx Open Source เช่น:

- Active Health Checks: การตรวจสอบสถานะ Backend Servers ที่ละเอียดและยืดหยุ่นกว่า

- Advanced Load Balancing Algorithms: เช่น Least Time, Generic Hash, Random

- Session Persistence (Sticky Cookie): ที่เสถียรและจัดการได้ดีกว่า IP Hash

- API สำหรับการตั้งค่าแบบ Dynamic: สามารถปรับเปลี่ยน Upstream Servers ได้โดยไม่ต้อง Reload Nginx

- Live Activity Monitoring: แดชบอร์ดสำหรับมอนิเตอร์สถานะแบบเรียลไทม์

- การสนับสนุนลูกค้าโดยตรง: จากทีมงาน Nginx Inc.

หากคุณกำลังรันเว็บไซต์หรือแอปพลิเคชันที่มีการเข้าชมสูง มีความต้องการด้านประสิทธิภาพและความน่าเชื่อถือที่เข้มงวด ต้องการคุณสมบัติการมอนิเตอร์และการจัดการที่ซับซ้อน หรือต้องการการสนับสนุนทางเทคนิคโดยตรง Nginx Plus ก็ถือเป็นการลงทุนที่คุ้มค่ามากครับ แต่สำหรับโปรเจกต์ขนาดเล็กหรือกลาง Nginx Open Source ก็เพียงพอต่อความต้องการส่วนใหญ่แล้วครับ

สรุป: ก้าวสู่โครงสร้างพื้นฐานเว็บที่แข็งแกร่ง

การตั้งค่า Nginx ให้ทำหน้าที่เป็น Reverse Proxy และ Load Balancer เป็นหนึ่งในกลยุทธ์ที่ทรงพลังที่สุดในการสร้างโครงสร้างพื้นฐานเว็บที่แข็งแกร่ง มีประสิทธิภาพ และปรับขนาดได้ในโลกดิจิทัลปัจจุบันครับ ตลอดบทความนี้ เราได้เรียนรู้ตั้งแต่แนวคิดพื้นฐานของ Nginx, Reverse Proxy และ Load Balancing ไปจนถึงขั้นตอนการตั้งค่าที่ละเอียด การเลือก Load Balancing Algorithms ที่เหมาะสม การจัดการ SSL/TLS Termination การทำ Health Checks และเทคนิคการปรับปรุงประสิทธิภาพและความปลอดภัยต่างๆ ครับ

ด้วย Nginx คุณไม่เพียงแค่กระจายโหลดการทำงานไปยังเซิร์ฟเวอร์หลายเครื่องเท่านั้น แต่ยังเพิ่มชั้นความปลอดภัยให้กับ Backend Servers, ปรับปรุงความเร็วในการโหลดเว็บไซต์ด้วย Caching, จัดการการเชื่อมต่อได้อย่างมี