บทนำ: เมื่อ Kubernetes Network Policy พบกับ MLOps Workflow ในปี 2026

ในยุคที่ Machine Learning Operations (MLOps) กลายเป็นหัวใจสำคัญขององค์กรที่ขับเคลื่อนด้วยข้อมูล การจัดการโครงสร้างพื้นฐานด้านเครือข่ายภายใน Kubernetes คลัสเตอร์จึงมีความซับซ้อนมากขึ้นเป็นเท่าตัว โดยเฉพาะอย่างยิ่งเมื่อต้องรับมือกับ Workflow การเทรนโมเดล การปรับแต่ง Hyperparameter การ Deploy โมเดล และการจัดการ Data Pipeline ที่ต้องสื่อสารกันอย่างมีประสิทธิภาพและปลอดภัย

Kubernetes Network Policy เป็นเครื่องมือที่ช่วยให้เราสามารถควบคุมการไหลของ Traffic ระหว่าง Pod ต่างๆ ได้อย่าง granular ซึ่งในบริบทของ MLOps แล้ว นี่คือสิ่งที่ขาดไม่ได้เลยทีเดียว เพราะ Workflow หนึ่งๆ อาจประกอบด้วย Component หลายสิบตัวที่ทำงานร่วมกัน ตั้งแต่ Data Ingestion, Feature Engineering, Model Training, ไปจนถึง Model Serving และ Monitoring

บทความนี้จะพาคุณไปทำความเข้าใจอย่างลึกซึ้งเกี่ยวกับการออกแบบและ implement Kubernetes Network Policy สำหรับ MLOps Workflow ในปี 2026 พร้อมตัวอย่างการใช้งานจริงที่สามารถนำไปปรับใช้ได้ทันที

1. ทำความเข้าใจ MLOps Workflow บน Kubernetes

ก่อนที่เราจะพูดถึง Network Policy เราต้องเข้าใจภาพรวมของ MLOps Workflow ก่อน โดยทั่วไปแล้ว Workflow ประกอบด้วยขั้นตอนหลักดังนี้:

- Data Ingestion: การดึงข้อมูลจากแหล่งต่างๆ เช่น Database, Data Lake, หรือ Streaming Platform

- Data Validation & Preprocessing: การตรวจสอบความถูกต้องของข้อมูลและการแปลงข้อมูลให้พร้อมใช้งาน

- Feature Engineering: การสร้าง Feature ใหม่จากข้อมูลดิบ

- Model Training: การเทรนโมเดลด้วย Algorithm ต่างๆ

- Model Evaluation: การประเมินประสิทธิภาพของโมเดล

- Model Deployment: การนำโมเดลขึ้นให้บริการผ่าน API

- Monitoring & Logging: การติดตามประสิทธิภาพของโมเดลใน Production

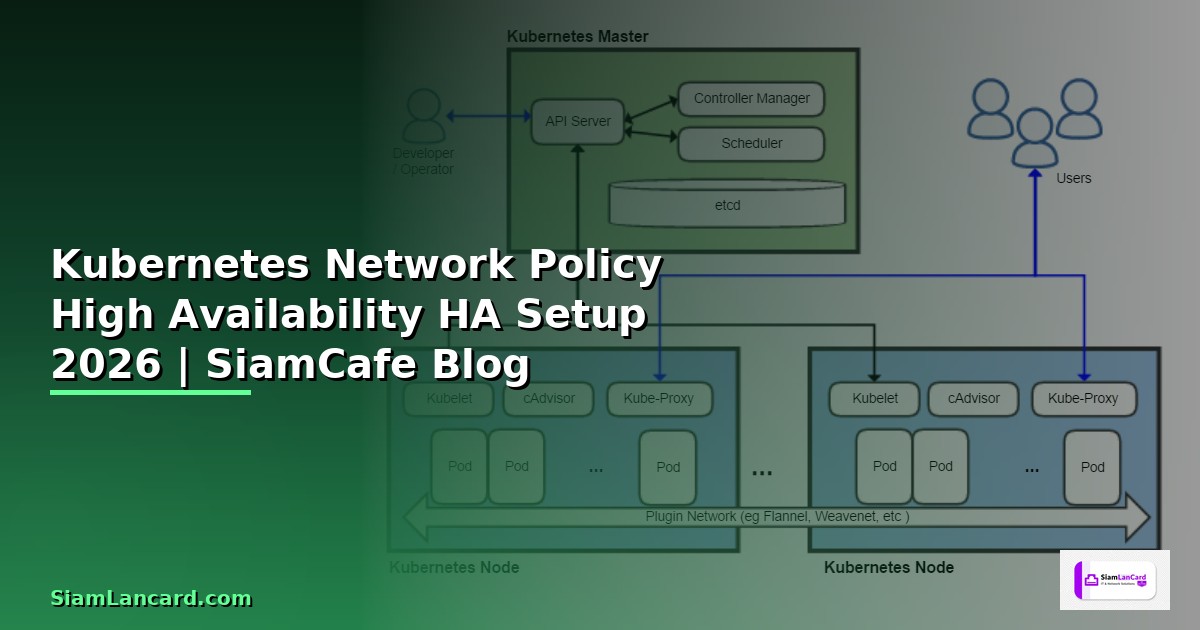

ใน Kubernetes แต่ละขั้นตอนเหล่านี้จะถูก implement เป็น Pod, Deployment, หรือ Job ที่ทำงานใน Namespace ต่างๆ ซึ่งการสื่อสารระหว่าง Component เหล่านี้จำเป็นต้องมี Network Policy ที่เหมาะสม

1.1 ความท้าทายด้านความปลอดภัยใน MLOps Workflow

MLOps Workflow มีความเสี่ยงด้านความปลอดภัยหลายประการ เช่น:

- Data Leakage: ข้อมูลที่ใช้เทรนโมเดลอาจรั่วไหลไปยัง Pod อื่นที่ไม่เกี่ยวข้อง

- Model Poisoning: ผู้ไม่หวังดีอาจแทรกแซงโมเดลระหว่างการเทรน

- Unauthorized Access: Pod ที่ไม่ได้รับอนุญาตอาจเข้าถึง Model Serving Endpoint

- Dependency Confusion: การใช้ Image ที่ไม่ปลอดภัยจาก Registry ภายนอก

Network Policy ช่วยลดความเสี่ยงเหล่านี้ได้โดยการจำกัด Traffic ให้เฉพาะ Pod ที่จำเป็นต้องสื่อสารกันเท่านั้น

2. พื้นฐาน Kubernetes Network Policy ที่ต้องรู้

Kubernetes Network Policy คือ Resource ชนิดหนึ่งที่ใช้ควบคุมการไหลของ Traffic ระหว่าง Pod และระหว่าง Pod กับ Service ภายนอกคลัสเตอร์ โดยทำงานที่ Layer 3 และ Layer 4 ของ OSI Model (IP Address และ Port)

หลักการสำคัญของ Network Policy คือ:

- Default Deny: หากไม่มี Policy กำหนดไว้ Traffic ทั้งหมดจะถูกปฏิเสธ (ขึ้นอยู่กับ CNI Plugin)

- Allow by Exception: เราต้องระบุอย่างชัดเจนว่า Traffic ใดบ้างที่อนุญาต

- Namespace Isolation: สามารถจำกัด Traffic ให้อยู่ภายใน Namespace เดียวกันหรือข้าม Namespace ได้

2.1 ส่วนประกอบของ Network Policy

| ส่วนประกอบ | คำอธิบาย | ตัวอย่าง |

|---|---|---|

| podSelector | เลือก Pod เป้าหมายที่ Policy นี้จะบังคับใช้ | |

| policyTypes | ระบุว่า Policy นี้ใช้กับ Ingress (ขาเข้า) หรือ Egress (ขาออก) | |

| ingress | กำหนดกฎสำหรับ Traffic ขาเข้า | |

| egress | กำหนดกฎสำหรับ Traffic ขาออก |

2.2 ตัวอย่าง Network Policy พื้นฐาน

Policy ด้านบนอนุญาตให้เฉพาะ Pod ที่มี Label เท่านั้นที่สามารถส่ง Traffic ไปยัง Pod ที่ Port 8080 ได้

3. การออกแบบ Network Policy สำหรับ MLOps Workflow

การออกแบบ Network Policy สำหรับ MLOops จำเป็นต้องคำนึงถึงลักษณะการทำงานของแต่ละ Component และความสัมพันธ์ระหว่างกัน เราจะแบ่ง Component ออกเป็นกลุ่มตามหน้าที่:

3.1 Data Layer

- Data Ingestion Pod: ต้องสามารถเข้าถึงแหล่งข้อมูลภายนอก (เช่น Database, S3, Kafka)

- Feature Store: ต้องรับ Traffic จาก Data Ingestion และ Feature Engineering Pod

- Data Validation Pod: ต้องเข้าถึง Feature Store เพื่อตรวจสอบข้อมูล

3.2 Training Layer

- Training Job: ต้องเข้าถึง Feature Store และอาจต้องเข้าถึง Model Registry

- Hyperparameter Tuning Job: ต้องเข้าถึง Training Job และ Model Registry

- Model Evaluation Pod: ต้องเข้าถึง Model Registry และ Dataset

3.3 Serving Layer

- Model Server: ต้องรับ Traffic จาก API Gateway และอาจต้องเข้าถึง Feature Store สำหรับ Online Feature

- Prediction Service: ต้องรับ Traffic จาก Client ภายนอกผ่าน Ingress Controller

3.4 Monitoring Layer

- Monitoring Agent: ต้องเข้าถึงทุก Pod เพื่อเก็บ Metrics

- Logging Agent: ต้องเข้าถึงทุก Pod เพื่อเก็บ Logs

- Alerting System: ต้องเข้าถึง Monitoring Data

4. การ Implement Network Policy สำหรับ MLOps Workflow

ในส่วนนี้เราจะสร้าง Network Policy สำหรับแต่ละ Layer อย่างละเอียด โดยใช้ตัวอย่างจากสถานการณ์จริง

4.1 Policy สำหรับ Data Layer

4.2 Policy สำหรับ Training Layer

4.3 Policy สำหรับ Serving Layer

5. การจัดการ Network Policy สำหรับ Multi-Tenant MLOps

ในองค์กรขนาดใหญ่ มักจะมีหลายทีมที่ใช้ Kubernetes คลัสเตอร์ร่วมกัน ซึ่งจำเป็นต้องมี Network Policy ที่รองรับ Multi-Tenancy

5.1 การใช้ Namespace Isolation

เราสามารถใช้ Namespace เพื่อแยก Workflow ของแต่ละทีมออกจากกัน และสร้าง Network Policy ที่อนุญาตให้เฉพาะ Namespace ที่เกี่ยวข้องเท่านั้นที่สื่อสารกันได้

| Namespace | ทีมที่รับผิดชอบ | Component ที่ทำงาน | นโยบาย Network |

|---|---|---|---|

| ml-team-a | ทีม A (Recommendation) | Data Ingestion, Training, Serving | จำกัดเฉพาะภายใน Namespace และเชื่อมต่อกับ Shared Service |

| ml-team-b | ทีม B (NLP) | Data Ingestion, Training, Serving | จำกัดเฉพาะภายใน Namespace และเชื่อมต่อกับ Shared Service |

| shared-services | ทีม Platform | Feature Store, Model Registry, Monitoring | อนุญาตให้เฉพาะ Namespace ที่ได้รับอนุญาตเท่านั้น |

| ingress-system | ทีม Infrastructure | API Gateway, Ingress Controller | อนุญาตให้เข้าถึง Model Server ในทุก Namespace |

5.2 ตัวอย่าง Policy สำหรับ Multi-Tenant

6. Best Practices สำหรับ Kubernetes Network Policy ใน MLOps

จากการทำงานจริงกับองค์กรหลายแห่ง เราได้รวบรวม Best Practices ที่สำคัญดังนี้:

- เริ่มต้นด้วย Default Deny เสมอ: สร้าง Network Policy ที่ปฏิเสธ Traffic ทั้งหมดใน Namespace ก่อน แล้วค่อยเพิ่มกฎอนุญาตทีละรายการ

- ใช้ Label อย่างมีระบบ: กำหนด Label Standard เช่น , , เพื่อให้ง่ายต่อการอ้างอิงใน Policy

- แยก Policy ตามหน้าที่: ไม่ควรรวมกฎทั้งหมดไว้ใน Policy เดียว ควรแยกเป็น Policy ย่อยๆ เพื่อความชัดเจนและง่ายต่อการจัดการ

- ใช้ NamespaceSelector ร่วมกับ PodSelector: เพื่อควบคุม Traffic ข้าม Namespace อย่างปลอดภัย

- ทดสอบ Policy ก่อนใช้งานจริง: ใช้เครื่องมือเช่น หรือ เพื่อจำลองและทดสอบ Policy

- บันทึกการเปลี่ยนแปลง: ใช้ Version Control สำหรับ Network Policy YAML Files เช่นเดียวกับ Code ปกติ

- ตรวจสอบ Logs เป็นประจำ: ใช้ Network Policy Audit Logs เพื่อตรวจจับ Traffic ที่ผิดปกติ

- ใช้ Service Mesh (Optional): สำหรับองค์กรที่ต้องการความสามารถขั้นสูง เช่น mTLS, Traffic Mirroring, และ Fine-grained Policy

7. การ Troubleshoot Network Policy

ปัญหาที่พบบ่อยเมื่อทำงานกับ Network Policy มีดังนี้:

7.1 ปัญหาที่พบบ่อย

- Traffic ถูก Block โดยไม่ตั้งใจ: มักเกิดจาก Policy ที่เข้มงวดเกินไป หรือลืมเพิ่มกฎอนุญาต

- Policy ไม่ทำงาน: อาจเกิดจาก CNI Plugin ไม่รองรับ Network Policy หรือ Policy ถูกสร้างใน Namespace ผิด

- Performance Degradation: การมี Policy จำนวนมากอาจทำให้ CNI Plugin ทำงานช้าลง

7.2 เครื่องมือสำหรับ Troubleshoot

8. ตัวอย่างการใช้งานจริง (Real-World Use Case)

8.1 กรณีศึกษา: บริษัท E-commerce ขนาดใหญ่

บริษัท E-commerce แห่งหนึ่งใช้ Kubernetes สำหรับ MLOps Workflow ที่ประกอบด้วย:

- ระบบ Recommendation แบบ Real-time

- ระบบ Fraud Detection

- ระบบ Search Ranking

- ระบบ Inventory Forecasting

ความท้าทายคือ แต่ละระบบต้องการเข้าถึงข้อมูลร่วมกัน (User Profile, Product Catalog) แต่ต้องไม่รบกวนกัน และต้องปลอดภัยจากการโจมตี

วิธีแก้ไข:

- สร้าง Namespace แยกสำหรับแต่ละระบบ: , , ,

- สร้าง Shared Namespace สำหรับ Data Service:

- ใช้ Network Policy ที่อนุญาตให้เฉพาะ Pod ที่จำเป็นเท่านั้นที่เข้าถึง Shared Service

- ใช้ Service Mesh (Istio) สำหรับ mTLS และ Authorization Policy เพิ่มเติม

ผลลัพธ์: ระบบทำงานได้อย่างมีประสิทธิภาพ ลดความเสี่ยงด้านความปลอดภัย และสามารถเพิ่มระบบใหม่ได้โดยไม่กระทบระบบเดิม

8.2 กรณีศึกษา: สถาบันการเงิน

สถาบันการเงินแห่งหนึ่งต้องการใช้ MLOps สำหรับ Credit Scoring และ Anti-Money Laundering (AML) ซึ่งมีข้อกำหนดด้าน Compliance ที่เข้มงวด

ความต้องการ:

- ข้อมูลลูกค้าต้องถูกแยกอย่างเด็ดขาด

- Model Training ต้องเกิดขึ้นใน Environment ที่แยกจาก Production

- ต้องมี Audit Log สำหรับทุกการเข้าถึงข้อมูล

วิธีแก้ไข:

- ใช้ Network Policy ที่เข้มงวดมาก: Default Deny ทุกอย่าง ยกเว้นที่จำเป็น

- สร้าง Network Policy ที่อนุญาตให้เฉพาะ Pod ที่มี Label เท่านั้นที่เข้าถึง Database

- ใช้ Egress Policy ที่จำกัด Traffic ขาออกจาก Training Pod ให้ไปได้เฉพาะ Feature Store และ Model Registry เท่านั้น

- ใช้ Network Policy Audit Logging กับทุก Namespace

ผลลัพธ์: ผ่านการตรวจสอบ Compliance และสามารถตรวจสอบย้อนหลังได้ทุกรายการ

9. อนาคตของ Network Policy ใน MLOps (2026 และ Beyond)

ในปี 2026 เราคาดการณ์ว่า Kubernetes Network Policy จะพัฒนาไปในทิศทางดังนี้:

- Integration กับ AI/ML: การใช้ Machine Learning เพื่อแนะนำ Network Policy ที่เหมาะสมโดยอัตโนมัติ

- Policy as Code: การใช้ Policy Engine เช่น OPA/Gatekeeper เพื่อจัดการ Network Policy ร่วมกับ Policy อื่นๆ

- Zero Trust Networking: การนำหลักการ Zero Trust มาใช้กับ Kubernetes Network อย่างเต็มรูปแบบ

- Multi-Cluster Policy: การจัดการ Network Policy ที่ครอบคลุมหลาย Kubernetes Cluster

- eBPF-based CNI: การใช้ eBPF เพื่อเพิ่มประสิทธิภาพและความสามารถของ Network Policy

Summary

Kubernetes Network Policy เป็นเครื่องมือที่ทรงพลังสำหรับการรักษาความปลอดภัยให้กับ MLOps Workflow ในยุคที่ข้อมูลและโมเดล Machine Learning มีมูลค่ามหาศาล การออกแบบและ Implement Network Policy อย่างถูกต้องจะช่วยปกป้องข้อมูลสำคัญ ป้องกันการโจมตี และทำให้ระบบ MLOps ทำงานได้อย่างมีประสิทธิภาพ

จากที่เราได้เรียนรู้ในบทความนี้ สิ่งสำคัญคือการเริ่มต้นด้วย Default Deny, การใช้ Label อย่างเป็นระบบ, การแยก Policy ตามหน้าที่, และการทดสอบอย่างละเอียดก่อนนำไปใช้งานจริง นอกจากนี้ การใช้ Namespace Isolation และ Multi-Tenant Policy จะช่วยให้องค์กรขนาดใหญ่สามารถจัดการ MLOps Workflow ได้อย่างปลอดภัยและยืดหยุ่น

สุดท้ายนี้ อย่าลืมว่า Network Policy เป็นเพียงส่วนหนึ่งของความปลอดภัยโดยรวม ควรใช้ร่วมกับมาตรการอื่นๆ เช่น RBAC, Service Mesh, Secret Management, และ Image Scanning เพื่อสร้างระบบ MLOps ที่ปลอดภัยอย่างแท้จริง

สำหรับองค์กรที่กำลังเริ่มต้นหรือต้องการปรับปรุงระบบ MLOps ของตนเอง การลงทุนในการออกแบบ Network Policy ตั้งแต่ต้นจะช่วยประหยัดเวลาและลดความเสี่ยงในระยะยาวได้อย่างมาก ขอให้ทุกท่านโชคดีกับการเดินทางในโลกของ MLOps บน Kubernetes!