ในโลกของการพัฒนาซอฟต์แวร์ที่หมุนไปอย่างรวดเร็ว หนึ่งในเทคโนโลยีที่ปฏิวัติวิธีการสร้าง จัดการ และปรับใช้แอปพลิเคชันอย่างแท้จริงคือ Kubernetes ครับ หากคุณเป็น DevOps มือใหม่ที่กำลังมองหาเส้นทางอาชีพที่มั่นคงและต้องการเป็นส่วนหนึ่งของการเปลี่ยนแปลงครั้งใหญ่ในอุตสาหกรรมไอที การทำความเข้าใจ Kubernetes คือก้าวแรกที่สำคัญที่สุดที่คุณต้องเดินไปให้ถึง และนี่ไม่ใช่แค่การเรียนรู้เทคโนโลยีใดเทคโนโลยีหนึ่งเท่านั้น แต่เป็นการเตรียมความพร้อมสำหรับอนาคตที่กำลังจะมาถึง ในปี 2026 Kubernetes จะไม่ใช่เพียงแค่เครื่องมือ แต่เป็นรากฐานสำคัญของระบบคลาวด์และโครงสร้างพื้นฐานยุคใหม่ วันนี้ SiamLancard.com จะพาคุณเจาะลึกทุกแง่มุมของ Kubernetes ตั้งแต่พื้นฐานไปจนถึงแนวคิดขั้นสูง พร้อมคำแนะนำที่เป็นประโยชน์สำหรับ DevOps มือใหม่โดยเฉพาะครับ

- ทำความเข้าใจโลกของ Kubernetes และ DevOps ในปี 2026

- เตรียมความพร้อมก่อนลงมือทำ: สภาพแวดล้อมและการติดตั้ง

- เริ่มต้นใช้งาน Kubernetes: พื้นฐานสู่การปฏิบัติ

- ก้าวต่อไปสำหรับ DevOps มือใหม่: แนวคิดขั้นสูงและ Best Practices

- เปรียบเทียบ Kubernetes กับทางเลือกอื่นๆ และข้อพิจารณา

- FAQ: คำถามที่พบบ่อยสำหรับ DevOps มือใหม่

- สรุปและก้าวต่อไป

ทำความเข้าใจโลกของ Kubernetes และ DevOps ในปี 2026

ก่อนที่เราจะดำดิ่งสู่โลกของ Kubernetes เรามาทำความเข้าใจบริบทที่ทำให้เทคโนโลยีนี้มีความสำคัญอย่างยิ่งต่อสายงาน DevOps กันก่อนนะครับ

วิวัฒนาการของ DevOps และ Containerization

ย้อนกลับไปไม่นาน การพัฒนาซอฟต์แวร์มักจะประสบปัญหาที่เรียกว่า “It works on my machine!” หรือ “มันรันได้บนเครื่องผมนะ!” ซึ่งหมายถึงแอปพลิเคชันที่ทำงานได้ดีในสภาพแวดล้อมของผู้พัฒนา แต่กลับล้มเหลวเมื่อย้ายไปยังสภาพแวดล้อมการทดสอบหรือการผลิต ปัญหานี้เกิดจากความไม่สอดคล้องกันของไลบรารี รันไทม์ หรือการตั้งค่าต่างๆ ครับ

- จาก Monolithic สู่ Microservices: แต่เดิมแอปพลิเคชันส่วนใหญ่เป็นแบบ Monolithic คือทุกฟังก์ชันการทำงานถูกรวมอยู่ในโค้ดเบสเดียว ทำให้การพัฒนา การทดสอบ และการปรับใช้เป็นเรื่องยากและใช้เวลานาน เมื่อธุรกิจเติบโต แอปพลิเคชันก็ซับซ้อนขึ้น การเปลี่ยนแปลงส่วนเล็กๆ อาจส่งผลกระทบต่อทั้งระบบ ทำให้เกิดความเสี่ยงสูง แนวคิด Microservices จึงถือกำเนิดขึ้น โดยแบ่งแอปพลิเคชันออกเป็นบริการย่อยๆ ที่ทำงานอิสระต่อกัน แต่ละบริการสามารถพัฒนา ปรับใช้ และขยายขนาดได้โดยไม่กระทบต่อบริการอื่นๆ ทำให้เกิดความยืดหยุ่นและคล่องตัวมากขึ้นครับ

- Docker และการปฏิวัติวงการ Containerization: การมาถึงของ Docker ในปี 2013 ได้เปลี่ยนแปลงวงการไปอย่างสิ้นเชิงครับ Docker ได้นำเสนอแนวคิด “Container” ซึ่งเป็นแพ็คเกจที่รวมโค้ดแอปพลิเคชัน ไลบรารี รันไทม์ และการตั้งค่าทั้งหมดที่จำเป็นต่อการรันแอปพลิเคชันไว้ในชุดเดียวกัน ทำให้แอปพลิเคชันสามารถทำงานได้อย่างสอดคล้องกันไม่ว่าจะถูกรันบนสภาพแวดล้อมใดก็ตาม เปรียบเสมือนการบรรจุสินค้าลงในตู้คอนเทนเนอร์มาตรฐาน ทำให้การขนส่ง (หรือการย้ายแอปพลิเคชัน) ทำได้ง่ายและรวดเร็วขึ้นมากครับ

แต่เมื่อมีคอนเทนเนอร์จำนวนมาก ปัญหาใหม่ก็เกิดขึ้น คือจะจัดการคอนเทนเนอร์เหล่านี้อย่างไร? จะรันคอนเทนเนอร์หลายตัวพร้อมกันได้อย่างไร? จะจัดการกับความผิดพลาดของคอนเทนเนอร์ได้อย่างไร? คำตอบคือ Container Orchestration ครับ และนี่คือจุดที่ Kubernetes เข้ามามีบทบาทสำคัญ

Kubernetes คืออะไร? ทำไมถึงสำคัญ?

Kubernetes (K8s) คือแพลตฟอร์ม Open-source สำหรับการจัดการ (Orchestration) คอนเทนเนอร์อัตโนมัติ ถูกพัฒนาโดย Google และปัจจุบันดูแลโดย Cloud Native Computing Foundation (CNCF) ครับ Kubernetes ช่วยให้คุณสามารถปรับใช้ (Deploy), ขยายขนาด (Scale), และจัดการ (Manage) แอปพลิเคชันที่เป็นคอนเทนเนอร์ได้อย่างมีประสิทธิภาพและเชื่อถือได้

ทำไม Kubernetes ถึงสำคัญ?

- Scalability (ความสามารถในการปรับขนาด): Kubernetes สามารถเพิ่มหรือลดจำนวนคอนเทนเนอร์ตามปริมาณการใช้งานโดยอัตโนมัติ ทำให้แอปพลิเคชันของคุณรองรับผู้ใช้จำนวนมากได้โดยไม่สะดุดครับ

- Resiliency (ความทนทานต่อข้อผิดพลาด): หากคอนเทนเนอร์ใดล้มเหลว Kubernetes จะตรวจจับและสร้างคอนเทนเนอร์ใหม่ขึ้นมาทดแทนโดยอัตโนมัติ ทำให้แอปพลิเคชันของคุณทำงานได้อย่างต่อเนื่อง

- Portability (ความสามารถในการพกพา): คุณสามารถรันแอปพลิเคชัน Kubernetes ได้ทุกที่ ไม่ว่าจะเป็นบนเครื่องของคุณเอง (On-premise), บนคลาวด์สาธารณะ (Public Cloud เช่น AWS, Azure, GCP), หรือบนคลาวด์ส่วนตัว (Private Cloud) ครับ

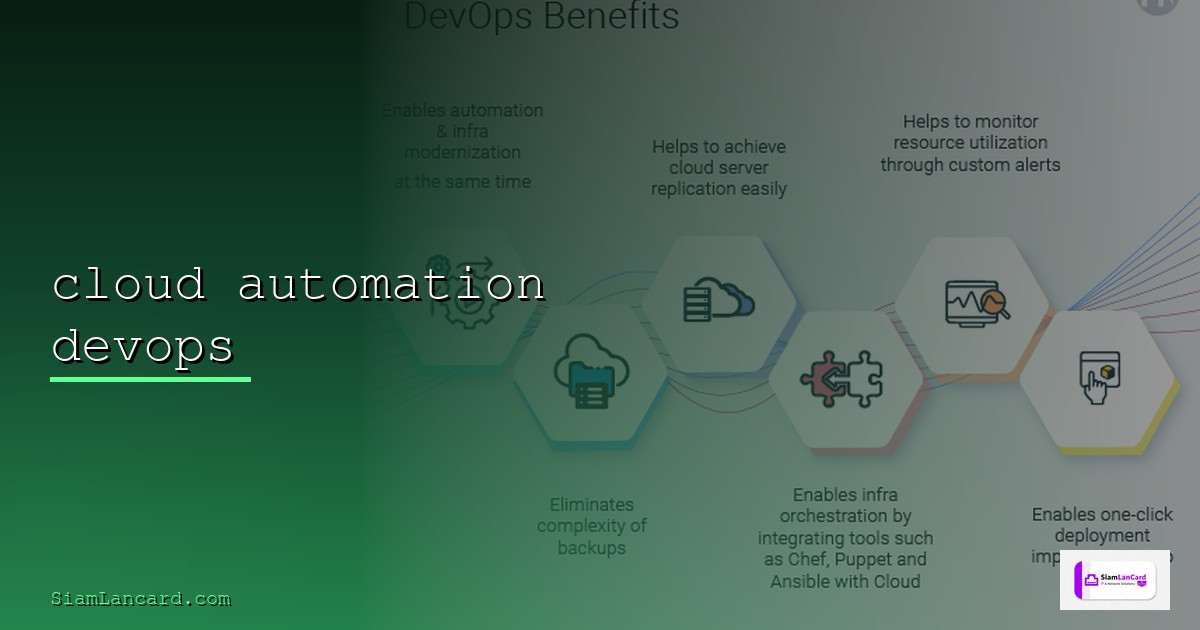

- Automation (ระบบอัตโนมัติ): Kubernetes ช่วยจัดการงานที่ซ้ำซากจำเจ เช่น การปรับใช้ การอัปเดต การตรวจสอบสถานะ และการกู้คืน ทำให้ทีม DevOps มีเวลาไปโฟกัสกับงานที่มีมูลค่าสูงกว่า

- Resource Management (การจัดการทรัพยากร): ช่วยให้การใช้ทรัพยากร CPU, Memory เป็นไปอย่างมีประสิทธิภาพสูงสุด ทำให้ประหยัดค่าใช้จ่ายได้ครับ

แนวโน้มในปี 2026 สำหรับ Kubernetes: ในปี 2026 เราจะเห็น Kubernetes พัฒนาไปในทิศทางที่น่าสนใจยิ่งขึ้นครับ

- AI/ML Workloads: Kubernetes จะเป็นแพลตฟอร์มหลักสำหรับการรัน Machine Learning (ML) และ Deep Learning (DL) Workloads ที่ต้องการทรัพยากรสูงและสามารถปรับขนาดได้ง่าย การบูรณาการกับ GPU และเครื่องมือ ML Ops จะลึกซึ้งยิ่งขึ้น

- Serverless Kubernetes: บริการคลาวด์ต่างๆ จะนำเสนอ “Serverless Kubernetes” มากขึ้น ทำให้ผู้ใช้สามารถรันแอปพลิเคชันบน Kubernetes โดยไม่ต้องจัดการ Node หรือ Control Plane ด้วยตัวเอง ช่วยลดภาระการดูแลระบบอย่างมาก

- Edge Kubernetes: การใช้งาน Kubernetes จะขยายไปสู่ Edge Computing มากขึ้น เพื่อรองรับอุปกรณ์ IoT และแอปพลิเคชันที่ต้องการ Latency ต่ำและประมวลผลข้อมูลใกล้แหล่งกำเนิด

- Wasm/WebAssembly: เทคโนโลยี WebAssembly (Wasm) จะเริ่มเข้ามามีบทบาทใน Kubernetes มากขึ้น โดยเฉพาะในด้านการรัน Workloads ที่ต้องการความเร็วและมี Footprint ขนาดเล็ก ซึ่งอาจเป็นทางเลือกใหม่นอกเหนือจาก Container ในบาง Use Case

- Security and Observability: เครื่องมือและแนวทางปฏิบัติในการรักษาความปลอดภัยและการตรวจสอบ (Monitoring & Logging) สำหรับ Kubernetes จะมีความซับซ้อนและสมบูรณ์แบบยิ่งขึ้น เพื่อรองรับความต้องการขององค์กรขนาดใหญ่ครับ

ศัพท์พื้นฐานที่ DevOps มือใหม่ควรรู้

ก่อนจะเริ่มลงมือทำ เรามาทำความเข้าใจคำศัพท์พื้นฐานที่สำคัญในโลกของ Kubernetes กันก่อนครับ

- Cluster: กลุ่มของเครื่องเซิร์ฟเวอร์ (Nodes) ที่ทำงานร่วมกันเพื่อรันแอปพลิเคชันที่เป็นคอนเทนเนอร์ เปรียบเสมือนศูนย์บัญชาการหลักของ Kubernetes ครับ

- Node: เครื่องเซิร์ฟเวอร์ (อาจเป็น Physical หรือ Virtual Machine) ใน Cluster ที่ทำหน้าที่รันคอนเทนเนอร์ Node แบ่งเป็น:

- Control Plane Node (Master Node): ทำหน้าที่ควบคุมและจัดการ Cluster ทั้งหมด

- Worker Node: ทำหน้าที่รัน Pods (ซึ่งบรรจุคอนเทนเนอร์)

- Pod: หน่วยพื้นฐานที่เล็กที่สุดที่สามารถปรับใช้ใน Kubernetes ได้ ภายใน Pod จะมีหนึ่งหรือหลายคอนเทนเนอร์ที่ทำงานร่วมกัน และมีทรัพยากรเครือข่ายและสตอเรจร่วมกันครับ

- Container: เป็นตัวบรรจุแอปพลิเคชันและทุกสิ่งที่จำเป็นต่อการรันแอปพลิเคชัน (โค้ด, รันไทม์, ไลบรารี, การตั้งค่า) เช่น Docker Container

- Deployment: วัตถุที่ใช้กำหนดวิธีการปรับใช้และจัดการ Pods โดยเฉพาะ ช่วยให้คุณกำหนดได้ว่าจะรัน Pod จำนวนเท่าใด และจะอัปเดต Pods เหล่านั้นอย่างไร Deployment จะสร้าง ReplicaSet เพื่อควบคุม Pods

- Service: เป็นวิธีการที่ใช้ในการเปิดเผยชุดของ Pods ให้สามารถเข้าถึงได้จากภายนอกหรือภายใน Cluster โดยให้ IP Address และ DNS Name ที่คงที่แก่ Pods นั้นๆ ครับ

- Ingress: เป็น API Object ที่ใช้จัดการการเข้าถึง HTTP/S ภายนอกไปยัง Services ภายใน Cluster โดยปกติจะให้ URL-based routing, Load balancing และ SSL termination

- Namespace: เป็นกลไกในการแบ่ง Cluster ออกเป็นส่วนย่อยๆ เพื่อจัดระเบียบและจัดการทรัพยากร ช่วยแยกแอปพลิเคชันหรือทีมงานออกจากกันใน Cluster เดียวกัน

- ConfigMap: ใช้สำหรับจัดเก็บข้อมูลการตั้งค่า (Configuration Data) ที่ไม่เป็นความลับ เช่น ตัวแปรสภาพแวดล้อม หรือไฟล์การตั้งค่า

- Secret: ใช้สำหรับจัดเก็บข้อมูลที่ละเอียดอ่อน เช่น รหัสผ่าน, API Keys, โทเค็น

- PersistentVolume (PV) / PersistentVolumeClaim (PVC):

- PersistentVolume (PV): เป็นส่วนหนึ่งของพื้นที่จัดเก็บข้อมูลใน Cluster ที่ถูกจัดเตรียมไว้ล่วงหน้า (Provisioned) โดยผู้ดูแลระบบ

- PersistentVolumeClaim (PVC): เป็นคำขอของผู้ใช้งานสำหรับพื้นที่จัดเก็บข้อมูลจาก PVs ที่มีอยู่

ข้อคิดสำหรับ DevOps มือใหม่: การเข้าใจคำศัพท์เหล่านี้เปรียบเสมือนการเรียนรู้พยัญชนะและสระในภาษาใหม่ครับ ยิ่งคุณเข้าใจความหมายและบทบาทของแต่ละส่วนมากเท่าไหร่ การเรียนรู้และใช้งาน Kubernetes ก็จะง่ายขึ้นเท่านั้นครับ

เตรียมความพร้อมก่อนลงมือทำ: สภาพแวดล้อมและการติดตั้ง

การเริ่มต้นใช้งาน Kubernetes ไม่ได้ซับซ้อนอย่างที่คิดครับ เราสามารถเริ่มต้นจากสภาพแวดล้อมในเครื่องของเราเองได้เลย

เครื่องมือที่จำเป็นสำหรับ DevOps มือใหม่

ก่อนจะลงมือติดตั้งและใช้งาน Kubernetes เรามาเตรียมเครื่องมือที่จำเป็นกันก่อนนะครับ

- Docker Desktop / Podman Desktop: เป็นโปรแกรมสำหรับรันและจัดการ Docker Container บนเครื่องของคุณเอง จำเป็นต้องติดตั้งเพื่อสร้างและทดสอบ Docker Image ก่อนนำไปใช้ใน Kubernetes ครับ

- kubectl: เป็น Command-Line Interface (CLI) ของ Kubernetes ใช้สำหรับสื่อสารกับ Kubernetes Cluster เพื่อปรับใช้ จัดการ และตรวจสอบสถานะของแอปพลิเคชัน

- Minikube / Kind: เป็นเครื่องมือสำหรับสร้าง Kubernetes Cluster ขนาดเล็กบนเครื่องของคุณเอง เหมาะสำหรับการเรียนรู้และพัฒนา โดย Minikube จะสร้าง VM ที่รัน Kubernetes ส่วน Kind จะรัน Kubernetes ใน Docker Container

- Git: สำหรับจัดการเวอร์ชันของโค้ดและไฟล์ YAML

- Text Editor / IDE: เช่น VS Code, Sublime Text สำหรับเขียนไฟล์ YAML และโค้ด

- Cloud Provider CLI (สำหรับใช้งานบน Cloud): หากคุณต้องการใช้งาน Kubernetes บน Cloud เช่น AWS EKS, Azure AKS, Google GKE คุณจะต้องติดตั้ง CLI ของผู้ให้บริการคลาวด์นั้นๆ (เช่น AWS CLI, Azure CLI, gcloud CLI) ครับ

ทางเลือกในการติดตั้ง Kubernetes

มีหลายวิธีในการติดตั้งและใช้งาน Kubernetes ซึ่งแต่ละวิธีก็มีข้อดีและข้อเสียแตกต่างกันไปครับ

- Kubernetes บน Local Machine (Minikube / Kind):

- ข้อดี: ติดตั้งง่าย, ไม่มีค่าใช้จ่าย, เหมาะสำหรับการเรียนรู้ ทดลอง และพัฒนาแอปพลิเคชัน

- ข้อเสีย: ประสิทธิภาพจำกัด, ไม่เหมาะสำหรับ Production Workloads

- เหมาะสำหรับ: DevOps มือใหม่, นักพัฒนา

- Kubernetes บน Cloud (Managed Kubernetes Services):

- ตัวอย่าง: Amazon EKS (Elastic Kubernetes Service), Azure AKS (Azure Kubernetes Service), Google GKE (Google Kubernetes Engine)

- ข้อดี: ง่ายต่อการจัดการ, มีความยืดหยุ่นสูง, ปรับขนาดได้ง่าย, มีความทนทานต่อข้อผิดพลาดสูง, มีบริการเสริมมากมายจากผู้ให้บริการคลาวด์

- ข้อเสีย: มีค่าใช้จ่าย, อาจมี Vendor Lock-in บ้าง, การเรียนรู้อาจต้องใช้เวลาสำหรับบริการเฉพาะของคลาวด์

- เหมาะสำหรับ: Production Workloads, องค์กรขนาดใหญ่, ทีมที่มีงบประมาณ

หากคุณสนใจศึกษาเพิ่มเติมเกี่ยวกับการใช้งาน Kubernetes บนคลาวด์ ลองดูบทความของเราเกี่ยวกับ การใช้งาน EKS บน AWS ได้นะครับ

- Kubernetes On-Premise (Kubeadm, Rancher, OpenShift):

- ข้อดี: ควบคุมได้สมบูรณ์, เหมาะสำหรับข้อมูลที่ต้องการความปลอดภัยสูงมาก, ไม่ต้องพึ่งพาผู้ให้บริการคลาวด์

- ข้อเสีย: ซับซ้อนในการติดตั้งและดูแลรักษา, ต้องลงทุน Hardware สูง, ต้องมีทีมงานที่มีความเชี่ยวชาญสูง

- เหมาะสำหรับ: องค์กรที่มีข้อกำหนดด้านความปลอดภัยหรือข้อบังคับที่เข้มงวด, องค์กรขนาดใหญ่ที่มีทีม Infrastructure ที่แข็งแกร่ง

ตัวอย่างการติดตั้ง Minikube สำหรับการเรียนรู้

สำหรับ DevOps มือใหม่ ผมแนะนำให้เริ่มต้นด้วย Minikube ครับ เพราะติดตั้งง่ายและให้ประสบการณ์การใช้งาน Kubernetes แบบ Full-featured บนเครื่องของคุณเอง

ขั้นตอนการติดตั้ง Minikube (บน macOS/Linux):

-

ติดตั้ง Docker Desktop / Podman Desktop: ตรวจสอบให้แน่ใจว่าคุณได้ติดตั้ง Docker Desktop (หรือ Podman Desktop) และรันอยู่บนเครื่องของคุณแล้ว เพราะ Minikube สามารถใช้ Docker เป็น Driver ได้ครับ

-

ติดตั้ง kubectl:

# สำหรับ macOS (ใช้ Homebrew) brew install kubectl # สำหรับ Linux (ตัวอย่างสำหรับ Debian/Ubuntu) sudo apt-get update && sudo apt-get install -y apt-transport-https ca-certificates curl curl -fsSL https://packages.cloud.google.com/apt/doc/apt-key.gpg | sudo gpg --dearmor -o /etc/apt/keyrings/kubernetes-archive.gpg echo "deb [signed-by=/etc/apt/keyrings/kubernetes-archive.gpg] https://apt.kubernetes.io/ kubernetes-xenial main" | sudo tee /etc/apt/sources.list.d/kubernetes.list sudo apt-get update sudo apt-get install -y kubectl -

ติดตั้ง Minikube:

# สำหรับ macOS (ใช้ Homebrew) brew install minikube # สำหรับ Linux (ตัวอย่างสำหรับ Debian/Ubuntu) curl -LO https://storage.googleapis.com/minikube/releases/latest/minikube-linux-amd64 sudo install minikube-linux-amd64 /usr/local/bin/minikube -

เริ่ม Minikube Cluster:

คุณสามารถเลือก Driver ได้หลายแบบ เช่น Docker (แนะนำสำหรับมือใหม่), VirtualBox, KVM, Hyper-V

minikube start --driver=dockerคำสั่งนี้จะสร้าง Kubernetes Cluster ขนาดเล็กภายใน Docker Container ครับ อาจใช้เวลาสักครู่ในการดาวน์โหลด Image ต่างๆ เมื่อเสร็จแล้ว คุณจะเห็นข้อความประมาณว่า “Done! kubectl is now configured to use “minikube” cluster and “default” namespace by default”

-

ตรวจสอบสถานะ Cluster:

kubectl cluster-info kubectl get nodesคุณควรจะเห็น Node ที่ชื่อ ‘minikube’ อยู่ในสถานะ Ready ครับ

-

หยุดและลบ Minikube Cluster (เมื่อไม่ใช้งาน):

minikube stop # หยุด Cluster ชั่วคราว minikube delete # ลบ Cluster และทรัพยากรทั้งหมด

เคล็ดลับ: การใช้ Minikube เป็นจุดเริ่มต้นที่ดีเยี่ยมครับ ลองเล่นกับมันให้คุ้นเคย สร้าง Pods, Deployments, Services เพื่อให้เข้าใจกระบวนการพื้นฐานก่อนที่จะก้าวไปสู่ Cloud Kubernetes ครับ

เริ่มต้นใช้งาน Kubernetes: พื้นฐานสู่การปฏิบัติ

เมื่อเราติดตั้ง Minikube และ kubectl เรียบร้อยแล้ว ก็ถึงเวลาลงมือปฏิบัติจริงกันครับ เราจะมาสร้างและจัดการแอปพลิเคชันบน Kubernetes โดยใช้ไฟล์ YAML ซึ่งเป็นหัวใจสำคัญในการกำหนดทรัพยากรต่างๆ ครับ

การสร้าง Pod แรกของคุณ

อย่างที่เราทราบกัน Pod คือหน่วยที่เล็กที่สุดใน Kubernetes ที่รันคอนเทนเนอร์ ลองมาสร้าง Pod ที่รัน Nginx Web Server กันดูนะครับ

สร้างไฟล์ชื่อ nginx-pod.yaml:

apiVersion: v1

kind: Pod

metadata:

name: nginx-pod-example

labels:

app: nginx

spec:

containers:

- name: nginx-container

image: nginx:latest

ports:

- containerPort: 80

คำอธิบายไฟล์ YAML:

apiVersion: v1: ระบุเวอร์ชันของ Kubernetes API ที่เรากำลังใช้งานkind: Pod: ชนิดของ Kubernetes Object ที่เราต้องการสร้างmetadata:: ข้อมูลเมตาสำหรับ Podname: nginx-pod-example: ชื่อของ Podlabels:: ป้ายกำกับ (Key-Value pairs) สำหรับระบุ Pod ซึ่งมีประโยชน์ในการจัดกลุ่มและค้นหา

spec:: รายละเอียดการกำหนดค่าของ Podcontainers:: รายการของคอนเทนเนอร์ที่จะรันภายใน Pod นี้- name: nginx-container: ชื่อของคอนเทนเนอร์image: nginx:latest: Docker Image ที่จะใช้ (ในที่นี้คือ Nginx เวอร์ชันล่าสุด)ports:: พอร์ตที่คอนเทนเนอร์เปิดรับการเชื่อมต่อ- containerPort: 80: คอนเทนเนอร์ Nginx จะเปิดรับการเชื่อมต่อที่พอร์ต 80

ปรับใช้ Pod:

kubectl apply -f nginx-pod.yaml

คุณจะเห็นข้อความยืนยันว่า pod/nginx-pod-example created

ตรวจสอบสถานะ Pod:

kubectl get pods

ผลลัพธ์ที่ได้ควรจะคล้ายกับ:

NAME READY STATUS RESTARTS AGE

nginx-pod-example 1/1 Running 0 30s

ลบ Pod:

kubectl delete -f nginx-pod.yaml

ข้อควรระวัง: การสร้าง Pod โดยตรงนั้นไม่แนะนำสำหรับ Production Workloads ครับ เพราะถ้า Pod ล้มเหลว Kubernetes จะไม่สร้าง Pod ใหม่ขึ้นมาแทนที่โดยอัตโนมัติ เราจึงควรใช้ Deployment แทนครับ

การจัดการ Deployments เพื่อความเสถียร

Deployment เป็น Kubernetes Object ที่แนะนำสำหรับการปรับใช้แอปพลิเคชัน เพราะมันช่วยจัดการ ReplicaSet ซึ่งรับผิดชอบในการสร้างและรักษาสถานะของ Pods ให้เป็นไปตามที่เราต้องการ ลองมาสร้าง Deployment สำหรับ Nginx กันครับ

สร้างไฟล์ชื่อ nginx-deployment.yaml:

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-deployment

labels:

app: nginx

spec:

replicas: 3 # กำหนดให้มี Pods Nginx 3 ตัว

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx-container

image: nginx:latest

ports:

- containerPort: 80

คำอธิบายไฟล์ YAML เพิ่มเติม:

apiVersion: apps/v1: เวอร์ชัน API สำหรับ Deploymentkind: Deployment: ชนิดของ Objectspec:replicas: 3: กำหนดให้ Kubernetes รัน Pods ที่มี Labelapp: nginxจำนวน 3 ตัวเสมอselector:: ใช้สำหรับระบุ Pods ที่ Deployment นี้จะจัดการ โดยจะเลือก Pods ที่มี Label ตรงกับmatchLabelstemplate:: เป็นส่วนที่อธิบาย Pod Template (โครงสร้างของ Pod) ที่ Deployment จะสร้างขึ้นมา

ปรับใช้ Deployment:

kubectl apply -f nginx-deployment.yaml

ตรวจสอบสถานะ Deployment และ Pods:

kubectl get deployments

kubectl get replicasets

kubectl get pods -l app=nginx # กรอง Pods ด้วย Label app=nginx

คุณจะเห็น Deployment, ReplicaSet และ Pods 3 ตัวที่ถูกสร้างขึ้นมา

ทดสอบความทนทาน (Resiliency): ลองลบ Pod สักหนึ่งตัวดูครับ

kubectl delete pod <ชื่อ-pod-nginx-ตัวใดตัวหนึ่ง>

จากนั้นรัน kubectl get pods -l app=nginx อีกครั้ง คุณจะเห็นว่า Kubernetes ได้สร้าง Pod ใหม่ขึ้นมาแทนที่โดยอัตโนมัติ ทำให้จำนวน Pods กลับมาเป็น 3 ตัวตามที่กำหนดไว้ใน Deployment ครับ นี่คือพลังของ Kubernetes!

การปรับขนาด (Scaling): คุณสามารถเพิ่มหรือลดจำนวน Pods ได้อย่างง่ายดาย

kubectl scale deployment nginx-deployment --replicas=5 # เพิ่มเป็น 5 Pods

หรือแก้ไขไฟล์ nginx-deployment.yaml เปลี่ยน replicas: 3 เป็น replicas: 5 แล้วใช้ kubectl apply -f nginx-deployment.yaml

ลบ Deployment:

kubectl delete -f nginx-deployment.yaml

การเปิดเผย Service ให้เข้าถึงได้

แม้ว่า Pods จะรันอยู่แล้ว แต่คุณยังไม่สามารถเข้าถึง Nginx Web Server จากภายนอก Cluster ได้โดยตรงครับ เพราะ Pods มี IP Address ที่เปลี่ยนแปลงได้เมื่อถูกสร้างใหม่ Service คือวิธีแก้ปัญหานี้ โดยจะให้ IP Address และ DNS Name ที่คงที่แก่กลุ่มของ Pods

มี Service Type หลักๆ ที่ควรรู้จัก:

- ClusterIP (Default): เปิดเผย Service ภายใน Cluster เท่านั้น ไม่สามารถเข้าถึงจากภายนอกได้

- NodePort: เปิดเผย Service ผ่านพอร์ตคงที่บนทุก Node ใน Cluster ทำให้สามารถเข้าถึงได้จากภายนอกผ่าน IP ของ Node และพอร์ตที่กำหนด

- LoadBalancer: ใช้ได้เฉพาะบน Cloud Providers จะสร้าง External Load Balancer เพื่อกระจาย Traffic ไปยัง Pods โดยอัตโนมัติ

- ExternalName: ใช้สำหรับแมป Service ไปยัง External DNS Name

ลองมาสร้าง Service แบบ NodePort สำหรับ Nginx Deployment กันครับ

สร้างไฟล์ชื่อ nginx-service.yaml:

apiVersion: v1

kind: Service

metadata:

name: nginx-service

spec:

selector:

app: nginx # เลือก Pods ที่มี Label app: nginx

type: NodePort

ports:

- protocol: TCP

port: 80 # พอร์ตที่ Service เปิดรับภายใน Cluster

targetPort: 80 # พอร์ตที่คอนเทนเนอร์ (Nginx) เปิดรับ

nodePort: 30080 # พอร์ตที่จะเปิดบน Node (ค่าระหว่าง 30000-32767)

คำอธิบายไฟล์ YAML เพิ่มเติม:

kind: Service: ชนิดของ Objectselector: app: nginx: Service นี้จะส่ง Traffic ไปยัง Pods ที่มี Labelapp: nginxtype: NodePort: กำหนดชนิดของ Serviceports:port: 80: Service นี้จะเปิดรับ Traffic ที่พอร์ต 80 ภายใน ClustertargetPort: 80: Traffic ที่เข้ามาที่ Service จะถูกส่งต่อไปยังพอร์ต 80 ของคอนเทนเนอร์nodePort: 30080: พอร์ต 30080 บนทุก Node จะถูกเปิดออก และส่ง Traffic ไปยัง Service นี้ (คุณสามารถเว้นnodePortได้ Kubernetes จะกำหนดให้เอง)

ปรับใช้ Service:

kubectl apply -f nginx-service.yaml

ตรวจสอบสถานะ Service:

kubectl get services

คุณจะเห็น Service ที่มี TYPE เป็น NodePort และแสดงพอร์ตที่เปิดอยู่

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 1h

nginx-service NodePort 10.101.10.101 <none> 80:30080/TCP 30s

เข้าถึง Nginx Web Server:

ถ้าใช้ Minikube ให้ใช้คำสั่ง minikube ip เพื่อดู IP Address ของ Minikube Node จากนั้นเข้าถึงด้วย:

minikube ip # จะได้ IP เช่น 192.168.49.2

# จากนั้นเปิดในเว็บเบราว์เซอร์: http://192.168.49.2:30080

คุณควรจะเห็นหน้า Welcome to Nginx! ครับ

ลบ Service:

kubectl delete -f nginx-service.yaml

อย่าลืมลบ Deployment ด้วยนะครับถ้าไม่ใช้แล้ว

การจัดการ Configuration และ Secret

แอปพลิเคชันส่วนใหญ่ต้องการการตั้งค่าต่างๆ เช่น URL ของฐานข้อมูล, ค่าพอร์ต, API Keys เป็นต้น Kubernetes มี Object ที่เรียกว่า ConfigMap และ Secret สำหรับจัดการข้อมูลเหล่านี้

ConfigMap (สำหรับข้อมูลที่ไม่เป็นความลับ)

สร้างไฟล์ my-configmap.yaml:

apiVersion: v1

kind: ConfigMap

metadata:

name: app-config

data:

APP_COLOR: blue

APP_ENV: development

config.txt: |

# นี่คือไฟล์การตั้งค่าตัวอย่าง

server.port=8080

database.url=jdbc:mysql://localhost:3306/mydb

ปรับใช้ ConfigMap:

kubectl apply -f my-configmap.yaml

นำ ConfigMap ไปใช้งานใน Pod/Deployment:

แก้ไข nginx-deployment.yaml หรือสร้างใหม่ (ตัวอย่างนี้จะใช้ BusyBox เพื่อแสดงค่า Environment Variable)

apiVersion: apps/v1

kind: Deployment

metadata:

name: configmap-example-deployment

spec:

replicas: 1

selector:

matchLabels:

app: configmap-app

template:

metadata:

labels:

app: configmap-app

spec:

containers:

- name: busybox-container

image: busybox

command: ["sh", "-c", "echo The app color is $(APP_COLOR) and environment is $(APP_ENV) && sleep 3600"]

envFrom:

- configMapRef:

name: app-config

volumeMounts:

- name: config-volume

mountPath: "/etc/config"

readOnly: true

volumes:

- name: config-volume

configMap:

name: app-config

items:

- key: config.txt

path: config.txt

ในตัวอย่างนี้ เรานำ ConfigMap มาใช้ 2 วิธี:

- เป็น Environment Variables ผ่าน

envFrom - เป็นไฟล์ภายในคอนเทนเนอร์ผ่าน

volumeMountsและvolumes

kubectl apply -f configmap-example-deployment.yaml

kubectl logs deployment/configmap-example-deployment

คุณควรจะเห็นข้อความ “The app color is blue and environment is development” ใน Logs ครับ และไฟล์ /etc/config/config.txt ก็จะถูกสร้างขึ้นภายในคอนเทนเนอร์

Secret (สำหรับข้อมูลที่เป็นความลับ)

Secret คล้ายกับ ConfigMap แต่ถูกออกแบบมาเพื่อจัดเก็บข้อมูลที่ละเอียดอ่อน ข้อมูลใน Secret จะถูกเข้ารหัส (Base64 encoded) แต่ไม่ได้หมายความว่าถูกเข้ารหัสอย่างปลอดภัย (Encrypted) บนดิสก์ มันแค่ทำให้การอ่านด้วยตามนุษย์ยากขึ้นเท่านั้นครับ Kubernetes มีกลไกเพิ่มเติมในการจัดการ Secret ให้ปลอดภัยยิ่งขึ้น

สร้างไฟล์ my-secret.yaml (ข้อมูลต้องเป็น Base64 encoded)

สมมติว่า username: admin และ password: siamlancard123

echo -n 'admin' | base64

# ผลลัพธ์: YWRtaW4=

echo -n 'siamlancard123' | base64

# ผลลัพธ์: c2lhbWxhbmNhcmQxMjM=

ไฟล์ my-secret.yaml:

apiVersion: v1

kind: Secret

metadata:

name: my-db-secret

type: Opaque # ชนิดของ Secret (Opaque คือ Generic)

data:

username: YWRtaW4= # Base64 encoded 'admin'

password: c2lhbWxhbmNhcmQxMjM= # Base64 encoded 'siamlancard123'

ปรับใช้ Secret:

kubectl apply -f my-secret.yaml

นำ Secret ไปใช้งานใน Pod/Deployment:

apiVersion: apps/v1

kind: Deployment

metadata:

name: secret-example-deployment

spec:

replicas: 1

selector:

matchLabels:

app: secret-app

template:

metadata:

labels:

app: secret-app

spec:

containers:

- name: busybox-secret-container

image: busybox

command: ["sh", "-c", "echo DB_USERNAME is $DB_USERNAME and DB_PASSWORD is $DB_PASSWORD && sleep 3600"]

env:

- name: DB_USERNAME

valueFrom:

secretKeyRef:

name: my-db-secret

key: username

- name: DB_PASSWORD

valueFrom:

secretKeyRef:

name: my-db-secret

key: password

kubectl apply -f secret-example-deployment.yaml

kubectl logs deployment/secret-example-deployment

คุณจะเห็นข้อความ “DB_USERNAME is admin and DB_PASSWORD is siamlancard123” ใน Logs ครับ

ข้อควรจำ: ถึงแม้ Secret จะเก็บข้อมูลแบบ Base64 แต่ก็ควรใช้วิธีอื่นเพื่อเพิ่มความปลอดภัย เช่น การใช้ Kubernetes Secrets Store CSI Driver หรือ Vault เพื่อจัดการ Secret ที่แท้จริงครับ

การเก็บข้อมูลถาวรด้วย Persistent Volumes

โดยปกติแล้ว ข้อมูลที่อยู่ในคอนเทนเนอร์จะไม่คงอยู่ถาวร (Ephemeral) หาก Pod ถูกลบ ข้อมูลก็จะหายไปด้วย สำหรับแอปพลิเคชันที่ต้องการเก็บข้อมูลถาวร เช่น ฐานข้อมูล เราจำเป็นต้องใช้ Persistent Volumes (PV) และ PersistentVolumeClaims (PVC) ครับ

- PersistentVolume (PV): เป็นพื้นที่จัดเก็บข้อมูลจริงที่ถูกจัดเตรียมไว้ใน Cluster อาจจะเป็น NFS, iSCSI, หรือ Storage ของ Cloud Provider (เช่น EBS ใน AWS, Azure Disk, Google Persistent Disk)

- PersistentVolumeClaim (PVC): เป็นคำขอของผู้ใช้ (Pod) สำหรับพื้นที่จัดเก็บข้อมูลจาก PV ที่มีอยู่ เปรียบเสมือนการขอจองพื้นที่เก็บของ

ตัวอย่างการใช้งาน PV และ PVC (บน Minikube จะใช้ HostPath สำหรับการทดสอบ):

1. สร้าง PV – my-pv.yaml:

apiVersion: v1

kind: PersistentVolume

metadata:

name: my-local-pv

spec:

capacity:

storage: 1Gi # ขนาด 1 GB

volumeMode: Filesystem

accessModes:

- ReadWriteOnce # สามารถ Mount ได้โดย Node เดียวเท่านั้นในโหมดอ่านเขียน

persistentVolumeReclaimPolicy: Retain # เก็บข้อมูลไว้แม้ Pod ถูกลบ

hostPath: # สำหรับ Minikube เราจะใช้ HostPath ชี้ไปยังโฟลเดอร์บนเครื่อง Minikube VM

path: "/mnt/data"

2. สร้าง PVC – my-pvc.yaml:

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: my-pvc

spec:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 500Mi # ขอพื้นที่ 500 MB

3. สร้าง Deployment ที่ใช้ PVC – nginx-with-pvc-deployment.yaml:

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-with-pvc

labels:

app: nginx-storage

spec:

replicas: 1

selector:

matchLabels:

app: nginx-storage

template:

metadata:

labels:

app: nginx-storage

spec:

containers:

- name: nginx-container

image: nginx:latest

ports:

- containerPort: 80

volumeMounts:

- name: storage-volume

mountPath: "/usr/share/nginx/html" # Nginx ใช้ path นี้สำหรับ serving content

volumes:

- name: storage-volume

persistentVolumeClaim:

claimName: my-pvc # อ้างอิงถึง PVC ที่เราสร้าง

ปรับใช้ PV, PVC และ Deployment:

kubectl apply -f my-pv.yaml

kubectl apply -f my-pvc.yaml

kubectl apply -f nginx-with-pvc-deployment.yaml

ตรวจสอบสถานะ:

kubectl get pv

kubectl get pvc

kubectl get pods -l app=nginx-storage

หากทุกอย่างถูกต้อง PV จะมีสถานะ Bound กับ PVC และ Pod ก็จะรันได้

ทดสอบการเขียนข้อมูล:

เราสามารถเข้าสู่คอนเทนเนอร์เพื่อสร้างไฟล์ทดสอบได้:

POD_NAME=$(kubectl get pods -l app=nginx-storage -o jsonpath='{.items[0].metadata.name}')

kubectl exec -it $POD_NAME -- sh -c 'echo "Hello from Kubernetes!" > /usr/share/nginx/html/index.html'

สร้าง Service แบบ NodePort เพื่อเข้าถึง Nginx (เหมือนตัวอย่างก่อนหน้า แต่เปลี่ยน selector ให้ตรงกับ app: nginx-storage) และลองเข้าถึงผ่านเว็บเบราว์เซอร์ คุณควรจะเห็นข้อความ “Hello from Kubernetes!”

ลองลบ Pod แล้วรอให้ Deployment สร้างใหม่ แล้วเข้าถึงอีกครั้ง ข้อมูลควรจะยังอยู่ครับ

ลบทรัพยากร:

kubectl delete -f nginx-with-pvc-deployment.yaml

kubectl delete -f my-pvc.yaml

kubectl delete -f my-pv.yaml

การจัดการ Persistent Storage เป็นสิ่งสำคัญสำหรับแอปพลิเคชันที่มีสถานะ (Stateful Applications) และเป็นหนึ่งในส่วนที่ซับซ้อนที่สุดของ Kubernetes ครับ

ก้าวต่อไปสำหรับ DevOps มือใหม่: แนวคิดขั้นสูงและ Best Practices

เมื่อคุณคุ้นเคยกับพื้นฐานแล้ว มาสำรวจแนวคิดขั้นสูงและแนวทางปฏิบัติที่ดีที่สุดที่จะช่วยให้คุณเป็น DevOps ที่เชี่ยวชาญ Kubernetes มากขึ้นในปี 2026 กันครับ

In-depth Look at Ingress

Service แบบ NodePort หรือ LoadBalancer นั้นมีข้อจำกัดอยู่บ้างครับ เช่น NodePort ใช้พอร์ตที่ค่อนข้างสูงและอาจไม่เหมาะกับการจัดการ Traffic ที่ซับซ้อน ส่วน LoadBalancer ก็มีค่าใช้จ่ายเมื่อใช้งานบน Cloud Provider และอาจไม่สามารถจัดการการ Routing แบบ Path-based หรือ Host-based ได้อย่างยืดหยุ่น

Ingress เข้ามาแก้ปัญหานี้ครับ Ingress เป็น API Object ที่ทำหน้าที่จัดการการเข้าถึง HTTP/S ภายนอกเข้าสู่ Service ภายใน Cluster โดยให้ความสามารถในการ:

- URL-based Routing: กำหนดเส้นทางตาม URL Path เช่น

myapp.com/apiไปยัง Service A,myapp.com/dashboardไปยัง Service B - Host-based Routing: กำหนดเส้นทางตาม Hostname เช่น

api.myapp.comไปยัง Service A,www.myapp.comไปยัง Service B - SSL/TLS Termination: จัดการใบรับรอง SSL และการเข้ารหัส/ถอดรหัส Traffic

- Load Balancing: ทำหน้าที่เป็น Load Balancer ระดับ Layer 7

ในการใช้งาน Ingress คุณจะต้องติดตั้ง Ingress Controller ก่อนครับ Ingress Controller เป็นคอนเทนเนอร์ที่รันอยู่ภายใน Cluster และทำหน้าที่อ่านกฎจาก Ingress Object เพื่อกำหนดค่า Load Balancer หรือ Reverse Proxy (เช่น Nginx Ingress Controller, Traefik, HAProxy)

ตัวอย่าง Ingress (หลังจากติดตั้ง Nginx Ingress Controller):

สมมติว่าคุณมี nginx-deployment และ nginx-service ที่สร้างไว้ก่อนหน้านี้

สร้างไฟล์ nginx-ingress.yaml:

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: nginx-test-ingress

annotations:

nginx.ingress.kubernetes.io/rewrite-target: / # ตัวอย่าง annotation สำหรับ Nginx Ingress Controller

spec:

rules:

- host: myapp.com # Hostname ที่จะใช้เข้าถึง

http:

paths:

- path: / # ทุก path ที่เข้ามา

pathType: Prefix

backend:

service:

name: nginx-service # ส่ง Traffic ไปยัง nginx-service

port:

number: 80 # ที่พอร์ต 80

ปรับใช้ Ingress:

kubectl apply -f nginx-ingress.yaml

จากนั้นคุณจะต้องตั้งค่า DNS ของ myapp.com ให้ชี้ไปยัง IP Address ของ Ingress Controller ของคุณครับ (บน Minikube สามารถใช้ minikube tunnel หรือแก้ไขไฟล์ hosts ได้)

เรียนรู้เพิ่มเติม: Ingress เป็นหัวข้อที่สำคัญมากสำหรับ Production Workloads ครับ การเลือก Ingress Controller ที่เหมาะสมและการตั้งค่าที่ถูกต้องจะช่วยเพิ่มประสิทธิภาพและความปลอดภัยให้แอปพลิเคชันของคุณได้อย่างมาก อ่านเพิ่มเติมเกี่ยวกับ Ingress Controllers

Helm Charts: การจัดการแอปพลิเคชันที่ซับซ้อน

เมื่อแอปพลิเคชันของคุณมีหลายส่วนประกอบ (Deployment, Service, Ingress, ConfigMap, PVC ฯลฯ) การจัดการไฟล์ YAML หลายๆ ไฟล์ด้วยมืออาจเป็นเรื่องที่ยุ่งยากและผิดพลาดได้ง่าย Helm คือ Package Manager สำหรับ Kubernetes ที่เข้ามาช่วยแก้ปัญหานี้ครับ

Helm ใช้แนวคิดของ Charts ซึ่งเป็นแพ็คเกจที่ประกอบด้วยไฟล์ YAML ทั้งหมดที่จำเป็นในการปรับใช้แอปพลิเคชันที่สมบูรณ์ โดยสามารถกำหนดค่า (Values) ได้ ทำให้คุณสามารถปรับใช้แอปพลิเคชันเดียวกันในสภาพแวดล้อมที่แตกต่างกันได้ง่ายๆ ครับ

ประโยชน์ของ Helm:

- Package Management: ติดตั้ง ลบ อัปเกรด แอปพลิเคชันที่ซับซ้อนได้ง่าย

- Version Control: จัดการเวอร์ชันของ Chart ทำให้สามารถ Rollback การเปลี่ยนแปลงได้

- Templating: ใช้ Go Template ในการสร้างไฟล์ YAML จาก Values ทำให้การกำหนดค่ามีความยืดหยุ่น

- Reusable Charts: มี Charts สำเร็จรูปมากมายใน Helm Hub (Artifact Hub) สำหรับแอปพลิเคชันยอดนิยม เช่น Prometheus, Grafana, MongoDB

ตัวอย่างการใช้ Helm (การติดตั้ง Nginx Ingress Controller):

1. ติดตั้ง Helm CLI:

# สำหรับ macOS

brew install helm

# สำหรับ Linux

curl https://raw.githubusercontent.com/helm/helm/master/scripts/get-helm-3 | bash

2. เพิ่ม Helm Repository (สำหรับ Nginx Ingress Controller):

helm repo add ingress-nginx https://kubernetes.github.io/ingress-nginx

helm repo update

3. ติดตั้ง Nginx Ingress Controller ด้วย Helm:

helm install nginx-ingress ingress-nginx/ingress-nginx

เพียงคำสั่งเดียว Helm ก็จะปรับใช้ Deployment, Service, ConfigMap และทรัพยากรอื่นๆ ที่จำเป็นสำหรับ Nginx Ingress Controller ให้คุณโดยอัตโนมัติครับ

CI/CD กับ Kubernetes: การทำ GitOps

หัวใจของ DevOps คือการทำให้กระบวนการส่งมอบซอฟต์แวร์เป็นไปอย่างอัตโนมัติและต่อเนื่อง (CI/CD – Continuous Integration/Continuous Delivery) Kubernetes เป็นแพลตฟอร์มที่ยอดเยี่ยมสำหรับการสร้าง Pipeline CI/CD ที่ทันสมัย

แนวคิด GitOps: เป็นแนวทางปฏิบัติที่ได้รับความนิยมอย่างมากในโลกของ Kubernetes GitOps ใช้ Git เป็น “แหล่งความจริง” (Single Source of Truth) สำหรับสถานะที่ต้องการของระบบโครงสร้างพื้นฐานและแอปพลิเคชัน

- ทุกการเปลี่ยนแปลง (โค้ด, การตั้งค่า, Infrastructure) จะถูกคอมมิตไปยัง Git Repository

- มี Agent หรือ Operator ใน Cluster ที่คอยตรวจสอบ Git Repository และปรับสถานะของ Cluster ให้ตรงกับ Git เสมอ

เครื่องมือสำหรับ GitOps:

- ArgoCD: เป็น GitOps Continuous Delivery Tool ที่ได้รับความนิยม มี UI ที่สวยงามและฟังก์ชันการทำงานที่ทรงพลัง

- FluxCD: เป็นอีกหนึ่ง GitOps Tool ที่มีประสิทธิภาพและมีความยืดหยุ่นสูง

การบูรณาการกับ CI/CD Tools:

- Jenkins: สามารถใช้ Jenkins Pipeline เพื่อสร้าง Docker Image, Push ไปยัง Registry และปรับใช้บน Kubernetes ด้วย kubectl หรือ Helm

- GitLab CI/CD: มีการบูรณาการกับ Kubernetes ที่ยอดเยี่ยม สามารถปรับใช้แอปพลิเคชันไปยัง Cluster ได้โดยตรงจาก Pipeline

- GitHub Actions: เป็นทางเลือกยอดนิยมสำหรับการสร้าง CI/CD Pipeline ที่รันบน Cloud และสามารถสั่งงาน Kubernetes ได้ง่ายๆ

เริ่มต้น GitOps: การนำ GitOps มาใช้จะช่วยให้กระบวนการ Deploy ของคุณโปร่งใส ตรวจสอบย้อนหลังได้ และเชื่อถือได้มากขึ้น เริ่มต้นด้วยการศึกษา ArgoCD หรือ FluxCD และทดลองนำไปใช้ในโปรเจกต์เล็กๆ ครับ

Monitoring และ Logging

เมื่อแอปพลิเคชันของคุณรันอยู่บน Kubernetes การตรวจสอบสถานะและประสิทธิภาพ (Monitoring) รวมถึงการรวบรวมและวิเคราะห์ Log (Logging) เป็นสิ่งจำเป็นอย่างยิ่งเพื่อระบุปัญหา แก้ไขข้อผิดพลาด และเพิ่มประสิทธิภาพ

Monitoring Tools:

- Prometheus: เป็นระบบ Monitoring และ Alerting แบบ Open-source ที่ได้รับความนิยมอย่างสูงใน Kubernetes ใช้สำหรับรวบรวม Metrics จาก Pods, Nodes และ Kubernetes Components

- Grafana: เป็นเครื่องมือสำหรับสร้าง Dashboard ที่สวยงามและปรับแต่งได้ ใช้สำหรับแสดงข้อมูล Metrics ที่รวบรวมโดย Prometheus ทำให้เห็นภาพรวมของระบบได้ง่ายขึ้น

- Kubernetes Dashboard: เป็น Web UI ที่เป็นทางการสำหรับ Kubernetes Cluster ช่วยให้คุณสามารถตรวจสอบสถานะทรัพยากรต่างๆ ได้อย่างรวดเร็ว

Logging Tools:

- ELK Stack (Elasticsearch, Logstash, Kibana): เป็น Stack ยอดนิยมสำหรับการรวบรวม วิเคราะห์ และแสดง Log

- Elasticsearch: ฐานข้อมูลสำหรับจัดเก็บและค้นหา Log

- Logstash: เครื่องมือสำหรับรวบรวม ประมวลผล และส่ง Log ไปยัง Elasticsearch

- Kibana: Web UI สำหรับค้นหา วิเคราะห์ และสร้าง Dashboard จาก Log ใน Elasticsearch

- Fluentd / Fluent Bit: เป็น Log Collector ที่เบาและมีประสิทธิภาพสูง นิยมใช้ใน Kubernetes เพื่อรวบรวม Log จากคอนเทนเนอร์และส่งไปยังปลายทางต่างๆ เช่น Elasticsearch, CloudWatch Logs หรือ Splunk

สำหรับ DevOps มือใหม่: เริ่มต้นด้วยการติดตั้ง Prometheus และ Grafana บน Minikube หรือ Cluster ทดสอบของคุณครับ การได้เห็น Metrics และ Dashboard จะช่วยให้คุณเข้าใจการทำงานของ Kubernetes และแอปพลิเคชันได้ลึกซึ้งยิ่งขึ้น

Security Best Practices ใน Kubernetes

ความปลอดภัยเป็นสิ่งสำคัญสูงสุดสำหรับทุกระบบ โดยเฉพาะอย่างยิ่งในสภาพแวดล้อมที่ซับซ้อนอย่าง Kubernetes นี่คือ Best Practices ที่ DevOps มือใหม่ควรรู้ครับ

- Role-Based Access Control (RBAC): กำหนดสิทธิ์การเข้าถึงทรัพยากรใน Cluster ให้กับผู้ใช้และ Service Accounts อย่างละเอียดและจำกัดที่สุด (Principle of Least Privilege)

- Network Policies: กำหนดกฎการสื่อสารระหว่าง Pods และระหว่าง Pods กับทรัพยากรภายนอก เพื่อจำกัด Traffic ที่ไม่จำเป็น

- Image Security Scanning: สแกน Docker Images เพื่อหาช่องโหว่ด้านความปลอดภัยก่อนที่จะนำไปปรับใช้ใน Production

- Secrets Management: อย่าเก็บ Secret (รหัสผ่าน, API Keys) ในไฟล์ YAML โดยตรง ควรใช้ Kubernetes Secret Object และพิจารณาใช้ Secret Store CSI Driver หรือเครื่องมือภายนอก เช่น HashiCorp Vault สำหรับการจัดการ Secret ที่ปลอดภัยยิ่งขึ้น

- Pod Security Standards (PSS): กำหนดมาตรฐานความปลอดภัยสำหรับ Pods เพื่อป้องกันการรันคอนเทนเนอร์ด้วยสิทธิ์ Root, การเข้าถึง Host filesystem หรือการใช้ Capabilities ที่ไม่จำเป็น

- Patching and Upgrading: อัปเดต Kubernetes Cluster, Nodes และ Docker Images ให้เป็นเวอร์ชันล่าสุดอยู่เสมอเพื่อปิดช่องโหว่ด้านความปลอดภัย

- Resource Limits and Requests: กำหนด Resource Limits (CPU, Memory) สำหรับคอนเทนเนอร์ เพื่อป้องกัน Pods ใช้ทรัพยากรมากเกินไปจนส่งผลกระทบต่อ Pod อื่นๆ และทำให้ Node ไม่เสถียร

เปรียบเทียบ Kubernetes กับทางเลือกอื่นๆ และข้อพิจารณา

แม้ว่า Kubernetes จะเป็นผู้นำในตลาด Container Orchestration แต่ก็ไม่ใช่ทางเลือกเดียว และอาจไม่ใช่คำตอบสำหรับทุกกรณี เรามาดูการเปรียบเทียบกับทางเลือกอื่นๆ เพื่อให้คุณมีข้อมูลในการตัดสินใจมากขึ้นครับ

| คุณสมบัติ | Kubernetes | Docker Swarm | VM-based Orchestration (เช่น VMware vSphere, OpenStack) |

|---|---|---|---|

| แนวคิดหลัก | Orchestration ของคอนเทนเนอร์ที่ซับซ้อนและมีสถานะ (Stateful) | Container Orchestration ที่เรียบง่ายและเน้น Docker Ecosystem | การจัดการ Virtual Machines (VMs) และทรัพยากร Hardware |

| ความซับซ้อน | สูงมาก (มี Learning Curve ที่ชัน) | ต่ำถึงปานกลาง (เรียนรู้ง่ายกว่า Kubernetes) | ปานกลางถึงสูง (ขึ้นอยู่กับขนาดและการจัดการ) |

| ความสามารถในการขยายขนาด (Scalability) | ยอดเยี่ยม (ปรับขนาดอัตโนมัติ, รองรับ Workloads ขนาดใหญ่มาก) | ดี (ขยายขนาดได้ง่ายสำหรับคอนเทนเนอร์) | ปานกลาง (ขยายขนาด VM อาจใช้เวลาและทรัพยากรมากกว่า) |

| ความทนทานต่อข้อผิดพลาด (Resiliency) | ยอดเยี่ยม (Self-healing, Auto-recovery) | ดี (Self-healing สำหรับคอนเทนเนอร์) | ปานกลาง (ต้องพึ่งพา HA ของ VM และ Hypervisor) |

| การพกพา (Portability) | ยอดเยี่ยม (รันได้ทุกที่: Cloud, On-premise, Edge) | ดี (รันได้ทุกที่ที่มี Docker) | ปานกลาง (อาจมี Vendor Lock-in กับ Hypervisor) |

| ระบบนิเวศ (Ecosystem) | ใหญ่โตและเติบโตเร็วที่สุด (CNCF, เครื่องมือเสริมมากมาย) | เล็กกว่า Kubernetes, เน้น Docker-centric | มีเครื่องมือจัดการ VM และ Infrastructure as Code |

| การจัดการ Network | ซับซ้อนแต่ยืดหยุ่น (CNI plugins, Network Policies) | ง่ายกว่า, มี Overlay Network ในตัว | จัดการ Network ที่ระดับ VM |

| การจัดการ Storage | ซับซ้อนแต่ยืดหยุ่น (CSI drivers, PV/PVC) | จำกัดกว่า (Volume plugins) | จัดการ Storage ที่ระดับ VM/Hypervisor |

| Use Cases ที่เหมาะสม | Microservices, Production Workloads ขนาดใหญ่, ML/AI, Big Data, Multi-cloud | แอปพลิเคชันขนาดเล็กถึงกลาง, ทีมที่ต้องการความง่ายในการเริ่มต้น, Single-server deployments | Monolithic applications, Legacy systems, Workloads ที่ไม่เหมาะกับคอนเทนเนอร์ (เช่น ต้องการ Full OS), การจำลอง Hardware |

| ค่าใช้จ่าย | มีค่าใช้จ่ายในการเรียนรู้และดูแลรักษาที่สูงกว่า แต่ประหยัดทรัพยากรในระยะยาว | ค่าใช้จ่ายในการดูแลรักษาต่ำกว่า Kubernetes | ค่าใช้จ่าย Hardware และ License สูง, ประหยัดในระยะยาวถ้าจัดการดี |

ข้อพิจารณา: สำหรับ DevOps มือใหม่ การเลือกเทคโนโลยีที่เหมาะสมขึ้นอยู่กับความต้องการของโปรเจกต์และขนาดของทีม ถ้าคุณกำลังสร้าง Microservices ขนาดใหญ่ที่ต้องการความยืดหยุ่นและ Scalability สูง Kubernetes คือตัวเลือกที่ชัดเจน แต่ถ้าเป็นโปรเจกต์ขนาดเล็กหรือต้องการความรวดเร็วในการเริ่มต้น Docker Swarm ก็อาจเป็นทางเลือกที่ดีกว่าครับ การเข้าใจความแตกต่างเหล่านี้จะช่วยให้คุณสามารถแนะนำโซลูชันที่เหมาะสมกับความต้องการของธุรกิจได้ครับ

FAQ: คำถามที่พบบ่อยสำหรับ DevOps มือใหม่

ผมรวบรวมคำถามที่ DevOps มือใหม่มักจะสงสัยเกี่ยวกับ Kubernetes มาตอบให้ตรงนี้เลยครับ

-

Kubernetes คืออะไรกันแน่ครับ? เป็น OS หรือเปล่า?

ไม่ครับ Kubernetes ไม่ใช่ Operating System (OS) แต่เป็นแพลตฟอร์มสำหรับ Container Orchestration ครับ มันทำหน้าที่เป็น “ระบบปฏิบัติการ” สำหรับ Cluster ของเครื่องเซิร์ฟเวอร์ของคุณ โดยจัดการว่าคอนเทนเนอร์ของแอปพลิเคชันจะรันที่ไหน, ทำงานอย่างไร, ควรมีกี่ตัว, และจะจัดการกับความผิดพลาดอย่างไรครับ

-

ผมต้องเรียน Docker ก่อนไหมครับถึงจะเรียน Kubernetes ได้?

ใช่ครับ แนะนำอย่างยิ่ง ให้เรียนรู้และทำความเข้าใจ Docker (หรือเทคโนโลยีคอนเทนเนอร์อื่นๆ) ก่อนที่จะดำดิ่งสู่ Kubernetes ครับ เพราะ Kubernetes เป็นแพลตฟอร์มที่จัดการคอนเทนเนอร์ ถ้าคุณไม่เข้าใจว่าคอนเทนเนอร์คืออะไร ทำงานอย่างไร การเรียน Kubernetes ก็จะยากและสับสนมากครับ การมีพื้นฐาน Docker ที่แข็งแกร่งจะช่วยให้การเรียนรู้ Kubernetes เป็นไปอย่างราบรื่นขึ้นเยอะเลยครับ

-

Kubernetes เหมาะกับแอปพลิเคชันทุกประเภทเลยไหมครับ?

ไม่เสมอไปครับ Kubernetes เหมาะอย่างยิ่งสำหรับแอปพลิเคชันแบบ Microservices ที่ต้องการความสามารถในการปรับขนาด (Scalability), ความทนทานต่อข้อผิดพลาด (Resiliency) และการจัดการอัตโนมัติ อย่างไรก็ตาม สำหรับแอปพลิเคชันขนาดเล็กมาก, แอปพลิเคชัน Monolithic ที่ไม่ซับซ้อน, หรือ Workloads ที่ไม่ต้องการการขยายขนาดสูงมาก การใช้ Kubernetes อาจจะเพิ่มความซับซ้อนและค่าใช้จ่ายที่ไม่จำเป็นครับ บางครั้ง Docker Compose หรือ Docker Swarm ก็เป็นทางเลือกที่เพียงพอแล้วครับ

-

เรียน Kubernetes ยากไหมครับ? ต้องใช้เวลานานเท่าไหร่?

Kubernetes มี Learning Curve ที่ค่อนข้างชันครับ เพราะมีแนวคิดและคำศัพท์ใหม่ๆ มากมายที่ต้องเรียนรู้ แต่ด้วยความมุ่งมั่นและการฝึกฝนอย่างต่อเนื่อง คุณสามารถเข้าใจพื้นฐานและเริ่มใช้งานได้ภายในไม่กี่สัปดาห์ถึงไม่กี่เดือน การจะเป็นผู้เชี่ยวชาญอาจต้องใช้เวลาเป็นปีครับ สิ่งสำคัญคือการลงมือปฏิบัติจริง สร้างโปรเจกต์เล็กๆ และทดลองเล่นกับมันอยู่เสมอครับ

-

มีทรั