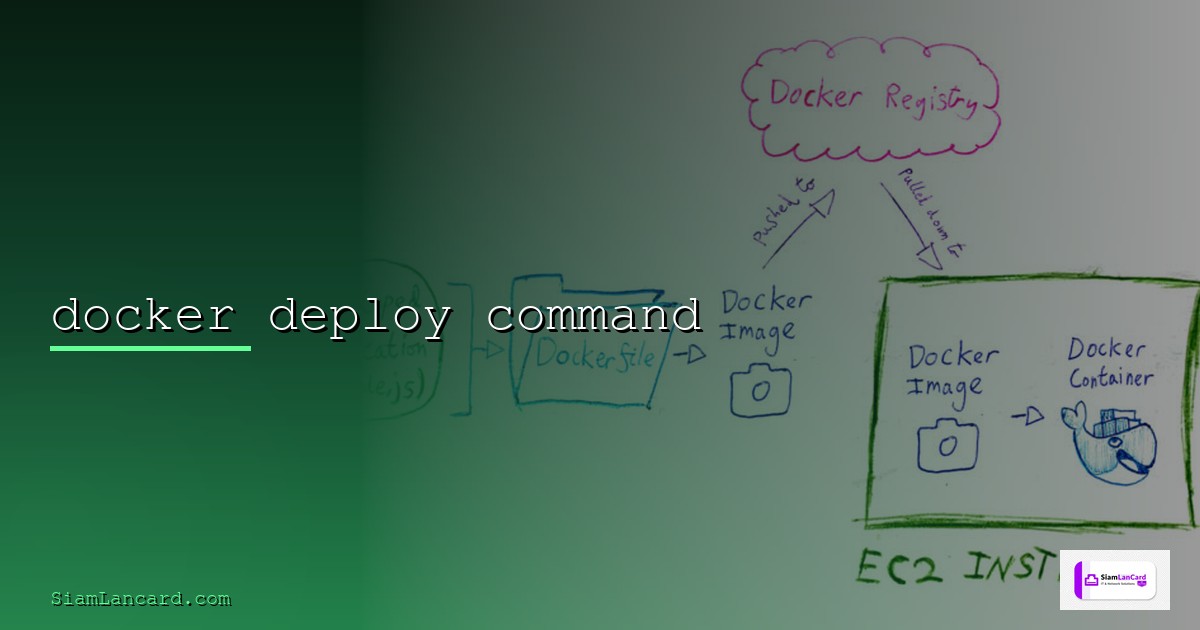

ในโลกของการพัฒนาและจัดการแอปพลิเคชันยุคใหม่ การทำให้ระบบทำงานได้อย่างมีประสิทธิภาพ เสถียร และปรับขนาดได้ คือหัวใจสำคัญของการสร้างความสำเร็จทางธุรกิจครับ และเมื่อพูดถึงการจัดการคอนเทนเนอร์ (Container) ในระดับ Production เครื่องมือที่ชื่อว่า Docker Compose ก็ยังคงเป็นตัวเลือกที่ทรงพลังและได้รับความไว้วางใจจากนักพัฒนาและวิศวกร DevOps ทั่วโลก แม้ในอีกไม่กี่ปีข้างหน้าอย่างปี 2026 นี้ก็ตาม หลายคนอาจคิดว่า Docker Compose เป็นเพียงเครื่องมือสำหรับ Development แต่ในความเป็นจริงแล้ว ด้วยการวางแผนและใช้งานอย่างถูกวิธี Docker Compose สามารถเป็นรากฐานที่แข็งแกร่งสำหรับแอปพลิเคชันระดับ Production ที่ต้องการความเรียบง่าย ประหยัด และควบคุมได้ วันนี้ SiamLancard.com จะพาคุณเจาะลึกทุกแง่มุมของการใช้งาน Docker Compose ใน Production สำหรับปี 2026 พร้อมแนวทางปฏิบัติที่ดีที่สุด และการเตรียมความพร้อมสำหรับอนาคตครับ

สารบัญ

- ทำไม Docker Compose ยังคงเป็นหัวใจสำคัญใน Production ปี 2026?

- พื้นฐาน Docker Compose ที่คุณต้องรู้ (และไม่ควรมองข้าม)

- การออกแบบ Docker Compose สำหรับ Production ที่แข็งแกร่ง

- Best Practices สำหรับ Docker Compose Production 2026

- เปรียบเทียบ Docker Compose vs. Kubernetes (และเมื่อไหร่ที่ Compose ยังชนะ)

- อนาคตของ Docker Compose ในปี 2026 และ Ecosystem ที่เกี่ยวข้อง

- คำถามที่พบบ่อย (FAQ)

- สรุปและก้าวต่อไป

ทำไม Docker Compose ยังคงเป็นหัวใจสำคัญใน Production ปี 2026?

แม้ว่าจะมีแพลตฟอร์ม Orchestration ที่ซับซ้อนและทรงพลังอย่าง Kubernetes เข้ามามีบทบาทอย่างมากในช่วงหลายปีที่ผ่านมา แต่ Docker Compose ก็ยังคงรักษาตำแหน่งสำคัญในฐานะเครื่องมือที่เข้าถึงได้ง่ายและมีประสิทธิภาพสูงสำหรับการจัดการแอปพลิเคชันแบบ Multicontainer โดยเฉพาะอย่างยิ่งสำหรับ Production ในปี 2026 ที่ความต้องการความคล่องตัว (Agility) และความรวดเร็วในการนำส่ง (Delivery Speed) ยังคงเป็นสิ่งสำคัญ Docker Compose นำเสนอข้อดีหลายประการที่ทำให้มันยังคงเป็นตัวเลือกที่น่าสนใจครับ

ความเรียบง่ายและง่ายต่อการเรียนรู้

Docker Compose ใช้ไฟล์ YAML ที่มีโครงสร้างชัดเจนและเข้าใจง่าย ทำให้การกำหนดค่า (Configuration) ของแอปพลิเคชันที่ประกอบด้วยหลาย ๆ เซอร์วิส (Service) เช่น Web server, Database, Cache และ Worker เป็นเรื่องที่ไม่ซับซ้อนจนเกินไป นักพัฒนาหรือทีม DevOps ที่เพิ่งเริ่มต้นกับการจัดการคอนเทนเนอร์สามารถเรียนรู้และนำไปใช้งานได้อย่างรวดเร็ว ลด Curve การเรียนรู้ที่สูงเมื่อเทียบกับแพลตฟอร์มที่ซับซ้อนกว่าครับ

ความสอดคล้องระหว่าง Development และ Production (Dev-Prod Parity)

หนึ่งในปัญหาคลาสสิกของการพัฒนาซอฟต์แวร์คือ “มันทำงานได้บนเครื่องของฉันนะ!” Docker Compose ช่วยแก้ปัญหานี้ได้อย่างมีประสิทธิภาพ โดยคุณสามารถใช้ไฟล์ docker-compose.yml เดียวกัน (หรือมีส่วนเสริมเล็กน้อย) ในการรันแอปพลิเคชันทั้งในสภาพแวดล้อมการพัฒนาและ Production สิ่งนี้ช่วยให้มั่นใจได้ว่าแอปพลิเคชันของคุณจะทำงานได้เหมือนกันในทุกสภาพแวดล้อม ลดความผิดพลาดที่เกิดจากความไม่สอดคล้องกันของ Environment ได้เป็นอย่างดีครับ

เหมาะสำหรับแอปพลิเคชันขนาดเล็กถึงกลาง

สำหรับแอปพลิเคชันที่มีขนาดไม่ใหญ่มาก หรือ Microservices ที่มีจำนวนไม่กี่สิบตัวที่ทำงานอยู่บนเซิร์ฟเวอร์เดียวหรือโฮสต์ไม่กี่ตัว Docker Compose ถือเป็นตัวเลือกที่คุ้มค่าและเพียงพอต่อการใช้งาน มันช่วยให้คุณสามารถจัดการการ Deploy, Scale และ Maintain แอปพลิเคชันเหล่านี้ได้อย่างมีประสิทธิภาพ โดยไม่จำเป็นต้องแบกรับความซับซ้อนและ Overhead ของ Orchestrator ขนาดใหญ่ครับ

ประหยัดทรัพยากรและค่าใช้จ่าย

การรัน Docker Compose ใน Production มักจะใช้ทรัพยากร (CPU, RAM) น้อยกว่าการรัน Orchestrator ขนาดใหญ่ เนื่องจากไม่มี Control Plane หรือ Agent จำนวนมากที่ต้องรันอยู่เบื้องหลัง ทำให้คุณสามารถใช้ฮาร์ดแวร์ได้อย่างเต็มประสิทธิภาพมากขึ้น และช่วยลดค่าใช้จ่ายในการดำเนินงาน (Operational Costs) ได้ครับ โดยเฉพาะอย่างยิ่งสำหรับ Startup หรือ SME ที่ต้องการ Optimize งบประมาณ แต่ยังคงต้องการความน่าเชื่อถือในระดับ Production

การสนับสนุนจากชุมชนและการพัฒนาอย่างต่อเนื่อง

Docker Compose ยังคงได้รับการสนับสนุนและพัฒนาอย่างต่อเนื่องจาก Docker และชุมชน Open Source ครับ มีการเพิ่มฟีเจอร์ใหม่ ๆ ปรับปรุงประสิทธิภาพ และแก้ไขข้อบกพร่องอยู่เสมอ ทำให้มั่นใจได้ว่าคุณจะยังคงได้รับเครื่องมือที่ทันสมัยและแข็งแกร่งสำหรับการจัดการคอนเทนเนอร์ในปี 2026 และหลังจากนั้นครับ

พื้นฐาน Docker Compose ที่คุณต้องรู้ (และไม่ควรมองข้าม)

ก่อนที่เราจะก้าวเข้าสู่การใช้งาน Docker Compose ใน Production อย่างเต็มรูปแบบ เรามาทบทวนพื้นฐานที่สำคัญกันก่อนครับ การทำความเข้าใจองค์ประกอบเหล่านี้อย่างถ่องแท้เป็นสิ่งจำเป็นสำหรับการสร้างไฟล์ Compose ที่มีประสิทธิภาพและปลอดภัย

ไฟล์ docker-compose.yml: หัวใจของการกำหนดค่า

ไฟล์ docker-compose.yml คือไฟล์ YAML ที่ใช้กำหนดค่าบริการ (Services), เครือข่าย (Networks), และ Volume สำหรับแอปพลิเคชันแบบ Multicontainer ของคุณ โครงสร้างพื้นฐานประกอบด้วย:

version: ระบุเวอร์ชันของ Compose file format (ปัจจุบันแนะนำ 3.x)services: ส่วนนี้จะกำหนดคอนเทนเนอร์แต่ละตัวที่ประกอบกันเป็นแอปพลิเคชันของคุณnetworks: กำหนดเครือข่ายที่บริการของคุณจะใช้ในการสื่อสารกันvolumes: กำหนด Volume สำหรับเก็บข้อมูลแบบ Persistentconfigsและsecrets: (สำหรับ Compose Specification 3.1+) ใช้จัดการ Configuration และ Secret ที่ละเอียดอ่อน

นี่คือตัวอย่างไฟล์ docker-compose.yml แบบง่าย ๆ ครับ:

version: '3.8'

services:

web:

image: nginx:latest

ports:

- "80:80"

volumes:

- ./nginx.conf:/etc/nginx/nginx.conf:ro

- ./html:/usr/share/nginx/html:ro

networks:

- app_network

depends_on:

- api

api:

build: .

ports:

- "5000:5000"

environment:

DATABASE_URL: postgres://user:password@db:5432/mydatabase

networks:

- app_network

depends_on:

- db

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:5000/health"]

interval: 30s

timeout: 10s

retries: 3

db:

image: postgres:13

environment:

POSTGRES_DB: mydatabase

POSTGRES_USER: user

POSTGRES_PASSWORD: password

volumes:

- db_data:/var/lib/postgresql/data

networks:

- app_network

networks:

app_network:

driver: bridge

volumes:

db_data:

Services: คอนเทนเนอร์แต่ละตัว

แต่ละ Service ในไฟล์ Compose จะถูกกำหนดให้เป็นคอนเทนเนอร์หนึ่งตัว โดยคุณสามารถระบุ:

image: Docker Image ที่จะใช้ (เช่นnginx:latest)build: Path ไปยัง Dockerfile หากคุณต้องการ Build Image เองports: การ Map พอร์ตจากโฮสต์ไปยังคอนเทนเนอร์volumes: การ Map Volume เพื่อเก็บข้อมูลหรือ Configurationenvironment: ตัวแปรสภาพแวดล้อมสำหรับคอนเทนเนอร์networks: เครือข่ายที่คอนเทนเนอร์จะเชื่อมต่อdepends_on: กำหนดการพึ่งพากันระหว่าง Services (แต่ไม่ได้รอให้ Service พร้อมใช้งานจริง)healthcheck: ตรวจสอบสถานะความพร้อมของ Service (สำคัญมากสำหรับ Production)restart: นโยบายการรีสตาร์ทคอนเทนเนอร์เมื่อเกิดข้อผิดพลาด

Networks: การเชื่อมต่อระหว่าง Services

Docker Compose สร้างเครือข่าย Bridge แบบ Private ให้โดยอัตโนมัติหากคุณไม่ได้ระบุ แต่สำหรับการใช้งาน Production การกำหนดเครือข่ายแบบ Custom จะช่วยให้คุณควบคุมการสื่อสารระหว่าง Services ได้ดีขึ้นครับ โดย Services ที่อยู่ในเครือข่ายเดียวกันสามารถสื่อสารกันได้ด้วยชื่อ Service นั้น ๆ (Service Discovery) โดยไม่ต้องใช้ IP Address

Volumes: การจัดการข้อมูลแบบ Persistent

ข้อมูลภายในคอนเทนเนอร์ส่วนใหญ่จะไม่คงอยู่ถาวรเมื่อคอนเทนเนอร์ถูกลบหรือสร้างใหม่ ดังนั้นการใช้ Volume เป็นสิ่งจำเป็นสำหรับการเก็บข้อมูลที่สำคัญ เช่น ฐานข้อมูล ไฟล์อัปโหลด หรือ Log ครับ

- Named Volumes: เป็นวิธีที่แนะนำสำหรับการเก็บข้อมูล Persistent ใน Docker Compose ข้อมูลจะถูกจัดเก็บในพื้นที่ที่ Docker จัดการให้

- Bind Mounts: Map ไฟล์หรือ Directory จากโฮสต์ไปยังคอนเทนเนอร์ เหมาะสำหรับไฟล์ Configuration หรือ Source code ในช่วง Development

Environment Variables และ Secrets

การจัดการตัวแปรสภาพแวดล้อมเป็นสิ่งสำคัญสำหรับการกำหนดค่าแอปพลิเคชันให้แตกต่างกันในแต่ละ Environment ครับ

environment: กำหนดตัวแปรสำหรับ Service.envfile: ไฟล์สำหรับเก็บตัวแปรสภาพแวดล้อมที่ใช้โดย Docker Compose เองsecrets: (ตั้งแต่ Compose Specification 3.1) เป็นวิธีที่ปลอดภัยกว่าในการส่งข้อมูลที่ละเอียดอ่อน เช่น รหัสผ่าน หรือ API Keys ไปยังคอนเทนเนอร์ โดยไม่ให้ปรากฏในไฟล์ Compose โดยตรงหรือ Environment Variables ที่ตรวจสอบได้ง่ายครับ

การออกแบบ Docker Compose สำหรับ Production ที่แข็งแกร่ง

การนำ Docker Compose ไปใช้ใน Production ไม่ใช่แค่การรันไฟล์ docker-compose.yml ที่ใช้ใน Dev แล้วจบไปครับ แต่ต้องมีการออกแบบและวางแผนอย่างรอบคอบ เพื่อให้ระบบมีความเสถียร ปลอดภัย และจัดการได้ในระยะยาว

การแยกไฟล์ Compose สำหรับ Production vs. Development

หนึ่งในแนวทางปฏิบัติที่ดีที่สุดคือการแยกไฟล์ Compose ออกเป็นส่วน ๆ สำหรับแต่ละสภาพแวดล้อม การทำเช่นนี้ช่วยให้คุณสามารถกำหนดค่าที่แตกต่างกันได้อย่างชัดเจน โดยไม่ทำให้ไฟล์หลักซับซ้อนเกินไป

docker-compose.yml(Base Configuration): ไฟล์หลักที่กำหนดค่าพื้นฐานของ Services, Networks, และ Volumes ที่เหมือนกันในทุกสภาพแวดล้อมdocker-compose.prod.yml(Production Overrides): ไฟล์สำหรับ Production ที่จะ อ่านเพิ่มเติม Overrides ค่าจากไฟล์หลัก เช่น การใช้ Image เวอร์ชัน Stable, การตั้งค่า Resource limits, การใช้ Named Volumes แทน Bind Mounts สำหรับข้อมูล Persistent, การตั้งค่า Logging Driverdocker-compose.dev.yml(Development Overrides): ไฟล์สำหรับ Development ที่อาจจะมีการ Map Port เพิ่มเติม, ใช้ Bind Mounts สำหรับ Source code เพื่อให้ Hot-reloading ทำงานได้, หรือใช้ Image ที่มี Debugging tools

ตัวอย่างการใช้งาน:

docker-compose.yml (Base):

version: '3.8'

services:

web:

image: your-app/web:latest

networks:

- app_network

api:

image: your-app/api:latest

networks:

- app_network

db:

image: postgres:13-alpine

networks:

- app_network

volumes:

- db_data:/var/lib/postgresql/data

networks:

app_network:

volumes:

db_data:

docker-compose.prod.yml (Production Overrides):

version: '3.8'

services:

web:

ports:

- "80:80"

deploy: # สำหรับ Docker Swarm หรือถ้าใช้ Compose ในโหมด Swarm

replicas: 3

resources:

limits:

cpus: '0.5'

memory: 512M

restart_policy:

condition: on-failure

logging:

driver: "json-file"

options:

max-size: "10m"

max-file: "5"

api:

ports:

- "5000:5000"

environment:

NODE_ENV: production

DATABASE_URL: ${PROD_DB_URL} # ดึงจาก .env หรือ Secrets

deploy:

replicas: 2

resources:

limits:

cpus: '1.0'

memory: 1G

restart_policy:

condition: on-failure

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:5000/health"]

interval: 30s

timeout: 10s

retries: 3

logging:

driver: "json-file"

options:

max-size: "10m"

max-file: "5"

db:

environment:

POSTGRES_PASSWORD: ${PROD_DB_PASSWORD}

volumes:

- db_data:/var/lib/postgresql/data

restart: always # ใช้ restart policy แบบง่ายสำหรับ Compose ทั่วไป

volumes:

db_data:

driver: local # ระบุ driver ชัดเจน

การรันใน Production: docker compose -f docker-compose.yml -f docker-compose.prod.yml up -d

การจัดการ Secrets อย่างปลอดภัย

ข้อมูลที่ละเอียดอ่อน เช่น รหัสผ่านฐานข้อมูล, API Keys, หรือ Private Keys ไม่ควรถูก hardcode ไว้ในไฟล์ Compose หรือ Dockerfile ครับ การจัดการ Secrets ที่เหมาะสมเป็นสิ่งสำคัญอย่างยิ่งสำหรับ Production

- Docker Secrets (เมื่อใช้ Docker Swarm): หากคุณกำลังใช้ Docker Compose ในโหมด Swarm (ซึ่งเป็นไปได้และเป็นวิธีที่แข็งแกร่งกว่าการรันบนโฮสต์เดี่ยว) Docker Secrets จะเป็นวิธีที่ปลอดภัยที่สุดในการจัดการข้อมูลละเอียดอ่อน โดย Secrets จะถูกเข้ารหัสและส่งไปยัง Service ที่ต้องการเท่านั้น

- Environment Variables ผ่านไฟล์

.env(อย่างระมัดระวัง): คุณสามารถใช้ไฟล์.envสำหรับตัวแปรสภาพแวดล้อมที่ไม่ละเอียดอ่อนมากนัก หรือใช้สำหรับ Production โดยที่ไฟล์.envนั้นถูกเก็บไว้อย่างปลอดภัยและไม่ Commit เข้า Git แต่ไฟล์นี้ยังคงเป็น Plaintext บน Server - External Secret Management Tools: สำหรับแอปพลิเคชันที่มีความต้องการด้านความปลอดภัยสูง หรือทำงานบนหลาย Servers การใช้เครื่องมืออย่าง HashiCorp Vault, AWS Secrets Manager, หรือ Azure Key Vault จะช่วยให้คุณจัดการ Secrets ได้อย่างรวมศูนย์และปลอดภัยยิ่งขึ้น คุณสามารถใช้ Script หรือเครื่องมือช่วย inject Secrets เหล่านี้เข้าไปใน Environment Variables ของคอนเทนเนอร์ก่อนที่มันจะรันครับ

ตัวอย่างการใช้ secrets ใน Compose (Requires Swarm mode หรือ Compose Specification 3.1+):

version: '3.8'

services:

api:

image: your-app/api:latest

secrets:

- db_password

- api_key

environment:

DATABASE_URL: postgres://user:${DB_PASSWORD_FILE}@db:5432/mydatabase # อ่านจากไฟล์ที่ Secret สร้างให้

secrets:

db_password:

file: ./db_password.txt # ไฟล์ที่มีรหัสผ่าน

api_key:

external: true # Secret ที่สร้างไว้นอก Compose

ในคอนเทนเนอร์ api จะมีไฟล์ /run/secrets/db_password และ /run/secrets/api_key ที่มีข้อมูล Secret อยู่ครับ

การจัดการ Volume และ Persistent Data

ข้อมูลที่แอปพลิเคชันสร้างขึ้นมา (เช่น ฐานข้อมูล, Log, ไฟล์อัปโหลด) ต้องถูกจัดเก็บไว้อย่างถาวร เพื่อไม่ให้สูญหายเมื่อคอนเทนเนอร์ถูกลบหรืออัปเดต

- Named Volumes: เป็นทางเลือกที่ดีที่สุดสำหรับ Production ครับ Docker จะจัดการ Volume เหล่านี้ให้ และมักจะมีการจัดการ Permission และประสิทธิภาพที่ดีกว่า Bind Mounts คุณควรใช้ Named Volumes สำหรับ Database Data, Cache และ Persistent Application Data

- Backup Strategy: สำหรับข้อมูลสำคัญใน Volume คุณต้องมีแผนการสำรองข้อมูล (Backup) ที่ชัดเจนและทดสอบได้ คุณอาจใช้ Cron Job บนโฮสต์เพื่อสำรอง Volume ไปยัง Storage ภายนอก หรือใช้เครื่องมือเฉพาะทางสำหรับฐานข้อมูลนั้น ๆ

- Performance: ตรวจสอบให้แน่ใจว่า Storage ที่รองรับ Volume ของคุณมีประสิทธิภาพเพียงพอสำหรับ Workload ของ Production ครับ โดยเฉพาะอย่างยิ่งสำหรับฐานข้อมูล

ตัวอย่าง:

version: '3.8'

services:

db:

image: postgres:13-alpine

volumes:

- db_data:/var/lib/postgresql/data # ใช้ Named Volume สำหรับข้อมูล DB

app_data:

image: your-app/app-service:latest

volumes:

- app_uploads:/app/uploads # ใช้ Named Volume สำหรับไฟล์อัปโหลด

volumes:

db_data:

app_uploads:

การกำหนด Network ที่เหมาะสม

การกำหนดค่าเครือข่ายที่เหมาะสมเป็นสิ่งสำคัญสำหรับการสื่อสารที่ปลอดภัยและมีประสิทธิภาพระหว่าง Services

- Custom Bridge Networks: สำหรับแอปพลิเคชันที่รันบนโฮสต์เดี่ยว การสร้าง Custom Bridge Network เองดีกว่าการใช้ Default Bridge Network เพราะมันช่วยแยกเครือข่ายของแอปพลิเคชันของคุณออกจากคอนเทนเนอร์อื่น ๆ บนโฮสต์ และให้ Service Discovery ที่ชัดเจน

- Overlay Networks (เมื่อใช้ Docker Swarm): หากคุณใช้ Docker Compose ในโหมด Swarm เพื่อรันคอนเทนเนอร์บนหลาย ๆ โฮสต์ Overlay Networks จะช่วยให้ Services สามารถสื่อสารกันได้ข้ามโฮสต์อย่างราบรื่นและปลอดภัย

- Network Aliases: คุณสามารถกำหนด Alias ให้กับ Services ใน Network เพื่อให้เข้าถึงได้ด้วยชื่อที่แตกต่างจากชื่อ Service หลักได้

- Security: พิจารณาการใช้ Network Policies หากแพลตฟอร์มรองรับ เพื่อจำกัดการเข้าถึงระหว่าง Services หรือจากภายนอกที่ไม่จำเป็น อ่านเพิ่มเติม เกี่ยวกับความปลอดภัยของ Docker

ตัวอย่าง Custom Network:

version: '3.8'

services:

web:

image: nginx

networks:

- frontend_network

api:

image: your-app/api

networks:

- frontend_network

- backend_network

db:

image: postgres

networks:

- backend_network

networks:

frontend_network:

driver: bridge

backend_network:

driver: bridge

Best Practices สำหรับ Docker Compose Production 2026

เพื่อให้ Docker Compose ของคุณพร้อมสำหรับ Production ในปี 2026 และใช้งานได้อย่างมีประสิทธิภาพสูงสุด นี่คือแนวทางปฏิบัติที่ดีที่สุดที่คุณควรนำไปใช้ครับ

การเลือก Image ที่เหมาะสมและปลอดภัย

- Official Images: เลือกใช้ Official Images จาก Docker Hub เสมอ เนื่องจากได้รับการดูแลและอัปเดตด้านความปลอดภัยอย่างสม่ำเสมอ

- Specific Tags: หลีกเลี่ยงการใช้

:latestใน Production ครับ เพราะมันอาจทำให้เกิดการเปลี่ยนแปลงที่ไม่คาดคิดเมื่อ Image ถูกอัปเดต ควรระบุ Tag ที่เจาะจง เช่นnginx:1.24-alpineหรือnode:18-slim - Slim/Alpine Images: เลือกใช้ Image เวอร์ชัน "slim" หรือ "alpine" เพื่อลดขนาดของ Image ซึ่งช่วยลดพื้นที่จัดเก็บ, ลดเวลาในการดาวน์โหลด, และลด Surface Area สำหรับการโจมตีด้านความปลอดภัย

- Vulnerability Scanning: ใช้เครื่องมือสแกนช่องโหว่ (Vulnerability Scanner) เช่น Trivy, Snyk, หรือ Docker Scan (cli plugin) เพื่อตรวจสอบ Image ที่คุณใช้ว่ามีช่องโหว่ด้านความปลอดภัยหรือไม่

การ Optimize Dockerfile และ Build Process

หากคุณ Build Image เอง การ Optimize Dockerfile เป็นสิ่งสำคัญอย่างยิ่ง

- Multi-stage Builds: ใช้ Multi-stage Builds เพื่อลดขนาดของ Production Image โดยแยกขั้นตอนการ Build (ที่อาจต้องใช้เครื่องมือมากมาย) ออกจากขั้นตอนการรันจริง

- Layer Caching: จัดเรียงคำสั่งใน Dockerfile ให้คำสั่งที่เปลี่ยนแปลงบ่อย ๆ อยู่ด้านล่าง เพื่อให้ Docker สามารถใช้ Layer Cache ได้อย่างมีประสิทธิภาพ ลดเวลาในการ Build

.dockerignore: ใช้ไฟล์.dockerignoreเพื่อไม่ให้ไฟล์ที่ไม่จำเป็น (เช่นnode_modulesใน Dev,.git) ถูก Copy เข้าไปใน Image ทำให้ Image มีขนาดเล็กลง- Least Privilege: รันแอปพลิเคชันด้วย User ที่ไม่ใช่

rootภายในคอนเทนเนอร์ เพื่อลดความเสี่ยงด้านความปลอดภัย

ตัวอย่าง Multi-stage Dockerfile:

# Stage 1: Build application

FROM node:18-alpine AS builder

WORKDIR /app

COPY package*.json ./

RUN npm install

COPY . .

RUN npm run build # หรือคำสั่ง build อื่นๆ ของคุณ

# Stage 2: Create a smaller production image

FROM node:18-alpine

WORKDIR /app

COPY --from=builder /app/node_modules ./node_modules

COPY --from=builder /app/dist ./dist # หรือโฟลเดอร์ build ที่คุณสร้างขึ้น

COPY package*.json ./

EXPOSE 3000

CMD ["node", "dist/index.js"] # หรือคำสั่ง start app ของคุณ

การทำ Health Check และ Restart Policies

สำหรับ Production ความเสถียรเป็นสิ่งสำคัญ Health Check และ Restart Policies ช่วยให้แอปพลิเคชันของคุณมีความยืดหยุ่นต่อความล้มเหลว

- Health Checks: กำหนด

healthcheckสำหรับทุก Services ที่สำคัญ เพื่อให้ Docker ทราบว่าคอนเทนเนอร์ของคุณยังทำงานได้อย่างถูกต้องหรือไม่ หาก Health Check ล้มเหลว Docker สามารถพิจารณา Restart คอนเทนเนอร์ได้ - Restart Policies: ใช้

restart: alwaysหรือrestart: on-failureสำหรับ Services ใน Production เพื่อให้ Docker พยายาม Restart คอนเทนเนอร์ที่หยุดทำงานโดยไม่คาดคิดโดยอัตโนมัติ

ตัวอย่าง:

services:

api:

image: your-app/api:latest

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:5000/health"]

interval: 30s

timeout: 10s

retries: 3

start_period: 20s # ให้เวลา Service เริ่มทำงานก่อนเริ่ม Health Check

restart: always

Logging และ Monitoring

การมีระบบ Log และ Monitoring ที่ดีเป็นสิ่งจำเป็นสำหรับการระบุปัญหาและรักษาสุขภาพของแอปพลิเคชัน

- Centralized Logging: แทนที่จะให้ Log อยู่ภายในคอนเทนเนอร์ (ซึ่งจะหายไปเมื่อคอนเทนเนอร์ถูกลบ) ให้ใช้ Logging Driver ที่ส่ง Log ไปยังระบบ Centralized Logging เช่น ELK Stack (Elasticsearch, Logstash, Kibana), Grafana Loki, Splunk, หรือ Cloud Logging Services (เช่น AWS CloudWatch Logs)

- Monitoring Tools: ใช้เครื่องมือ Monitoring เช่น Prometheus + Grafana เพื่อเก็บ Metrics จากคอนเทนเนอร์และโฮสต์ และสร้าง Dashboard สำหรับติดตามประสิทธิภาพและสถานะของระบบ

- Alerting: ตั้งค่าการแจ้งเตือน (Alerting) สำหรับเหตุการณ์สำคัญ เช่น Service ดาวน์, Resource Usage สูงเกินไป, หรือ Health Check ล้มเหลว

ตัวอย่างการตั้งค่า Logging Driver ใน Compose:

services:

api:

image: your-app/api:latest

logging:

driver: "syslog"

options:

syslog-address: "udp://192.168.1.100:514" # ส่ง Log ไปยัง Syslog Server

tag: "your-app-api"

การอัปเดตและ Rollback อย่างปลอดภัย

การอัปเดตแอปพลิเคชันใน Production ควรทำอย่างระมัดระวัง เพื่อลด Downtime และความเสี่ยง

- Zero-Downtime Deployment (ด้วย Swarm หรือ Load Balancer): หากคุณใช้ Docker Compose ในโหมด Swarm หรือมี Load Balancer อยู่ด้านหน้า คุณสามารถใช้กลยุทธ์ Rolling Update เพื่ออัปเดต Services ทีละน้อย โดยที่ระบบยังคงให้บริการอยู่

- Version Control for Compose Files: เก็บไฟล์

docker-compose.ymlของคุณไว้ใน Version Control System (เช่น Git) เพื่อให้สามารถติดตามการเปลี่ยนแปลงและ Rollback ไปยังเวอร์ชันก่อนหน้าได้ง่าย - Staging Environment: มี Staging Environment ที่ใกล้เคียงกับ Production มากที่สุด เพื่อทดสอบการอัปเดตก่อน Deploy จริง

- Blue/Green Deployment (Manual): สำหรับ Docker Compose บนโฮสต์เดี่ยว คุณอาจใช้ Blue/Green Deployment โดยการรันแอปพลิเคชันเวอร์ชันใหม่ (Green) ควบคู่ไปกับเวอร์ชันเก่า (Blue) แล้วสลับ Traffic ไปยัง Green เมื่อมั่นใจว่าทำงานได้ดี จากนั้นค่อยปิด Blue

เปรียบเทียบ Docker Compose vs. Kubernetes (และเมื่อไหร่ที่ Compose ยังชนะ)

เมื่อพูดถึงการ Orchestration ใน Production หลายคนมักจะนึกถึง Kubernetes เป็นอันดับแรก ซึ่งเป็นแพลตฟอร์มที่ทรงพลังอย่างมาก แต่ก็มาพร้อมกับความซับซ้อนที่สูง Docker Compose ยังคงมีจุดเด่นและสถานการณ์ที่มันเป็นตัวเลือกที่ดีกว่าครับ

| คุณสมบัติ | Docker Compose | Kubernetes |

|---|---|---|

| ความซับซ้อน | ต่ำ - ง่ายต่อการเรียนรู้และใช้งาน | สูง - ต้องใช้เวลาเรียนรู้และเข้าใจแนวคิดจำนวนมาก |

| การ Deploy | รวดเร็วสำหรับแอปพลิเคชันขนาดเล็ก/กลาง | ใช้เวลาในการตั้งค่าเริ่มต้นสูง แต่มีประสิทธิภาพสำหรับแอปพลิเคชันขนาดใหญ่ |

| การปรับขนาด (Scaling) | จำกัด - ทำได้บนโฮสต์เดียว หรือใช้ Docker Swarm แบบง่ายๆ | ทรงพลัง - ออกแบบมาเพื่อ Scale แอปพลิเคชันบน Cluster ขนาดใหญ่ |

| ความพร้อมใช้งาน (High Availability) | จำกัด - ต้องใช้ Docker Swarm เพื่อ HA | ยอดเยี่ยม - มี Built-in HA และ Self-healing mechanisms |

| การจัดการทรัพยากร | พื้นฐาน - กำหนด Resource Limits ได้ | ขั้นสูง - มี Resource Quotas, Autoscaling, Scheduling ที่ซับซ้อน |

| เหมาะสำหรับ |

|

|

| ค่าใช้จ่าย (OpEx) | ต่ำกว่า - ใช้ทรัพยากรน้อยกว่า, Overhead ต่ำ | สูงกว่า - ต้องการทรัพยากรสำหรับ Control Plane, ค่าใช้จ่ายในการดูแลรักษา |

เมื่อไหร่ที่ Docker Compose ยังคงเป็นตัวเลือกที่ดีกว่าในปี 2026?

- แอปพลิเคชันขนาดเล็กถึงกลาง: สำหรับแอปพลิเคชันที่มีไม่กี่ Services และไม่ต้องการการ Scale ที่ซับซ้อนมากนัก Docker Compose คือตัวเลือกที่คุ้มค่าที่สุดครับ

- โครงการเริ่มต้นและ Startup: หากคุณต้องการ Deploy แอปพลิเคชันอย่างรวดเร็วด้วยงบประมาณที่จำกัด Docker Compose ช่วยให้คุณเริ่มต้นได้ง่ายและประหยัดค่าใช้จ่ายในการดำเนินงาน

- Microservices ที่ทำงานบนโฮสต์เดี่ยว: แม้จะเป็น Microservices แต่หากมันถูกออกแบบมาให้ทำงานร่วมกันบน Server เดียว Docker Compose ก็สามารถจัดการได้ดี

- ทีมขนาดเล็ก: ทีมที่มีทรัพยากรจำกัด หรือไม่มีผู้เชี่ยวชาญด้าน Kubernetes โดยเฉพาะ Docker Compose ช่วยลดภาระในการเรียนรู้และดูแลรักษา

- สภาพแวดล้อมที่ต้องการความคล่องตัวในการพัฒนา: สำหรับการทดสอบและ Deployment อย่างรวดเร็วใน Staging Environment ที่เลียนแบบ Production ได้ดี Docker Compose เป็นเครื่องมือที่เหมาะสม

สรุปคือ ในปี 2026 Docker Compose ไม่ได้ถูกแทนที่โดย Kubernetes ทั้งหมดครับ แต่ทั้งสองเครื่องมือมีบทบาทที่แตกต่างกันและเติมเต็มซึ่งกันและกัน การเลือกใช้ขึ้นอยู่กับความต้องการเฉพาะของโครงการ ขนาดของแอปพลิเคชัน และทรัพยากรที่มีอยู่ครับ

อนาคตของ Docker Compose ในปี 2026 และ Ecosystem ที่เกี่ยวข้อง

Docker Compose ไม่ได้หยุดนิ่งอยู่กับที่ครับ แต่ยังคงมีการพัฒนาอย่างต่อเนื่องและมีการปรับตัวเข้ากับ Ecosystem ของ Containerization ที่เปลี่ยนแปลงไป ในปี 2026 เราสามารถคาดการณ์ถึงบทบาทและทิศทางของ Docker Compose ได้ดังนี้ครับ

Compose Specification: มาตรฐานที่เปิดกว้าง

Docker Compose ถูกโอนย้ายไปอยู่ภายใต้ Compose Specification ซึ่งเป็นมาตรฐานเปิดที่อนุญาตให้แพลตฟอร์มอื่น ๆ สามารถนำไปใช้งานได้ ไม่ใช่แค่ Docker Engine เท่านั้น สิ่งนี้ทำให้ Compose กลายเป็นภาษากลางสำหรับการกำหนดแอปพลิเคชันแบบ Multicontainer ซึ่งจะเปิดโอกาสให้มีเครื่องมือหรือแพลตฟอร์มใหม่ ๆ ที่รองรับ Compose Specification เพิ่มขึ้นในอนาคตครับ

Integration กับ Cloud Providers

ผู้ให้บริการ Cloud รายใหญ่ต่าง ๆ เริ่มมองเห็นคุณค่าของ Compose ในการกำหนดแอปพลิเคชันที่เรียบง่าย:

- AWS ECS Compose: AWS ได้พัฒนาเครื่องมือที่ช่วยให้คุณ Deploy แอปพลิเคชันที่กำหนดด้วย Docker Compose ไปยัง AWS ECS (Elastic Container Service) ได้โดยตรง สิ่งนี้ทำให้การย้ายจาก Local Compose ไปยัง Cloud เป็นเรื่องง่ายขึ้น

- Azure Container Apps: Azure มีบริการที่รองรับการ Deploy แอปพลิเคชันจากไฟล์ Docker Compose ไปยัง Azure Container Apps ซึ่งเป็นบริการ Serverless Containers ที่ออกแบบมาเพื่อ Microservices และ Event-driven Architectures

การรวมเข้ากับ Cloud Providers เหล่านี้จะทำให้ Docker Compose เป็นสะพานเชื่อมที่ดีเยี่ยมระหว่าง Development ใน Local และ Production บน Cloud โดยยังคงความเรียบง่ายของไฟล์ Compose ไว้ได้ครับ

บทบาทใน Edge Computing และ IoT

สำหรับ Edge Computing และ IoT ที่ทรัพยากรมีจำกัดและต้องการความเรียบง่ายในการจัดการแอปพลิเคชัน Docker Compose จะยังคงเป็นตัวเลือกที่แข็งแกร่ง มันสามารถรันแอปพลิเคชันแบบ Multicontainer ได้อย่างมีประสิทธิภาพบนอุปกรณ์ขนาดเล็กหรือ Gateway โดยไม่ต้องพึ่งพา Orchestrator ที่ซับซ้อนและใช้ทรัพยากรสูงครับ

เครื่องมือเสริมและ Ecosystem ที่เติบโต

จะมีเครื่องมือและโปรเจกต์ Open Source อีกมากมายที่สร้างขึ้นมาเพื่อเสริมการทำงานของ Docker Compose ใน Production เช่น:

- Monitoring & Logging Agents: Agent ที่สามารถ Deploy ด้วย Compose และส่ง Log/Metrics ไปยัง Centralized Systems ได้ง่ายขึ้น

- Backup Solutions: Tools ที่ช่วยสำรองข้อมูลจาก Docker Volumes ไปยัง Storage ภายนอกได้อย่างอัตโนมัติ

- CI/CD Pipelines: การรวม Docker Compose เข้ากับ CI/CD Pipelines เพื่อให้การ Deploy เป็นไปอย่างอัตโนมัติและสม่ำเสมอ

AI/ML และการปรับปรุงอัตโนมัติ (Speculative)

ในระยะยาว อาจมีการนำ AI/ML เข้ามาช่วยในการ Optimize การกำหนดค่า Docker Compose โดยอัตโนมัติ เช่น การแนะนำ Resource Limits ที่เหมาะสม, การปรับแต่ง Network Configuration, หรือการตรวจจับ Anomaly จาก Log เพื่อแนะนำการแก้ไขปัญหาครับ

โดยรวมแล้ว Docker Compose ไม่ได้เป็นแค่เครื่องมือสำหรับ Development เท่านั้น แต่ยังคงเป็นส่วนสำคัญใน Ecosystem ของ Containerization และจะยังคงเป็นตัวเลือกที่น่าเชื่อถือสำหรับการ Deploy แอปพลิเคชันใน Production โดยเฉพาะอย่างยิ่งสำหรับโครงการที่ต้องการความคล่องตัว ความเรียบง่าย และการควบคุมในระดับที่เหมาะสมครับ

คำถามที่พบบ่อย (FAQ)

1. Docker Compose เหมาะสำหรับ Production ที่มี Traffic สูงมาก ๆ หรือไม่ครับ?

โดยทั่วไปแล้ว Docker Compose (เมื่อรันบนโฮสต์เดี่ยว) ไม่ได้ถูกออกแบบมาสำหรับการรองรับ Traffic สูงมาก ๆ หรือการปรับขนาดในแนวนอน (Horizontal Scaling) ที่ซับซ้อนและอัตโนมัติเหมือน Kubernetes ครับ อย่างไรก็ตาม หากคุณใช้ Docker Compose ในโหมด Docker Swarm มันจะสามารถรองรับ Traffic ที่สูงขึ้นได้ในระดับหนึ่งด้วยการกระจายโหลดไปยังหลาย ๆ Node แต่ถ้าคุณคาดการณ์ว่าจะมี Traffic สูงมาก ๆ หรือต้องการระบบที่ปรับขนาดได้อัตโนมัติอย่างเต็มรูปแบบ Kubernetes จะเป็นตัวเลือกที่เหมาะสมกว่าครับ

2. จะมั่นใจได้อย่างไรว่าไฟล์ Docker Compose ของฉันปลอดภัยสำหรับ Production ครับ?

คุณต้องพิจารณาหลายปัจจัยครับ:

- การจัดการ Secrets: ห้าม Hardcode รหัสผ่านหรือ API Keys ใช้ Docker Secrets หรือ External Secret Manager

- Image Security: ใช้ Official Images, ระบุ Tag ที่แน่นอน, ใช้เวอร์ชัน Slim/Alpine, และสแกนช่องโหว่ (Vulnerability Scanning)

- Least Privilege: รันคอนเทนเนอร์ด้วย User ที่ไม่ใช่ root

- Network Isolation: ใช้ Custom Networks เพื่อแยก Service ออกจากกัน และเปิดพอร์ตเท่าที่จำเป็นเท่านั้น

- Dockerfile Best Practices: สร้าง Image ที่เล็กที่สุดเท่าที่จะเป็นไปได้ด้วย Multi-stage builds และใช้

.dockerignore - Regular Updates: อัปเดต Docker Engine และ Docker Compose ให้เป็นเวอร์ชันล่าสุดเสมอ เพื่อรับการแก้ไขช่องโหว่

3. ควรใช้ Docker Compose สำหรับ Microservices Architecture หรือไม่ครับ?

ใช่ครับ Docker Compose เป็นเครื่องมือที่ยอดเยี่ยมสำหรับการพัฒนาและ Deploy Microservices Architecture โดยเฉพาะอย่างยิ่งในช่วงแรกของโครงการ หรือสำหรับ Microservices ที่ทำงานร่วมกันบนโฮสต์เดี่ยว ช่วยให้คุณสามารถกำหนดและรัน Service แต่ละตัวได้อย่างอิสระ แต่ยังคงมีความสัมพันธ์กัน แต่หาก Microservices ของคุณมีจำนวนมาก มีความต้องการด้านการ Scale และ High Availability ที่ซับซ้อน หรือต้องทำงานกระจายกันบน Cluster ขนาดใหญ่ การพิจารณา Kubernetes อาจเป็นทางเลือกที่ดีกว่าในระยะยาวครับ

4. การทำ Backup ข้อมูลจาก Volume ที่ใช้ใน Docker Compose ทำได้อย่างไรครับ?

มีหลายวิธีครับ:

- Manual Backup: ใช้คำสั่ง

docker cpเพื่อคัดลอกข้อมูลจาก Volume ของคอนเทนเนอร์ หรือใช้คำสั่งdocker volume inspectเพื่อหา Path ของ Volume บนโฮสต์ แล้ว Copy ไฟล์โดยตรง - Dedicated Backup Container: สร้าง Service แยกใน Docker Compose ที่มีหน้าที่เพียงอย่างเดียวคือการ Backup ข้อมูลจาก Volume ไปยัง Storage ภายนอก (เช่น S3, NFS) โดยใช้ Cron Job ภายในคอนเทนเนอร์นั้น

- Host-level Backup: ใช้ Script หรือเครื่องมือ Backup ที่รันบนโฮสต์เพื่อเข้าถึง Directory ที่ Docker Volume เก็บข้อมูลอยู่ แล้วสำรองข้อมูลไปยังปลายทางที่ต้องการ

- Database-specific Tools: สำหรับฐานข้อมูล ควรใช้เครื่องมือ Backup ที่มาพร้อมกับฐานข้อมูลนั้น ๆ (เช่น

pg_dumpสำหรับ PostgreSQL) เพื่อให้มั่นใจว่าข้อมูลมีความสมบูรณ์

5. จะทำ Zero-downtime Deployment ด้วย Docker Compose ได้อย่างไรครับ?

การทำ Zero-downtime Deployment ด้วย Docker Compose บนโฮสต์เดี่ยวจะมีความท้าทายมากกว่าแพลตฟอร์ม Orchestration อย่าง Kubernetes ครับ แต่ก็ยังพอทำได้ด้วยเทคนิค Blue/Green Deployment แบบแมนนวล หรือใช้ Load Balancer/Reverse Proxy เข้ามาช่วย

- Blue/Green Deployment (Manual): รันแอปพลิเคชันเวอร์ชันใหม่ (Green) บนพอร์ตที่แตกต่างกัน เมื่อทดสอบแล้วว่าทำงานได้ดี ให้เปลี่ยนการชี้ไปที่พอร์ตใหม่ (เช่น โดยการอัปเดต Reverse Proxy configuration) แล้วค่อยหยุดเวอร์ชันเก่า (Blue)

- Docker Swarm: หากคุณใช้ Docker Compose ในโหมด Swarm คุณสามารถกำหนด

deployconfiguration เพื่อใช้ Rolling Updates ซึ่งจะช่วยให้คุณสามารถอัปเดต Service ทีละ Replica ได้โดยไม่มี Downtime ครับ

การวางแผนที่ดีและการทดสอบอย่างละเอียดเป็นสิ่งสำคัญสำหรับการทำ Zero-downtime Deployment ครับ

6. Compose CLI เวอร์ชันใหม่ (docker compose) กับเวอร์ชันเก่า (docker-compose) มีความแตกต่างกันอย่างไรครับ?

เวอร์ชันใหม่คือ docker compose (เป็นปลั๊กอินของ Docker CLI) และเวอร์ชันเก่าคือ docker-compose (เป็น Python script แยกต่างหาก) ครับ

- การติดตั้ง:

docker composeมักจะมาพร้อมกับการติดตั้ง Docker Desktop หรือติดตั้งเป็นปลั๊กอิน ส่วนdocker-composeต้องติดตั้งแยกต่างหาก - ฟีเจอร์:

docker composeรองรับ Compose Specification เวอร์ชันล่าสุดและมีฟีเจอร์ใหม่ ๆ ที่ดีกว่า รวมถึงการทำงานร่วมกับ Docker CLI ได้ราบรื่นกว่า - อนาคต:

docker composeคือทิศทางในอนาคตที่ Docker สนับสนุนและพัฒนาต่อครับ แนะนำให้ใช้เวอร์ชันใหม่นี้สำหรับโครงการใหม่ ๆ

คำสั่งส่วนใหญ่ยังคงคล้ายกันมาก เช่น docker compose up เทียบกับ docker-compose up ครับ

สรุปและก้าวต่อไป

Docker Compose ยังคงเป็นเครื่องมือที่ทรงคุณค่าและมีความสำคัญอย่างยิ่งสำหรับการจัดการแอปพลิเคชันแบบ Multicontainer ใน Production สำหรับปี 2026 ครับ ด้วยความเรียบง่าย ประสิทธิภาพ และความสามารถในการสร้างความสอดคล้องระหว่าง Dev และ Prod ทำให้มันเป็นตัวเลือกที่ยอดเยี่ยมสำหรับแอปพลิเคชันขนาดเล็กถึงกลาง หรือในสถานการณ์ที่ความซับซ้อนของ Orchestrator ขนาดใหญ่เกินความจำเป็น

การใช้งาน Docker Compose ใน Production ไม่ใช่แค่การรันคำสั่ง up -d เท่านั้น แต่ต้องอาศัยการวางแผนที่ดี การออกแบบที่แข็งแกร่ง และการนำ Best Practices มาใช้อย่างเคร่งครัด ตั้งแต่การแยกไฟล์ Configuration, การจัดการ Secrets และ Volumes อย่างปลอดภัย, การ Optimize Images, ไปจนถึงการตั้งค่า Health Checks, Logging, Monitoring และการเตรียมพร้อมสำหรับการอัปเดตและ Rollback

SiamLancard.com หวังว่าบทความนี้จะเป็นแนวทางที่ครอบคลุมและเป็นประโยชน์อย่างยิ่งสำหรับคุณในการนำ Docker Compose ไปใช้งานใน Production ได้อย่างมั่นใจและมีประสิทธิภาพสูงสุดครับ การลงทุนในความรู้และแนวทางปฏิบัติเหล่านี้จะช่วยให้คุณสร้างระบบที่แข็งแกร่ง ปลอดภัย และพร้อมรับมือกับความท้าทายในอนาคตได้อย่างแน่นอน

หากคุณมีคำถามเพิ่มเติม ต้องการคำปรึกษา หรือมองหาผู้เชี่ยวชาญด้าน Docker และ Containerization สำหรับโครงการของคุณ อย่าลังเลที่จะ ติดต่อเรา ที่ SiamLancard.com ครับ เราพร้อมที่จะเป็นส่วนหนึ่งในความสำเร็จของคุณเสมอ!