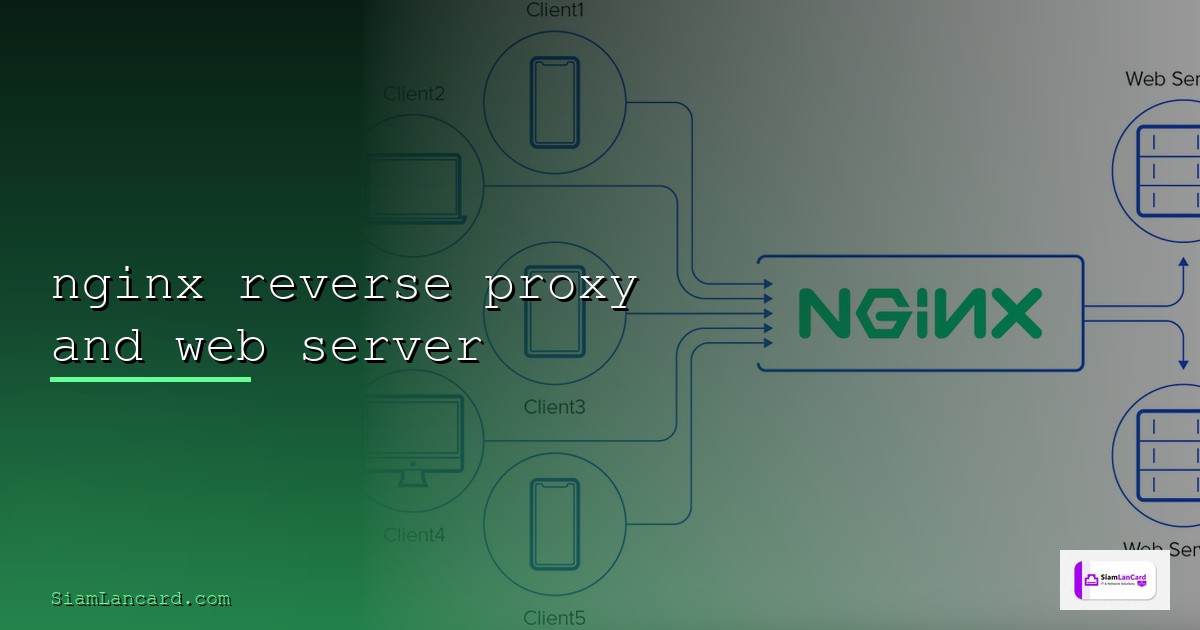

ในโลกของการพัฒนาและดูแลระบบเว็บแอปพลิเคชันที่เติบโตอย่างรวดเร็วในปัจจุบัน ความสามารถในการรองรับผู้ใช้งานจำนวนมาก การทำงานที่เสถียร และความต่อเนื่องของบริการ (High Availability) คือหัวใจสำคัญที่ไม่อาจมองข้ามได้ครับ เมื่อเว็บไซต์หรือแอปพลิเคชันของคุณเริ่มมีผู้เข้าชมเพิ่มขึ้นอย่างก้าวกระโดด การพึ่งพาเซิร์ฟเวอร์เพียงเครื่องเดียวอาจกลายเป็นคอขวดที่ทำให้ประสิทธิภาพการทำงานลดลง เกิดปัญหาการล่ม หรือแม้แต่ส่งผลเสียต่อประสบการณ์ของผู้ใช้งานโดยตรง เพื่อแก้ไขปัญหานี้ เทคโนโลยี Nginx Reverse Proxy Load Balancing จึงเข้ามามีบทบาทสำคัญอย่างยิ่งในการกระจายภาระงานไปยังเซิร์ฟเวอร์หลายเครื่องอย่างมีประสิทธิภาพ ทำให้ระบบของคุณมีความยืดหยุ่น รับมือกับปริมาณทราฟฟิกที่เข้ามาได้อย่างไร้รอยต่อ และยังช่วยเพิ่มความปลอดภัยให้กับโครงสร้างพื้นฐานอีกด้วยครับ

บทความนี้จะพาคุณเจาะลึกถึงหลักการทำงาน ประโยชน์ และที่สำคัญที่สุดคือคู่มือการตั้งค่า Nginx Reverse Proxy Load Balancing แบบละเอียดทุกขั้นตอน ตั้งแต่พื้นฐานไปจนถึงการปรับแต่งขั้นสูง พร้อมตัวอย่างโค้ดที่ใช้งานได้จริง เพื่อให้คุณสามารถนำไปประยุกต์ใช้กับระบบของคุณได้อย่างมั่นใจครับ ไม่ว่าคุณจะเป็น System Administrator, DevOps Engineer, หรือนักพัฒนาที่ต้องการยกระดับโครงสร้างพื้นฐานของเว็บแอปพลิเคชัน บทความนี้คือสิ่งที่คุณกำลังมองหาอย่างแน่นอนครับ

สารบัญ

- Nginx คืออะไร? ทำไมต้องใช้ Nginx?

- Reverse Proxy คืออะไร?

- Load Balancing คืออะไร? ทำไมถึงสำคัญ?

- ประเภทของ Load Balancing Algorithms

- การเตรียมความพร้อมสำหรับการตั้งค่า Nginx Reverse Proxy Load Balancing

- คู่มือตั้งค่า Nginx Reverse Proxy Load Balancing

- ขั้นตอนที่ 1: การกำหนดค่า Upstream Servers

- ขั้นตอนที่ 2: การกำหนดค่า Server Block สำหรับ Reverse Proxy

- ขั้นตอนที่ 3: การกำหนดค่า Load Balancing Algorithm

- ขั้นตอนที่ 4: การกำหนดค่า Health Checks และ Failover

- ขั้นตอนที่ 5: การกำหนดค่า Session Persistence (Sticky Sessions)

- ขั้นตอนที่ 6: การกำหนดค่า SSL Termination (HTTPS)

- ขั้นตอนที่ 7: การกำหนดค่า Caching

- ขั้นตอนที่ 8: การจัดการ HTTP Headers

- ขั้นตอนที่ 9: การทดสอบและการตรวจสอบ

- เทคนิคและแนวปฏิบัติที่ดี (Best Practices)

- ประโยชน์ของการใช้ Nginx Reverse Proxy Load Balancing

- คำถามที่พบบ่อย (FAQ)

- สรุป

- Call to Action

Nginx คืออะไร? ทำไมต้องใช้ Nginx?

Nginx (อ่านว่า Engine-X) คือซอฟต์แวร์โอเพนซอร์สที่มีประสิทธิภาพสูง ทำหน้าที่ได้หลากหลาย ไม่ว่าจะเป็น Web Server, Reverse Proxy, HTTP Cache และ Load Balancer ครับ Nginx ถูกออกแบบมาเพื่อจัดการกับปริมาณการเชื่อมต่อพร้อมกันจำนวนมาก (Concurrent Connections) ได้อย่างยอดเยี่ยม ด้วยสถาปัตยกรรมแบบ Event-driven, Asynchronous และ Non-blocking ซึ่งแตกต่างจาก Web Server แบบดั้งเดิมอย่าง Apache ที่มักใช้โมเดล Process-per-connection ทำให้ Nginx ใช้ทรัพยากรระบบน้อยกว่าและมีประสิทธิภาพสูงกว่าเมื่อต้องรองรับทราฟฟิกมหาศาลครับ

เหตุผลหลักที่นิยมใช้ Nginx มีดังนี้ครับ:

- ประสิทธิภาพสูง: สามารถจัดการกับผู้ใช้งานพร้อมกันหลายพันรายได้อย่างมีประสิทธิภาพ โดยใช้ทรัพยากร CPU และ Memory น้อยกว่า

- ความเสถียร: มีความแข็งแกร่งและเสถียรสูง เหมาะสำหรับระบบที่มีความสำคัญต่อธุรกิจ

- ความยืดหยุ่น: สามารถปรับแต่งการทำงานได้หลากหลาย ไม่ว่าจะเป็นการทำ Reverse Proxy, Load Balancing, SSL Termination, Caching หรือแม้แต่การ Serving Static Files

- รองรับ Scalability: เป็นส่วนประกอบสำคัญที่ช่วยให้ระบบสามารถขยายขนาด (Scale Out) ได้ง่ายขึ้น

- รองรับ HTTP/2: Nginx รองรับโปรโตคอล HTTP/2 ซึ่งช่วยเพิ่มประสิทธิภาพการโหลดเว็บไซต์ได้อย่างเห็นได้ชัด

ด้วยความสามารถเหล่านี้ Nginx จึงกลายเป็นตัวเลือกอันดับต้นๆ สำหรับเว็บไซต์และแอปพลิเคชันขนาดใหญ่ทั่วโลกครับ

Reverse Proxy คืออะไร?

Reverse Proxy คือเซิร์ฟเวอร์ที่อยู่ด้านหน้าของเซิร์ฟเวอร์แอปพลิเคชันจริง (Backend Servers) ทำหน้าที่เป็นตัวกลางในการรับคำขอ (Request) จากไคลเอนต์ (Web Browser) ก่อนที่จะส่งต่อไปยังเซิร์ฟเวอร์แอปพลิเคชันที่เหมาะสมครับ เมื่อเซิร์ฟเวอร์แอปพลิเคชันประมวลผลคำขอเสร็จแล้ว Reverse Proxy ก็จะรับผลลัพธ์กลับมาและส่งต่อให้ไคลเอนต์ต่อไป โดยที่ไคลเอนต์จะไม่รู้เลยว่ากำลังสื่อสารกับเซิร์ฟเวอร์แอปพลิเคชันตัวใดโดยตรงครับ

ลองจินตนาการว่าคุณสั่งอาหารจากร้านอาหารแห่งหนึ่ง คุณไม่ได้สั่งกับพ่อครัวโดยตรง แต่สั่งผ่านพนักงานรับออเดอร์ พนักงานรับออเดอร์ (Reverse Proxy) จะรับคำสั่งคุณไปให้พ่อครัว (Backend Server) ที่ว่างอยู่จัดการ เมื่ออาหารเสร็จ พนักงานก็เป็นคนนำมาเสิร์ฟให้คุณ คุณไม่จำเป็นต้องรู้ว่าพ่อครัวคนไหนเป็นคนทำอาหารของคุณครับ

ประโยชน์ของการใช้ Reverse Proxy:

- ความปลอดภัย: ช่วยซ่อน IP Address และรายละเอียดของ Backend Servers จากโลกภายนอก ทำให้ Hacker โจมตีเซิร์ฟเวอร์แอปพลิเคชันโดยตรงได้ยากขึ้น

- Load Balancing: เป็นหัวใจสำคัญที่ Reverse Proxy สามารถกระจายทราฟฟิกไปยัง Backend Servers หลายเครื่อง เพื่อป้องกันไม่ให้เซิร์ฟเวอร์ใดเซิร์ฟเวอร์หนึ่งทำงานหนักเกินไป

- SSL Termination: สามารถจัดการการเข้ารหัสและถอดรหัส SSL/TLS ได้ที่ตัว Reverse Proxy ทำให้ Backend Servers ไม่ต้องรับภาระนี้ และยังช่วยรวมศูนย์การจัดการใบรับรอง SSL

- Caching: สามารถแคชเนื้อหาที่ถูกเรียกใช้บ่อยๆ ได้ที่ตัว Reverse Proxy ทำให้ตอบสนองคำขอได้เร็วยิ่งขึ้นและลดภาระของ Backend Servers

- Compression: สามารถบีบอัดข้อมูลก่อนส่งกลับไปยังไคลเอนต์ ช่วยลดปริมาณแบนด์วิดท์

- A/B Testing และ URL Rewriting: สามารถใช้ Reverse Proxy ในการกำหนดเส้นทางทราฟฟิกไปยัง Backend Servers ที่แตกต่างกัน หรือปรับเปลี่ยน URL ได้

Load Balancing คืออะไร? ทำไมถึงสำคัญ?

Load Balancing คือกระบวนการกระจายปริมาณงาน (Workload) หรือทราฟฟิกเครือข่ายที่เข้ามาในระบบคอมพิวเตอร์ ไปยังเซิร์ฟเวอร์หลายเครื่องที่มีความสามารถเท่าเทียมกันครับ เพื่อให้เซิร์ฟเวอร์แต่ละเครื่องไม่ทำงานหนักเกินไป และเพื่อให้แน่ใจว่าทรัพยากรของระบบถูกใช้งานอย่างเหมาะสมที่สุด

ความสำคัญของ Load Balancing:

- High Availability (ความต่อเนื่องของบริการ): หากเซิร์ฟเวอร์เครื่องใดเครื่องหนึ่งเกิดขัดข้อง Load Balancer จะตรวจพบและหยุดส่งทราฟฟิกไปยังเซิร์ฟเวอร์นั้นโดยอัตโนมัติ และจะส่งไปยังเซิร์ฟเวอร์ที่ยังทำงานอยู่แทน ทำให้บริการไม่หยุดชะงัก

- Scalability (ความสามารถในการขยายขนาด): ช่วยให้สามารถเพิ่มเซิร์ฟเวอร์ใหม่ๆ เข้าไปในกลุ่ม Backend Servers ได้อย่างง่ายดายเมื่อปริมาณทราฟฟิกเพิ่มขึ้น โดยไม่จำเป็นต้องหยุดบริการ

- Improved Performance (ประสิทธิภาพที่ดีขึ้น): การกระจายโหลดช่วยลดภาระของแต่ละเซิร์ฟเวอร์ ทำให้การตอบสนองเร็วขึ้น และลด Latency โดยรวม

- Fault Tolerance (ความทนทานต่อความผิดพลาด): ทำให้ระบบมีความแข็งแกร่งและทนทานต่อความผิดพลาดของฮาร์ดแวร์หรือซอฟต์แวร์ได้ดีขึ้น

- Optimized Resource Utilization (การใช้ทรัพยากรอย่างเหมาะสม): ช่วยให้เซิร์ฟเวอร์ทุกเครื่องในกลุ่มถูกใช้งานอย่างเต็มประสิทธิภาพ

ในบทบาทของ Nginx การทำ Load Balancing จะทำงานควบคู่ไปกับ Reverse Proxy เพื่อส่งต่อคำขอที่เข้ามาจากผู้ใช้งานไปยัง Backend Servers ที่อยู่ด้านหลังครับ

ประเภทของ Load Balancing Algorithms

Nginx มี Load Balancing Algorithms หลายแบบให้เลือกใช้ เพื่อตอบโจทย์ความต้องการที่แตกต่างกันไปครับ มาดูกันว่าแต่ละแบบทำงานอย่างไร:

Round Robin

เป็น Algorithm พื้นฐานและเป็นค่าเริ่มต้นของ Nginx ครับ หลักการทำงานคือจะกระจายคำขอไปยัง Backend Servers ทีละเครื่องตามลำดับแบบวนซ้ำ (Cyclic) เช่น Server A, Server B, Server C, แล้วกลับไป Server A ใหม่ครับ

- ข้อดี: ใช้งานง่าย ตั้งค่าง่าย และกระจายโหลดได้ค่อนข้างสม่ำเสมอในสถานการณ์ที่ Backend Servers มีความสามารถเท่ากัน

- ข้อเสีย: ไม่ได้พิจารณาถึงสถานะการทำงานหรือโหลดปัจจุบันของแต่ละเซิร์ฟเวอร์ หากมีเซิร์ฟเวอร์ใดทำงานช้ากว่า อาจทำให้เกิดคอขวดได้

Least Conn (Least Connections)

Algorithm นี้จะส่งคำขอใหม่ไปยัง Backend Server ที่มีจำนวนการเชื่อมต่อ (Active Connections) น้อยที่สุดในขณะนั้นครับ เหมาะสำหรับสถานการณ์ที่คำขอมีระยะเวลาการประมวลผลที่ไม่เท่ากัน

- ข้อดี: มีประสิทธิภาพดีกว่า Round Robin เมื่อ Backend Servers มีความสามารถในการประมวลผลที่แตกต่างกัน หรือเมื่อคำขอแต่ละรายการใช้เวลาในการประมวลผลไม่เท่ากัน ช่วยให้เซิร์ฟเวอร์ที่มีโหลดน้อยได้รับงานใหม่ก่อน

- ข้อเสีย: อาจมีการ Overload ได้หากเซิร์ฟเวอร์ที่มีการเชื่อมต่อน้อยที่สุดนั้นกำลังประมวลผลงานที่ใช้ทรัพยากรสูงมากๆ

IP Hash

Algorithm นี้จะใช้ IP Address ของไคลเอนต์ในการคำนวณ Hash เพื่อตัดสินใจว่าจะส่งคำขอไปยัง Backend Server เครื่องใดครับ ข้อดีคือไคลเอนต์รายเดิมจะถูกส่งไปยัง Backend Server เครื่องเดิมเสมอ ซึ่งเป็นประโยชน์อย่างมากสำหรับการรักษา Session Persistence (Sticky Sessions)

- ข้อดี: รักษา Session Persistence ได้ดี ทำให้ผู้ใช้งานไม่หลุดจาก Session เดิมเมื่อมีการเชื่อมต่อใหม่ เหมาะสำหรับแอปพลิเคชันที่ต้องการสถานะ (Stateful Applications)

- ข้อเสีย: หากมี Backend Server เครื่องใดล่ม หรือถูกเพิ่ม/ลดออกจากกลุ่ม อาจทำให้ Session ที่เคยอยู่บนเซิร์ฟเวอร์นั้นหายไป และอาจทำให้การกระจายโหลดไม่สม่ำเสมอหากมี IP Address ของไคลเอนต์บางกลุ่มจำนวนมาก

Generic Hash (Consistent Hashing)

Nginx Plus (เวอร์ชันเสียเงิน) มี hash directive ที่อนุญาตให้ใช้ตัวแปรอื่น ๆ นอกเหนือจาก IP Address ของไคลเอนต์ในการคำนวณ Hash เช่น URL, Cookie หรือ Header บางอย่างครับ และเมื่อใช้ร่วมกับ consistent parameter จะทำให้เกิด Consistent Hashing ซึ่งช่วยลดผลกระทบเมื่อมีการเพิ่มหรือลดเซิร์ฟเวอร์ออกจากกลุ่ม

- ข้อดี: ยืดหยุ่นกว่า IP Hash และลดผลกระทบต่อ Session Persistence เมื่อมีการเปลี่ยนแปลงเซิร์ฟเวอร์

- ข้อเสีย: มีใน Nginx Plus เท่านั้น

Weight

สามารถกำหนดค่า Weight ให้กับแต่ละ Backend Server ได้ครับ โดยเซิร์ฟเวอร์ที่มีค่า Weight สูงกว่าจะได้รับคำขอมากกว่า Algorithm นี้สามารถใช้ร่วมกับ Round Robin หรือ Least Conn ได้

- ข้อดี: เหมาะสำหรับกรณีที่มี Backend Servers ที่มีฮาร์ดแวร์หรือความสามารถในการประมวลผลที่แตกต่างกัน ทำให้สามารถส่งโหลดไปยังเซิร์ฟเวอร์ที่มีประสิทธิภาพสูงกว่าได้มากขึ้น

- ข้อเสีย: ต้องมีการกำหนด Weight ด้วยตัวเอง ซึ่งอาจต้องมีการปรับจูน

Random

กระจายคำขอไปยัง Backend Server แบบสุ่มครับ โดยอาจจะมีการกำหนดค่า Weight ร่วมด้วยได้เช่นกัน

- ข้อดี: ใช้งานง่าย

- ข้อเสีย: ไม่ได้พิจารณาถึงโหลดของเซิร์ฟเวอร์ อาจทำให้การกระจายโหลดไม่สม่ำเสมอ

Least Time (สำหรับ Nginx Plus)

Algorithm นี้จะเลือก Backend Server ที่มี Latency ในการตอบสนองน้อยที่สุดและมีจำนวนการเชื่อมต่อน้อยที่สุดครับ เป็นการรวมข้อดีของ Least Conn และการพิจารณาประสิทธิภาพของเซิร์ฟเวอร์

- ข้อดี: ให้ประสิทธิภาพที่ดีที่สุด โดยพิจารณาทั้งจำนวนการเชื่อมต่อและเวลาในการตอบสนอง

- ข้อเสีย: มีใน Nginx Plus เท่านั้น

เพื่อความเข้าใจที่ชัดเจนยิ่งขึ้น ลองดูตารางเปรียบเทียบ Algorithm ยอดนิยมของ Nginx กันครับ:

| Algorithm | หลักการทำงาน | ข้อดี | ข้อเสีย | เหมาะสำหรับ |

|---|---|---|---|---|

| Round Robin | ส่งคำขอตามลำดับไปยังเซิร์ฟเวอร์ A, B, C, … | ตั้งค่าง่าย, กระจายโหลดพื้นฐาน | ไม่พิจารณาโหลดปัจจุบันของเซิร์ฟเวอร์ | Backend Servers มีความสามารถใกล้เคียงกัน, ระบบที่ไม่ต้องการ Session Persistence |

| Least Conn | ส่งคำขอไปยังเซิร์ฟเวอร์ที่มี Active Connections น้อยที่สุด | กระจายโหลดได้ดีขึ้นเมื่อคำขอใช้เวลาต่างกัน | อาจมีปัญหาหากเซิร์ฟเวอร์ที่มี Conn น้อยกำลังประมวลผลงานหนัก | Backend Servers มีความสามารถต่างกัน, คำขอใช้เวลาประมวลผลไม่เท่ากัน |

| IP Hash | ใช้ IP ของไคลเอนต์คำนวณ Hash เพื่อส่งไปยังเซิร์ฟเวอร์เดิม | รักษา Session Persistence ได้ดี (Sticky Sessions) | การกระจายโหลดอาจไม่สม่ำเสมอ, ผลกระทบเมื่อเซิร์ฟเวอร์ล่ม/เพิ่ม/ลด | แอปพลิเคชันที่ต้องการ Session Persistence (Stateful Applications) |

| Weight | กำหนดน้ำหนักให้แต่ละเซิร์ฟเวอร์ (ใช้ร่วมกับ Round Robin/Least Conn) | สามารถส่งโหลดให้เซิร์ฟเวอร์ที่มีประสิทธิภาพสูงกว่าได้มากขึ้น | ต้องมีการปรับจูนค่า Weight | Backend Servers มีความสามารถที่แตกต่างกันอย่างชัดเจน |

การเตรียมความพร้อมสำหรับการตั้งค่า Nginx Reverse Proxy Load Balancing

ก่อนที่เราจะลงมือตั้งค่า Nginx เรามาเตรียมความพร้อมของสภาพแวดล้อมกันก่อนครับ

โครงสร้างระบบที่แนะนำ

สำหรับบทความนี้ เราจะสมมติโครงสร้างระบบแบบง่ายๆ ดังนี้ครับ:

- Nginx Reverse Proxy / Load Balancer: 1 Server (IP:

192.168.1.10) - Backend Application Server 1: 1 Server (IP:

192.168.1.11) รันแอปพลิเคชันอยู่บน Port8080 - Backend Application Server 2: 1 Server (IP:

192.168.1.12) รันแอปพลิเคชันอยู่บน Port8080 - Backend Application Server 3: 1 Server (IP:

192.168.1.13) รันแอปพลิเคชันอยู่บน Port8080

โดย Backend Servers เหล่านี้อาจเป็น Web Server (Apache, Nginx เอง), Application Server (Node.js, Python, Java, PHP-FPM) หรืออะไรก็ได้ที่สามารถรับคำขอ HTTP ได้ครับ สำหรับการทดสอบ คุณอาจจะสร้างแอปพลิเคชันง่ายๆ ที่แสดงชื่อเซิร์ฟเวอร์หรือ IP Address ของตัวเอง เพื่อให้เห็นว่า Load Balancer ทำงานอย่างไรครับ

ข้อกำหนดเบื้องต้น

- ระบบปฏิบัติการ Linux: เช่น Ubuntu, CentOS หรือ Debian บนเซิร์ฟเวอร์ทั้งหมด

- สิทธิ์ Root หรือ Sudo: สำหรับการติดตั้งและแก้ไขไฟล์ Configuration

- Nginx ติดตั้งแล้ว: บนเซิร์ฟเวอร์ที่จะทำหน้าที่เป็น Reverse Proxy

- Backend Servers ทำงานอยู่: มีแอปพลิเคชันหรือเว็บเซิร์ฟเวอร์ทำงานอยู่บนพอร์ตที่กำหนด (เช่น 8080) บน Backend Servers ทั้งหมด

- การเชื่อมต่อเครือข่าย: Nginx Reverse Proxy ต้องสามารถเข้าถึง Backend Servers ได้

การติดตั้ง Nginx

หากคุณยังไม่ได้ติดตั้ง Nginx บนเซิร์ฟเวอร์ที่จะทำหน้าที่เป็น Reverse Proxy สามารถติดตั้งได้ตามคำสั่งด้านล่างนี้ครับ (เลือกตามระบบปฏิบัติการ)

สำหรับ Ubuntu/Debian:

sudo apt update

sudo apt install nginx -y

sudo systemctl enable nginx

sudo systemctl start nginxสำหรับ CentOS/RHEL:

sudo yum install epel-release -y

sudo yum update

sudo yum install nginx -y

sudo systemctl enable nginx

sudo systemctl start nginxหลังจากติดตั้งเสร็จ ลองเข้าถึง IP Address ของ Nginx Server ผ่านเว็บเบราว์เซอร์ คุณควรจะเห็นหน้า Welcome to Nginx! ครับ

คู่มือตั้งค่า Nginx Reverse Proxy Load Balancing

มาถึงส่วนสำคัญที่สุดของบทความนี้ครับ คือการตั้งค่า Nginx ให้ทำหน้าที่เป็น Reverse Proxy และ Load Balancer อย่างละเอียดทีละขั้นตอน

ไฟล์ Configuration หลักของ Nginx มักจะอยู่ที่ /etc/nginx/nginx.conf และไฟล์สำหรับ Virtual Hosts (Server Blocks) มักจะอยู่ในไดเรกทอรี /etc/nginx/sites-available/ และถูก Link ไปที่ /etc/nginx/sites-enabled/ ครับ เราจะสร้างไฟล์ Configuration ใหม่ใน sites-available

ขั้นตอนที่ 1: การกำหนดค่า Upstream Servers

เราจะเริ่มด้วยการกำหนดกลุ่มของ Backend Servers ที่ Nginx จะใช้ในการกระจายโหลด โดยใช้บล็อก upstream ครับ

สร้างไฟล์ Configuration ใหม่ เช่น /etc/nginx/sites-available/loadbalancer.conf หรือคุณจะแก้ไขไฟล์ /etc/nginx/nginx.conf โดยตรงในส่วน http {} ก็ได้ครับ (แต่การแยกไฟล์เป็นแนวปฏิบัติที่ดีกว่า)

sudo nano /etc/nginx/sites-available/loadbalancer.confเพิ่มโค้ดต่อไปนี้ลงในไฟล์ (หรือใน /etc/nginx/nginx.conf ภายในบล็อก http {}):

upstream backend_servers {

server 192.168.1.11:8080; # Backend Server 1

server 192.168.1.12:8080; # Backend Server 2

server 192.168.1.13:8080; # Backend Server 3

}คำอธิบาย:

upstream backend_servers { ... }: เป็นการประกาศกลุ่มของเซิร์ฟเวอร์ที่เรียกว่าbackend_serversคุณสามารถตั้งชื่ออะไรก็ได้ครับserver 192.168.1.11:8080;: แต่ละบรรทัดคือ IP Address และ Port ของ Backend Server ที่ Nginx จะส่งทราฟฟิกไปหาครับ

ขั้นตอนที่ 2: การกำหนดค่า Server Block สำหรับ Reverse Proxy

จากนั้น เราจะสร้าง server block เพื่อรับคำขอจากไคลเอนต์และส่งต่อไปยังกลุ่ม upstream ที่เราเพิ่งกำหนดไปครับ

เพิ่มโค้ดต่อไปนี้ต่อจากบล็อก upstream ในไฟล์ /etc/nginx/sites-available/loadbalancer.conf

server {

listen 80; # Nginx จะรับฟังคำขอ HTTP บนพอร์ต 80

server_name your_domain.com www.your_domain.com; # หรือ IP Address ของ Nginx Server

location / {

proxy_pass http://backend_servers; # ส่งคำขอไปยังกลุ่ม upstream ที่ชื่อ backend_servers

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}คำอธิบาย:

listen 80;: Nginx จะฟังการเชื่อมต่อ HTTP บนพอร์ต 80 ครับserver_name your_domain.com www.your_domain.com;: กำหนดชื่อโดเมนที่ Nginx จะรับผิดชอบ คุณควรเปลี่ยนเป็นโดเมนจริงของคุณ หรือใช้ IP Address ของ Nginx Server แทนก็ได้ครับlocation / { ... }: บล็อกนี้จะจัดการกับคำขอทั้งหมดที่เข้ามา (/หมายถึงทุก URL)proxy_pass http://backend_servers;: นี่คือคำสั่งหลักที่บอกให้ Nginx ทำ Reverse Proxy โดยส่งคำขอไปยังกลุ่มเซิร์ฟเวอร์ที่เรากำหนดไว้ในupstream backend_serversครับproxy_set_header ...: คำสั่งเหล่านี้เป็นการส่ง HTTP Headers เพิ่มเติมไปยัง Backend Servers เพื่อให้ Backend Servers ทราบข้อมูลต้นทางของคำขอ เช่น IP Address จริงของผู้ใช้งาน (X-Real-IP,X-Forwarded-For) และโปรโตคอลที่ใช้ (X-Forwarded-Proto) ครับ

ขั้นตอนที่ 3: การกำหนดค่า Load Balancing Algorithm

ในบล็อก upstream เราสามารถระบุ Algorithm ที่ต้องการใช้ได้ครับ หากไม่ระบุ Nginx จะใช้ Round Robin เป็นค่าเริ่มต้น

ตัวอย่างการใช้ Round Robin (ค่าเริ่มต้น ไม่ต้องระบุ):

upstream backend_servers {

server 192.168.1.11:8080;

server 192.168.1.12:8080;

server 192.168.1.13:8080;

# ไม่ต้องระบุ algorithm, จะใช้ Round Robin โดยอัตโนมัติ

}ตัวอย่างการใช้ Least Conn:

upstream backend_servers {

least_conn; # ระบุ algorithm ที่นี่

server 192.168.1.11:8080;

server 192.168.1.12:8080;

server 192.168.1.13:8080;

}ตัวอย่างการใช้ IP Hash (สำหรับ Session Persistence):

upstream backend_servers {

ip_hash; # ระบุ algorithm ที่นี่

server 192.168.1.11:8080;

server 192.168.1.12:8080;

server 192.168.1.13:8080;

}ตัวอย่างการใช้ Weight:

upstream backend_servers {

# ไม่ต้องระบุ algorithm หลักถ้าต้องการใช้ Round Robin ร่วมกับ Weight

server 192.168.1.11:8080 weight=3; # Server 1 ได้รับ 3 เท่าของโหลด

server 192.168.1.12:8080 weight=1; # Server 2 ได้รับ 1 เท่าของโหลด

server 192.168.1.13:8080 weight=1; # Server 3 ได้รับ 1 เท่าของโหลด

}ขั้นตอนที่ 4: การกำหนดค่า Health Checks และ Failover

Nginx สามารถตรวจสอบสถานะของ Backend Servers ได้ และจะหยุดส่งทราฟฟิกไปยังเซิร์ฟเวอร์ที่ล่มโดยอัตโนมัติครับ

คุณสามารถเพิ่มพารามิเตอร์ max_fails และ fail_timeout ในแต่ละ server directive ภายในบล็อก upstream ครับ

upstream backend_servers {

least_conn;

server 192.168.1.11:8080 max_fails=3 fail_timeout=30s;

server 192.168.1.12:8080 max_fails=3 fail_timeout=30s;

server 192.168.1.13:8080 max_fails=3 fail_timeout=30s;

server 192.168.1.14:8080 backup; # เซิร์ฟเวอร์สำรอง จะถูกใช้เมื่อเซิร์ฟเวอร์หลักทั้งหมดล่ม

server 192.168.1.15:8080 down; # เซิร์ฟเวอร์นี้จะไม่ถูกใช้งาน

}คำอธิบาย:

max_fails=3: หาก Nginx ไม่สามารถเชื่อมต่อกับ Backend Server นี้ได้ 3 ครั้งภายในระยะเวลาfail_timeoutNginx จะถือว่าเซิร์ฟเวอร์นี้ล่มfail_timeout=30s: ระยะเวลา (ในที่นี้คือ 30 วินาที) ที่ Nginx จะลองเชื่อมต่อไปยังเซิร์ฟเวอร์ที่ล้มเหลวอีกครั้งหลังจากที่ตรวจพบว่าล่ม หากเซิร์ฟเวอร์กลับมาใช้งานได้ Nginx จะเริ่มส่งทราฟฟิกไปให้ใหม่backup: เซิร์ฟเวอร์นี้จะถูกใช้เป็นเซิร์ฟเวอร์สำรอง เมื่อเซิร์ฟเวอร์หลักทั้งหมดในกลุ่มupstreamไม่สามารถใช้งานได้down: เซิร์ฟเวอร์นี้จะไม่ถูกใช้งานเลย เหมาะสำหรับเซิร์ฟเวอร์ที่ต้องการบำรุงรักษาชั่วคราว

ขั้นตอนที่ 5: การกำหนดค่า Session Persistence (Sticky Sessions)

Session Persistence หรือ Sticky Sessions คือการทำให้ผู้ใช้งานรายเดิมถูกส่งไปยัง Backend Server เครื่องเดิมเสมอ ซึ่งจำเป็นสำหรับแอปพลิเคชันที่เก็บสถานะ (Stateful Applications) ไว้บนเซิร์ฟเวอร์แต่ละเครื่องครับ

วิธีที่ง่ายที่สุดคือใช้ ip_hash Algorithm ตามที่กล่าวไปแล้วในขั้นตอนที่ 3 ครับ

upstream backend_servers {

ip_hash;

server 192.168.1.11:8080;

server 192.168.1.12:8080;

server 192.168.1.13:8080;

}ข้อควรระวัง: การใช้ ip_hash อาจทำให้การกระจายโหลดไม่สม่ำเสมอ หากมีไคลเอนต์จำนวนมากมาจาก IP Address เดียวกัน (เช่น มาจากเครือข่ายองค์กรเดียวกัน หรือใช้ Proxy เดียวกัน) ใน Nginx Plus มีโมดูลเพิ่มเติมเช่น sticky หรือ sticky_cookie ที่ให้ความยืดหยุ่นและประสิทธิภาพที่ดีกว่าสำหรับการทำ Sticky Sessions โดยใช้ Cookies

ขั้นตอนที่ 6: การกำหนดค่า SSL Termination (HTTPS)

การทำ SSL Termination ที่ Reverse Proxy (Nginx) หมายถึง Nginx จะเป็นผู้จัดการการเข้ารหัสและถอดรหัส SSL/TLS ทั้งหมดครับ ทำให้ Backend Servers ไม่จำเป็นต้องติดตั้งใบรับรอง SSL และไม่ต้องรับภาระในการประมวลผลการเข้ารหัส ซึ่งช่วยลดภาระงานของ Backend Servers ได้อย่างมาก และยังช่วยให้การจัดการใบรับรอง SSL เป็นแบบรวมศูนย์ครับ

สิ่งที่ต้องเตรียม: ใบรับรอง SSL (your_domain.crt) และ Private Key (your_domain.key) ซึ่งได้มาจากการขอใบรับรอง Let’s Encrypt หรือผู้ให้บริการ CA อื่นๆ ครับ ควรเก็บไว้ในที่ปลอดภัย เช่น /etc/nginx/ssl/

server {

listen 80;

server_name your_domain.com www.your_domain.com;

return 301 https://$host$request_uri; # Redirect HTTP ไปยัง HTTPS

}

server {

listen 443 ssl; # Nginx จะรับฟังคำขอ HTTPS บนพอร์ต 443

server_name your_domain.com www.your_domain.com;

ssl_certificate /etc/nginx/ssl/your_domain.crt; # ตำแหน่งของใบรับรอง SSL

ssl_certificate_key /etc/nginx/ssl/your_domain.key; # ตำแหน่งของ Private Key

ssl_protocols TLSv1.2 TLSv1.3; # แนะนำให้ใช้โปรโตคอลที่ปลอดภัย

ssl_ciphers "ECDHE-ECDSA-AES128-GCM-SHA256:ECDHE-RSA-AES128-GCM-SHA256:ECDHE-ECDSA-AES256-GCM-SHA384:ECDHE-RSA-AES256-GCM-SHA384:ECDHE-ECDSA-CHACHA20-POLY1305:ECDHE-RSA-CHACHA20-POLY1305:DHE-RSA-AES128-GCM-SHA256:DHE-RSA-AES256-GCM-SHA384";

ssl_prefer_server_ciphers on;

ssl_session_cache shared:SSL:10m;

ssl_session_timeout 10m;

location / {

proxy_pass http://backend_servers;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme; # แจ้ง Backend ว่าคำขอเดิมเป็น HTTPS

}

}ในตัวอย่างนี้ Nginx จะรับการเชื่อมต่อ HTTPS บนพอร์ต 443 และถอดรหัส SSL ก่อนที่จะส่งคำขอ HTTP ธรรมดาไปยัง Backend Servers ครับ (สังเกต proxy_pass http://backend_servers;)

ขั้นตอนที่ 7: การกำหนดค่า Caching

การทำ Caching ที่ Reverse Proxy ช่วยลดภาระของ Backend Servers และเพิ่มความเร็วในการตอบสนองได้อย่างมาก โดย Nginx จะเก็บสำเนาของ Response จาก Backend Servers ไว้ชั่วคราว เมื่อมีคำขอซ้ำ Nginx จะสามารถตอบสนองได้ทันทีโดยไม่ต้องไปเรียกจาก Backend Servers อีกครับ

ขั้นแรก ต้องกำหนด Directory สำหรับ Cache และขนาดของ Cache Zone ในบล็อก http {} (มักอยู่ใน /etc/nginx/nginx.conf)

http {

# ...

proxy_cache_path /var/cache/nginx levels=1:2 keys_zone=my_cache:10m max_size=10g inactive=60m use_temp_path=off;

# ...

}คำอธิบาย:

/var/cache/nginx: Path สำหรับเก็บไฟล์ Cachelevels=1:2: สร้างโครงสร้างไดเรกทอรี 2 ระดับ เพื่อการจัดเก็บที่มีประสิทธิภาพkeys_zone=my_cache:10m: สร้าง Shared Memory Zone ชื่อmy_cacheขนาด 10MB สำหรับเก็บ Metadata ของ Cache Keymax_size=10g: กำหนดขนาดสูงสุดของ Cache Directory เป็น 10GBinactive=60m: ไฟล์ที่ไม่ได้ถูกเรียกใช้ภายใน 60 นาทีจะถูกลบออกuse_temp_path=off: ป้องกันปัญหา I/O ด้วยการเขียนไฟล์ Cache โดยตรงไปยัง Directory ที่กำหนด

จากนั้น ใน location block ของ server block ของคุณ ให้เปิดใช้งาน Cache:

server {

listen 80;

server_name your_domain.com;

location / {

proxy_cache my_cache; # ใช้ Cache Zone ที่ชื่อ my_cache

proxy_cache_valid 200 302 10m; # Cache Response ที่มีสถานะ 200 หรือ 302 เป็นเวลา 10 นาที

proxy_cache_valid 404 1m; # Cache Response ที่มีสถานะ 404 เป็นเวลา 1 นาที

proxy_cache_min_uses 1; # Cache เมื่อมีการเรียกใช้ซ้ำอย่างน้อย 1 ครั้ง

proxy_cache_bypass $http_pragma $http_authorization; # ไม่ Cache หากมี Header เหล่านี้

proxy_no_cache $http_pragma $http_authorization;

add_header X-Proxy-Cache $upstream_cache_status; # เพิ่ม Header เพื่อตรวจสอบสถานะ Cache

proxy_pass http://backend_servers;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}หลังจากเพิ่มการตั้งค่า Cache แล้ว อย่าลืมสร้าง Directory สำหรับ Cache และตั้งค่าสิทธิ์การเข้าถึงให้ Nginx ด้วยครับ:

sudo mkdir -p /var/cache/nginx

sudo chown -R www-data:www-data /var/cache/nginx # สำหรับ Ubuntu/Debian

# หรือ sudo chown -R nginx:nginx /var/cache/nginx # สำหรับ CentOS/RHELขั้นตอนที่ 8: การจัดการ HTTP Headers

เราได้พูดถึง proxy_set_header ไปแล้วในเบื้องต้น แต่ก็มี Headers สำคัญอื่นๆ ที่ควรทำความเข้าใจเพิ่มเติมครับ

Host: $host: ส่ง Host Header เดิมจากไคลเอนต์ไปยัง Backend ServerX-Real-IP: $remote_addr: ส่ง IP Address จริงของไคลเอนต์X-Forwarded-For: $proxy_add_x_forwarded_for: ส่ง IP Address จริงของไคลเอนต์ และ IP Address ของ Proxy ที่อยู่ระหว่างทางทั้งหมด (เป็น List)X-Forwarded-Proto: $scheme: ส่งโปรโตคอลที่ไคลเอนต์ใช้ (http หรือ https)X-Forwarded-Host: $host: ส่ง Host Header เดิม (คล้ายกับ Host แต่เป็น Header ที่นิยมใช้กับ Proxies)

การส่ง Headers เหล่านี้มีความสำคัญอย่างยิ่ง เพื่อให้ Backend Servers สามารถทำงานได้อย่างถูกต้อง เช่น การบันทึก Log ที่ถูกต้อง หรือการสร้างลิงก์ที่ใช้โปรโตคอลที่เหมาะสมครับ

ขั้นตอนที่ 9: การทดสอบและการตรวจสอบ

หลังจากที่คุณแก้ไขไฟล์ Configuration ของ Nginx แล้ว สิ่งสำคัญที่สุดคือการทดสอบและตรวจสอบก่อนที่จะ Restart Nginx ครับ

ทดสอบ Syntax ของ Configuration:

sudo nginx -tหากไม่มีข้อผิดพลาด คุณจะเห็นข้อความประมาณว่า nginx: configuration file /etc/nginx/nginx.conf syntax is ok และ nginx: configuration file /etc/nginx/nginx.conf test is successful ครับ หากมีข้อผิดพลาด Nginx จะแจ้งตำแหน่งและรายละเอียดของข้อผิดพลาด

เปิดใช้งาน Configuration ใหม่:

หากคุณสร้างไฟล์ใหม่ใน /etc/nginx/sites-available/ อย่าลืมสร้าง Symbolic Link ไปที่ /etc/nginx/sites-enabled/ ครับ

sudo ln -s /etc/nginx/sites-available/loadbalancer.conf /etc/nginx/sites-enabled/จากนั้น Reload หรือ Restart Nginx เพื่อให้การตั้งค่ามีผล:

sudo systemctl reload nginx # แนะนำให้ใช้ reload เพื่อลด downtime

# หรือ

sudo systemctl restart nginx # หากมีการเปลี่ยนแปลงโครงสร้างหลัก หรือ reload ไม่ได้ผลทดสอบการทำงาน:

เปิดเว็บเบราว์เซอร์และเข้าถึงโดเมนหรือ IP Address ของ Nginx Reverse Proxy ของคุณ (เช่น http://your_domain.com หรือ https://your_domain.com) ลอง Refresh หน้าเว็บหลายๆ ครั้ง หาก Backend Servers ของคุณแสดง IP Address หรือชื่อของตัวเอง คุณจะเห็นว่าคำขอถูกส่งไปยัง Backend Servers ที่แตกต่างกันครับ

คุณยังสามารถใช้ curl เพื่อทดสอบได้:

curl http://your_domain.comหรือถ้ามีการทำ Cache:

curl -I http://your_domain.com # -I จะแสดงเฉพาะ Header, คุณจะเห็น X-Proxy-Cache: MISS หรือ HITตรวจสอบ Log ของ Nginx ที่ /var/log/nginx/access.log และ /var/log/nginx/error.log เพื่อดูว่ามีข้อผิดพลาดใดๆ เกิดขึ้นหรือไม่ครับ

เท่านี้คุณก็มี Nginx Reverse Proxy Load Balancing ที่ทำงานได้อย่างสมบูรณ์แล้วครับ! สำหรับรายละเอียดเพิ่มเติมเกี่ยวกับการตั้งค่า Nginx คุณสามารถ อ่านเพิ่มเติม ได้จากเอกสารประกอบของ Nginx โดยตรงครับ

เทคนิคและแนวปฏิบัติที่ดี (Best Practices)

เพื่อให้ Nginx Reverse Proxy Load Balancing ของคุณทำงานได้อย่างมีประสิทธิภาพสูงสุดและปลอดภัย นี่คือบางแนวปฏิบัติที่คุณควรพิจารณาครับ

การตรวจสอบและมอนิเตอร์ (Monitoring)

การมอนิเตอร์สถานะการทำงานของ Nginx และ Backend Servers เป็นสิ่งสำคัญอย่างยิ่งครับ

- Nginx Status Module: เปิดใช้งาน Nginx

ngx_http_stub_status_moduleเพื่อดูสถิติพื้นฐาน เช่น Active Connections, Requests per second เป็นต้น - Prometheus & Grafana: ใช้ Prometheus เพื่อเก็บ Metric จาก Nginx และ Backend Servers แล้วแสดงผลด้วย Grafana เพื่อสร้าง Dashboard ที่สวยงามและเข้าใจง่าย

- Log Management: รวบรวม Log จาก Nginx และ Backend Servers ไปยังระบบ Log Management แบบรวมศูนย์ (เช่น ELK Stack หรือ Graylog) เพื่อให้ง่ายต่อการวิเคราะห์และแก้ไขปัญหา

- Health Checks ขั้นสูง: Nginx Plus มีความสามารถในการทำ Health Check ที่ซับซ้อนกว่า เช่น ตรวจสอบ Endpoint ที่เฉพาะเจาะจง หรือตอบสนองต่อ HTTP Status Code ที่กำหนด

ความปลอดภัย (Security Hardening)

Nginx ที่เป็น Reverse Proxy เป็นด่านหน้าของระบบ การรักษาความปลอดภัยจึงเป็นสิ่งสำคัญครับ

- ปิดใช้งาน HTTP/1.0: หากไม่จำเป็น ให้จำกัดการรองรับโปรโตคอลเป็น HTTP/1.1 หรือ HTTP/2 เท่านั้น

- SSL/TLS Configuration: ใช้โปรโตคอล TLS เวอร์ชันล่าสุด (TLSv1.2, TLSv1.3) และ Ciphersuite ที่แข็งแกร่งเท่านั้น (ตามที่แสดงในตัวอย่าง SSL Termination)

- Rate Limiting: ป้องกันการโจมตีแบบ DoS/DDoS โดยการจำกัดจำนวนคำขอจาก IP Address เดียวกัน หรือจำนวนการเชื่อมต่อพร้อมกัน

- Web Application Firewall (WAF): พิจารณาใช้ WAF เช่น ModSecurity ร่วมกับ Nginx เพื่อป้องกันการโจมตีระดับ Application Layer

- Header Security: เพิ่ม Security Headers เช่น

Strict-Transport-Security,Content-Security-Policy,X-Frame-Options,X-Content-Type-Optionsเพื่อเพิ่มความปลอดภัยให้กับ Browser ของผู้ใช้งาน - ซ่อน Nginx Version: ในไฟล์

nginx.confเพิ่มserver_tokens off;เพื่อไม่ให้ Nginx เปิดเผยเวอร์ชันของตัวเองใน HTTP Headers

# ใน http {} block

server_tokens off;การจัดการ Configuration (Configuration Management)

เมื่อระบบของคุณเติบโต การจัดการไฟล์ Configuration ด้วยมือจะกลายเป็นเรื่องยากและเสี่ยงต่อข้อผิดพลาด

- Version Control: เก็บไฟล์ Configuration ของ Nginx ไว้ใน Git Repository เพื่อติดตามการเปลี่ยนแปลงและสามารถ Rollback ได้ง่าย

- Configuration Management Tools: ใช้เครื่องมือเช่น Ansible, Chef, Puppet หรือ SaltStack ในการจัดการและ Deploy Configuration ไปยัง Nginx Servers หลายเครื่อง

- แยกไฟล์ Config: แบ่ง Configuration เป็นไฟล์ย่อยๆ ตามฟังก์ชันการทำงาน (เช่น ไฟล์สำหรับ Upstream, ไฟล์สำหรับ Server Block แต่ละโดเมน) แล้วใช้

includedirective ในnginx.confเพื่อให้จัดการง่ายขึ้น

High Availability สำหรับ Nginx Proxy

แม้ว่า Nginx Load Balancer จะช่วยให้ Backend Servers มี High Availability แต่ตัว Nginx Proxy เองก็เป็น Single Point of Failure ได้เช่นกันครับ หาก Nginx Proxy ล่ม บริการทั้งหมดก็จะล่มตามไปด้วย เพื่อแก้ไขปัญหานี้ คุณสามารถทำ High Availability ให้กับ Nginx Proxy ได้ด้วยเทคนิคต่อไปนี้:

- Active-Passive Failover: ใช้ Nginx Proxy สองเครื่อง โดยเครื่องหนึ่งเป็น Active และอีกเครื่องเป็น Passive (Standby) เมื่อ Active ล่ม Passive จะเข้ามาทำงานแทน โดยใช้เครื่องมือเช่น Keepalived หรือ VRRP ในการจัดการ Virtual IP Address (VIP) ให้ชี้ไปยัง Nginx Proxy ที่เป็น Active เสมอ

- Active-Active Load Balancing: ใช้ Nginx Proxy สองเครื่องขึ้นไปทำงานพร้อมกัน โดยมี Global Load Balancer (เช่น DNS-based Load Balancing หรือ Cloud Load Balancer) อยู่ด้านหน้าเพื่อกระจายทราฟฟิกไปยัง Nginx Proxy ทั้งสองเครื่องครับ

การลงทุนในเรื่อง High Availability สำหรับ Nginx Proxy เป็นสิ่งสำคัญอย่างยิ่งสำหรับระบบที่ต้องการความต่อเนื่องของบริการในระดับสูงครับ

ประโยชน์ของการใช้ Nginx Reverse Proxy Load Balancing

หลังจากที่เราได้เรียนรู้รายละเอียดการตั้งค่าและแนวปฏิบัติที่ดีไปแล้ว มาสรุปประโยชน์หลักๆ ที่คุณจะได้รับจากการนำ Nginx Reverse Proxy Load Balancing ไปใช้งานกันอีกครั้งครับ

- เพิ่มประสิทธิภาพและความเร็ว: การกระจายโหลดช่วยให้คำขอถูกประมวลผลได้เร็วขึ้น และ Nginx ยังสามารถทำ Caching เพื่อลดภาระของ Backend Servers ได้อีกด้วย

- เพิ่มความน่าเชื่อถือและความต่อเนื่องของบริการ (High Availability): หากเซิร์ฟเวอร์ใดล่ม Nginx จะตรวจพบและส่งทราฟฟิกไปยังเซิร์ฟเวอร์ที่ยังทำงานอยู่ ทำให้บริการของคุณไม่หยุดชะงัก

- ความสามารถในการขยายขนาด (Scalability): คุณสามารถเพิ่ม Backend Servers เข้าไปในกลุ่มได้อย่างง่ายดายเมื่อปริมาณทราฟฟิกเพิ่มขึ้น โดยไม่ต้องหยุดบริการ

- เพิ่มความปลอดภัย: ซ่อน IP Address และรายละเอียดของ Backend Servers จากโลกภายนอก และสามารถจัดการ SSL Termination แบบรวมศูนย์ได้ที่ Nginx

- ลดภาระของ Backend Servers: Nginx สามารถจัดการ SSL/TLS, Caching, และการบีบอัดข้อมูล ทำให้ Backend Servers มีทรัพยากรไปใช้ในการประมวลผลแอปพลิเคชันหลักได้อย่างเต็มที่

- ความยืดหยุ่นในการจัดการ: สามารถปรับเปลี่ยน Backend Servers, ทำ A/B Testing, หรือปรับแต่ง Routing ได้อย่างง่ายดายที่ Nginx

ด้วยประโยชน์มากมายเหล่านี้ Nginx Reverse Proxy Load Balancing จึงเป็นเครื่องมือที่ขาดไม่ได้สำหรับโครงสร้างพื้นฐานของเว็บแอปพลิเคชันสมัยใหม่ครับ

คำถามที่พบบ่อย (FAQ)

Q1: Nginx Reverse Proxy แตกต่างจาก Forward Proxy อย่างไรครับ?

A1: ต่างกันที่ทิศทางและวัตถุประสงค์ครับ

Forward Proxy: ทำงานในฝั่งไคลเอนต์ เป็นตัวกลางระหว่างไคลเอนต์กับอินเทอร์เน็ต ไคลเอนต์ใช้ Forward Proxy เพื่อเข้าถึงเว็บไซต์ต่างๆ มักใช้เพื่อซ่อน IP ของไคลเอนต์, เข้าถึงเนื้อหาที่ถูกบล็อก หรือแคชข้อมูลในฝั่งผู้ใช้งานครับ

Reverse Proxy: ทำงานในฝั่งเซิร์ฟเวอร์ เป็นตัวกลางระหว่างอินเทอร์เน็ตกับ Backend Servers ไคลเอนต์เชื่อมต่อกับ Reverse Proxy โดยไม่รู้ว่ามี Backend Servers อยู่ด้านหลัง ใช้เพื่อ Load Balancing, เพิ่มความปลอดภัย, SSL Termination และ Caching ครับ

Q2: การใช้ Nginx เป็น Load Balancer มีข้อจำกัดอะไรบ้างครับ?

A2: Nginx แบบ Open Source มีข้อจำกัดบางประการเมื่อเทียบกับ Load Balancer เชิงพาณิชย์ หรือ Nginx Plus ครับ เช่น:

- Health Checks: Nginx Open Source มี Health Check พื้นฐาน (TCP level) เท่านั้น ไม่สามารถทำ Health Check แบบ HTTP (เช่น ตรวจสอบ Status Code หรือ Content ของ Response) ได้อย่างละเอียดเท่า Nginx Plus

- Dynamic Reconfiguration: การเปลี่ยนแปลง Upstream Servers (เพิ่ม/ลด) ต้องมีการ Reload Nginx Configuration เสมอ ซึ่งอาจทำให้เกิด Downtime สั้นๆ (แม้จะน้อยมาก) ในขณะที่ Nginx Plus สามารถทำ Dynamic Reconfiguration ผ่าน API ได้

- Monitoring: ฟีเจอร์ Monitoring ใน Nginx Open Source มีจำกัด ต้องพึ่งพา External Tools มากกว่า

- Advanced Load Balancing Algorithms: Algorithm บางตัว เช่น Least Time, หรือ Consistent Hashing ที่ยืดหยุ่นกว่า IP Hash มีเฉพาะใน Nginx Plus ครับ

แต่สำหรับส่วนใหญ่ของ Use Case ทั่วไป Nginx Open Source ก็เพียงพอและมีประสิทธิภาพสูงครับ

Q3: ควรตั้งค่า SSL Termination ที่ Nginx Reverse Proxy หรือที่ Backend Servers ดีครับ?

A3: โดยทั่วไปแล้ว แนะนำให้ตั้งค่า SSL Termination ที่ Nginx Reverse Proxy ครับ นี่คือเหตุผล:

- ลดภาระของ Backend Servers: การเข้ารหัสและถอดรหัส SSL/TLS เป็นกระบวนการที่ใช้ทรัพยากร CPU สูง การให้ Nginx จัดการส่วนนี้จะช่วยให้ Backend Servers มีทรัพยากรไปใช้ในการประมวลผลแอปพลิเคชันหลักได้อย่างเต็มที่

- รวมศูนย์การจัดการ: การจัดการใบรับรอง SSL ทั้งหมดจะทำที่ Nginx เพียงจุดเดียว ทำให้ง่ายต่อการติดตั้ง, ต่ออายุ, และแก้ไขปัญหา

- เพิ่มประสิทธิภาพ: Nginx ถูกออกแบบมาเพื่อจัดการกับการเชื่อมต่อจำนวนมากได้อย่างมีประสิทธิภาพสูง การทำ SSL Termination ที่ Nginx จึงมักจะเร็วกว่า

- ความปลอดภัย: แม้ว่าการสื่อสารระหว่าง Nginx กับ Backend Servers จะเป็น HTTP ธรรมดา แต่การสื่อสารนี้มักจะเกิดขึ้นภายในเครือข่ายส่วนตัว (Private Network) ที่ปลอดภัยอยู่แล้วครับ

อย่างไรก็ตาม หากแอปพลิเคชันของคุณมีความต้องการความปลอดภัยสูงมาก หรือมีข้อกำหนดด้าน Compliance ที่เข้มงวด อาจพิจารณาการเข้ารหัสแบบ End-to-End (HTTPS ตลอดทั้งเส้นทาง) ซึ่ง Nginx จะทำ SSL Passthrough แทนการ Termination ครับ

Q4: ถ้าใช้ IP Hash แล้ว Backend Server ล่ม จะเกิดอะไรขึ้นกับ Session ของผู้ใช้งานคนนั้นครับ?

A4: หากคุณใช้ ip_hash และ Backend Server ที่ผู้ใช้งานคนนั้นกำลังเชื่อมต่ออยู่ล่ม ผู้ใช้งานรายนั้นจะหลุดจาก Session เดิมและอาจต้องเข้าสู่ระบบใหม่ครับ

เมื่อเซิร์ฟเวอร์ล่ม Nginx จะตรวจพบตามการตั้งค่า max_fails และ fail_timeout และจะหยุดส่งทราฟฟิกไปยังเซิร์ฟเวอร์นั้น แต่เนื่องจาก ip_hash จะพยายามส่งคำขอจาก IP เดิมไปยังเซิร์ฟเวอร์เดิมเสมอ เมื่อเซิร์ฟเวอร์นั้นไม่พร้อมใช้งาน Nginx จะพยายามส่งไปยังเซิร์ฟเวอร์อื่นในกลุ่ม แต่ข้อมูล Session ที่เคยเก็บไว้บนเซิร์ฟเวอร์ที่ล่มนั้นจะหายไปครับ

เพื่อหลีกเลี่ยงปัญหานี้สำหรับแอปพลิเคชันที่ต้องการ Session Persistence สูง ควรพิจารณาใช้ Centralized Session Storage เช่น Redis, Memcached, หรือ Database เพื่อเก็บข้อมูล Session แทนการเก็บไว้บน Backend Server แต่ละเครื่องครับ

Q5: เราสามารถใช้ Nginx ทำ Load Balancing สำหรับบริการที่ไม่ใช่ HTTP/HTTPS ได้ไหมครับ?

A5: ได้ครับ! Nginx มีโมดูล stream ซึ่งช่วยให้สามารถทำ Load Balancing สำหรับโปรโตคอล TCP และ UDP ได้ครับ ซึ่งหมายความว่าคุณสามารถใช้ Nginx เพื่อ Load Balance บริการต่างๆ เช่น:

- Database Connections: เช่น MySQL, PostgreSQL

- Mail Servers: เช่น SMTP, IMAP, POP3

- Custom TCP/UDP Services: บริการอื่นๆ ที่ใช้ TCP หรือ UDP

การตั้งค่าจะคล้ายคลึงกับการทำ HTTP Load Balancing แต่จะอยู่ในบล็อก stream {} แทน http {} ครับ ตัวอย่างเช่น:

stream {

upstream database_cluster {

least_conn;

server 192.168.1.20:3306;

server 192.168.1.21:3306;

}

server {

listen 3306;

proxy_pass database_cluster;

}

}การเปิดใช้งานโมดูล stream อาจต้องมีการ Compile Nginx ด้วย --with-stream หากไม่ได้ติดตั้งมาให้โดยค่าเริ่มต้นครับ คุณสามารถ อ่านเพิ่มเติม เกี่ยวกับ Nginx stream module ได้จากเอกสารประกอบของ Nginx ครับ

สรุป

Nginx Reverse Proxy Load Balancing เป็นโซลูชันที่ทรงพลังและยืดหยุ่นอย่างยิ่งในการยกระดับโครงสร้างพื้นฐานของเว็บแอปพลิเคชันของคุณครับ ไม่ว่าจะเป็นการเพิ่มความสามารถในการรองรับทราฟฟิก, เพิ่มความน่าเชื่อถือ, เสริมสร้างความปลอดภัย หรือปรับปรุงประสิทธิภาพโดยรวม Nginx ก็สามารถตอบโจทย์เหล่านี้ได้อย่างยอดเยี่ยม ด้วยการตั้งค่าที่ละเอียดและตัวอย่างโค้ดที่เราได้นำเสนอไปในบทความนี้ คุณก็มีความพร้อมที่จะนำ Nginx ไปใช้งานในสภาพแวดล้อมจริงได้อย่างมั่นใจแล้วครับ การลงทุนในความเข้าใจและการตั้งค่า Nginx อย่างถูกต้องจะส่งผลดีต่อเสถียรภาพและประสิทธิภาพของระบบในระยะยาวอย่างแน่นอนครับ

Call to Action

เราหวังว่าคู่มือตั้งค่า Nginx Reverse Proxy Load Balancing ฉบับสมบูรณ์นี้จะเป็นประโยชน์อย่างยิ่งสำหรับคุณครับ หากคุณมีคำถาม ข้อเสนอแนะ หรือต้องการความช่วยเหลือเพิ่มเติมในการตั้งค่า Nginx สำหรับระบบของคุณ อย่าลังเลที่จะติดต่อทีมงานผู้เชี่ยวชาญของเราที่ SiamLancard.com ได้เลยครับ เราพร้อมให้คำปรึกษาและบริการเพื่อช่วยให้ระบบของคุณทำงานได้อย่างราบรื่นและมีประสิทธิภาพสูงสุดครับ หรือหากคุณได้ลองนำไปใช้งานแล้ว และมีประสบการณ์ดีๆ อยากแบ่งปัน ก็สามารถคอมเมนต์บอกเล่าเรื่องราวของคุณได้เลยนะครับ!