ในโลกของการพัฒนาและดูแลรักษาระบบที่ขับเคลื่อนด้วยคอนเทนเนอร์ คำว่า Docker ได้กลายเป็นส่วนหนึ่งที่ขาดไม่ได้สำหรับการสร้าง, จัดส่ง, และรันแอปพลิเคชันของเราครับ แต่เมื่อพูดถึงการจัดการแอปพลิเคชันที่มีหลายส่วนประกอบ (multi-service applications) ในสภาพแวดล้อม Production หลายคนอาจจะคิดถึง Orchestration Tool ขนาดใหญ่อย่าง Kubernetes เป็นอันดับแรก อย่างไรก็ตาม Docker Compose ซึ่งมักถูกมองว่าเป็นเครื่องมือสำหรับนักพัฒนาหรือการทดสอบ ก็ได้พิสูจน์ให้เห็นถึงความสามารถและความยืดหยุ่นที่น่าทึ่ง และยังคงเป็นตัวเลือกที่แข็งแกร่งสำหรับการใช้งานจริงใน Production โดยเฉพาะอย่างยิ่งในปี 2026 ที่เทคโนโลยีมีการเปลี่ยนแปลงอย่างรวดเร็ว บทความนี้จะเจาะลึกถึงวิธีการใช้ Docker Compose ใน Production อย่างมีประสิทธิภาพ ปลอดภัย และพร้อมรับมือกับความท้าทายต่างๆ ครับ

สารบัญ

- Docker Compose ในบริบทของ Production 2026

- พื้นฐาน Docker Compose ที่คุณต้องรู้ (Production-focused)

- สถาปัตยกรรมและการออกแบบสำหรับ Production

- การปรับแต่ง Docker Compose สำหรับประสิทธิภาพและความเสถียรใน Production

- กลยุทธ์การ Deploy และ Update แอปพลิเคชันด้วย Docker Compose

- การจัดการ Secrets ใน Production ด้วย Docker Compose

- การ Monitoring และ Troubleshooting แอปพลิเคชันบน Docker Compose

- Docker Compose กับอนาคตของ Container Orchestration (2026 Perspective)

- ตารางเปรียบเทียบ: Docker Compose vs. Kubernetes (สำหรับ Production)

- ตัวอย่าง Docker Compose สำหรับ Production จริง

- FAQ (คำถามที่พบบ่อย)

- บทสรุปและ Call-to-Action

Docker Compose ในบริบทของ Production 2026

ในยุคที่ Cloud Native Computing Foundation (CNCF) ได้ผลักดันมาตรฐานและการใช้งาน Kubernetes ไปอย่างกว้างขวาง หลายคนอาจสงสัยว่า Docker Compose ยังมีที่ยืนใน Production ในปี 2026 ได้อย่างไรกันครับ คำตอบคือมีอย่างแน่นอน! Docker Compose ไม่ได้ถูกออกแบบมาเพื่อทดแทน Kubernetes แต่เป็นเครื่องมือที่มีจุดแข็งในด้านความเรียบง่าย, ความรวดเร็วในการเซ็ตอัพ, และการจัดการแอปพลิเคชันที่มีหลายบริการบนเซิร์ฟเวอร์เดี่ยว (single-host) หรือแม้แต่กลุ่มเซิร์ฟเวอร์ขนาดเล็กที่มีความต้องการไม่ซับซ้อนมากนัก

ในปี 2026 นี้ Docker Compose ยังคงเป็นหัวใจสำคัญสำหรับทีมพัฒนาที่ต้องการจำลองสภาพแวดล้อม Production บนเครื่องของตนเองได้อย่างรวดเร็ว และยังเป็นตัวเลือกที่ยอดเยี่ยมสำหรับ Production ที่ต้องการความคล่องตัวสูง โดยไม่ต้องแบกรับภาระความซับซ้อนของ Orchestration Tools ขนาดใหญ่มากเกินไป โดยเฉพาะอย่างยิ่งสำหรับ Microservices ที่มีขนาดไม่ใหญ่มาก เว็บไซต์ขนาดกลาง หรือแม้แต่แบ็คเอนด์ของแอปพลิเคชันมือถือ Compose ยังคงสามารถให้บริการได้อย่างมีประสิทธิภาพและคุ้มค่าครับ

บทความนี้จะแสดงให้เห็นว่า Docker Compose นั้นไม่ได้เป็นเพียงแค่ “เครื่องมือสำหรับนักพัฒนา” เท่านั้น แต่เป็นแพลตฟอร์มที่มีความสามารถในการรองรับ Production Workload ได้อย่างมืออาชีพ หากได้รับการตั้งค่าและจัดการอย่างถูกต้องครับ

พื้นฐาน Docker Compose ที่คุณต้องรู้ (Production-focused)

ก่อนที่เราจะก้าวเข้าสู่การใช้งานจริงใน Production เรามาทบทวนพื้นฐานที่สำคัญของ Docker Compose ที่จำเป็นต้องใช้ใน Production กันก่อนครับ

โครงสร้างไฟล์ docker-compose.yml และเวอร์ชัน

ไฟล์ docker-compose.yml คือหัวใจของ Compose ที่ใช้ในการกำหนดโครงสร้าง, การตั้งค่า, และความสัมพันธ์ของบริการต่างๆ ในแอปพลิเคชันของเราครับ

version: '3.8' # แนะนำให้ใช้เวอร์ชันล่าสุดเสมอ เพื่อเข้าถึงฟีเจอร์ใหม่ๆ

services:

web:

image: myapp/web:latest

ports:

- "80:80"

environment:

NODE_ENV: production

depends_on:

- api

networks:

- app-network

volumes:

- ./nginx.conf:/etc/nginx/nginx.conf:ro

# ... การตั้งค่าอื่นๆ สำหรับ Production

api:

image: myapp/api:latest

environment:

DATABASE_URL: postgresql://user:password@db:5432/mydb

networks:

- app-network

depends_on:

db:

condition: service_healthy # รอให้ db พร้อมใช้งานก่อน

# ...

db:

image: postgres:13

environment:

POSTGRES_DB: mydb

POSTGRES_USER: user

POSTGRES_PASSWORD: password

volumes:

- db_data:/var/lib/postgresql/data

networks:

- app-network

healthcheck: # การตรวจสอบสุขภาพของ Database

test: ["CMD-SHELL", "pg_isready -U user -d mydb"]

interval: 5s

timeout: 5s

retries: 5

networks:

app-network:

driver: bridge # หรือ overlay หากใช้ Docker Swarm (แต่บทความนี้เน้นเดี่ยว)

volumes:

db_data:

driver: local # หรือใช้ driver สำหรับ network storage เช่น NFS

ในไฟล์นี้ เราได้กำหนดบริการ web, api, และ db โดยมีการตั้งค่าที่สำคัญสำหรับ Production เช่น environment variables, networks สำหรับการสื่อสารภายใน, volumes สำหรับการเก็บข้อมูลแบบถาวร, และ healthcheck สำหรับบริการฐานข้อมูล ซึ่งเป็นสิ่งสำคัญอย่างยิ่งใน Production ครับ

การจัดการ Environment Variables และ Secrets

การจัดการ Environment Variables อย่างปลอดภัยเป็นสิ่งสำคัญใน Production ครับ

.envfile: ใช้สำหรับตัวแปรที่ไม่ใช่ข้อมูลที่อ่อนไหวมากนัก หรือตัวแปรที่แตกต่างกันไปในแต่ละ environment (เช่น PORT, DEBUG_MODE)environmentblock: กำหนดตัวแปรในไฟล์ Compose โดยตรง เหมาะสำหรับตัวแปรที่ตายตัวหรือไม่ใช่ข้อมูลลับenv_file: ชี้ไปยังไฟล์ Environment Variables ภายนอก เหมาะสำหรับกรณีที่มีตัวแปรจำนวนมากsecrets: สำหรับข้อมูลที่อ่อนไหวสูง เช่น API Keys, Database Passwords (เราจะเจาะลึกในหัวข้อ การจัดการ Secrets)

# docker-compose.prod.yml

version: '3.8'

services:

api:

image: myapp/api:latest

env_file:

- ./.env.prod # โหลดตัวแปรจากไฟล์ .env.prod

secrets: # ใช้ Docker Secrets

- db_password

- api_key_stripe

secrets:

db_password:

file: ./secrets/db_password.txt # ไฟล์ที่มีรหัสผ่าน

api_key_stripe:

file: ./secrets/stripe_key.txt

การใช้ secrets จะทำให้ข้อมูลลับถูกจัดการอย่างปลอดภัยโดย Docker Engine และถูกส่งไปยังคอนเทนเนอร์ในรูปแบบของไฟล์ Read-Only ซึ่งดีกว่าการใช้ Environment Variables โดยตรงครับ

การใช้ Profiles สำหรับ Environment ที่แตกต่างกัน

profiles เป็นฟีเจอร์ที่ช่วยให้เรากำหนดชุดของบริการที่จะรันในสถานการณ์ที่แตกต่างกันได้ง่ายขึ้น เช่น dev, prod, test

# docker-compose.yml (ไฟล์หลัก)

version: '3.8'

services:

web:

image: myapp/web:latest

ports:

- "80:80"

networks:

- app-network

api:

image: myapp/api:latest

networks:

- app-network

profiles: ["production", "development"] # บริการนี้จะถูกรันในทั้งสองโปรไฟล์

db:

image: postgres:13

networks:

- app-network

profiles: ["production", "development"]

test-runner:

image: myapp/test-runner:latest

profiles: ["test"] # บริการนี้จะรันเฉพาะเมื่อระบุโปรไฟล์ 'test' เท่านั้น

networks:

- app-network

networks:

app-network:

ในการรัน:

docker compose --profile production up -dจะรันweb,api,dbdocker compose --profile test up -dจะรันweb,test-runner

ฟีเจอร์นี้ช่วยให้การจัดการไฟล์ Compose สำหรับหลาย Environment มีความยืดหยุ่นและเป็นระเบียบมากขึ้นครับ

การใช้ extends เพื่อลดความซ้ำซ้อน

เมื่อเรามีบริการที่มีการตั้งค่าพื้นฐานคล้ายกัน แต่มีการปรับเปลี่ยนเล็กน้อยในแต่ละ Environment การใช้ extends ช่วยลดความซ้ำซ้อนได้ดีครับ

# docker-compose.base.yml (ไฟล์พื้นฐาน)

version: '3.8'

services:

web:

image: myapp/web

networks:

- app-network

restart: unless-stopped

# การตั้งค่าพื้นฐานอื่นๆ

networks:

app-network:

# docker-compose.prod.yml (ไฟล์ Production)

version: '3.8'

services:

web:

extends:

file: docker-compose.base.yml

service: web

ports:

- "80:80" # กำหนด port สำหรับ Production

environment:

NODE_ENV: production

logging: # กำหนด logging driver สำหรับ Production

driver: "json-file"

options:

max-size: "10m"

max-file: "5"

ด้วย extends เราสามารถสร้างไฟล์ Base Compose ที่มี Common Configuration แล้วค่อย Extend และ Override ค่าที่ต้องการในไฟล์สำหรับแต่ละ Environment ได้อย่างง่ายดายครับ

สถาปัตยกรรมและการออกแบบสำหรับ Production

การออกแบบสถาปัตยกรรมแอปพลิเคชันด้วย Docker Compose สำหรับ Production นั้นต้องพิจารณาหลายปัจจัยเพื่อให้ระบบมีความเสถียร ปลอดภัย และมีประสิทธิภาพสูงสุดครับ

การแยกไฟล์ Compose สำหรับแต่ละ Environment

นี่คือหลักการสำคัญในการจัดการ Docker Compose ใน Production ครับ เราควรมีไฟล์ Compose หลัก (docker-compose.yml) ที่เก็บการตั้งค่าพื้นฐานที่ใช้ร่วมกัน และไฟล์เพิ่มเติม (เช่น docker-compose.prod.yml, docker-compose.dev.yml) สำหรับการตั้งค่าเฉพาะของแต่ละ Environment

# docker-compose.yml (ไฟล์หลัก - การตั้งค่าพื้นฐาน)

version: '3.8'

services:

web:

build:

context: ./web

networks:

- app-network

restart: always

api:

build:

context: ./api

networks:

- app-network

restart: always

db:

image: postgres:13

environment:

POSTGRES_USER: ${DB_USER}

POSTGRES_PASSWORD: ${DB_PASSWORD}

POSTGRES_DB: ${DB_NAME}

volumes:

- db_data:/var/lib/postgresql/data

networks:

- app-network

healthcheck:

test: ["CMD-SHELL", "pg_isready -U ${DB_USER} -d ${DB_NAME}"]

interval: 10s

timeout: 5s

retries: 5

restart: always

networks:

app-network:

driver: bridge

volumes:

db_data:

# docker-compose.prod.yml (ไฟล์สำหรับ Production - Override และเพิ่ม Production-specific settings)

version: '3.8'

services:

web:

ports:

- "80:80"

environment:

NODE_ENV: production

logging:

driver: "json-file"

options:

max-size: "10m"

max-file: "5"

deploy: # การตั้งค่าสำหรับการ Deploy ที่เฉพาะเจาะจง

resources:

limits:

cpus: '0.5'

memory: 512M

reservations:

cpus: '0.25'

memory: 256M

depends_on:

api:

condition: service_started # รอ api เริ่มต้นก่อน

api:

environment:

NODE_ENV: production

DATABASE_URL: postgresql://${DB_USER}:${DB_PASSWORD}@db:5432/${DB_NAME}

secrets:

- api_key_stripe

deploy:

resources:

limits:

cpus: '1.0'

memory: 1024M

reservations:

cpus: '0.5'

memory: 512M

depends_on:

db:

condition: service_healthy # รอ db พร้อมใช้งานก่อน

db:

environment:

POSTGRES_PASSWORD: ${DB_ROOT_PASSWORD} # ใช้รหัสผ่าน root ที่แตกต่างกันใน prod

volumes:

- /mnt/prod-data/db:/var/lib/postgresql/data # ใช้ Path จริงใน Production

deploy:

resources:

limits:

cpus: '1.0'

memory: 2048M

reservations:

cpus: '0.5'

memory: 1024M

secrets:

api_key_stripe:

file: ./secrets/stripe_key_prod.txt # ไฟล์ secret เฉพาะสำหรับ Production

ในการรัน Production: docker compose -f docker-compose.yml -f docker-compose.prod.yml up -d

วิธีนี้ช่วยให้เราแยกส่วนของการตั้งค่าสำหรับ Development และ Production ออกจากกันได้อย่างชัดเจน และลดโอกาสเกิดความผิดพลาดจากการนำการตั้งค่าที่ไม่เหมาะสมไปใช้ใน Production ครับ

การจัดการ Stateful Services (Databases, Caching)

Stateful Services เช่น Database (PostgreSQL, MySQL) และ Caching (Redis) ต้องการการดูแลเป็นพิเศษใน Production เพื่อให้ข้อมูลไม่สูญหาย

- Persistent Volumes: สิ่งสำคัญที่สุดคือการใช้ Docker Volumes เพื่อเก็บข้อมูลของ Database และ Caching อยู่นอกคอนเทนเนอร์ครับ หากคอนเทนเนอร์ถูกลบหรืออัปเดต ข้อมูลจะยังคงอยู่

- Backup Strategy: ต้องมีแผนการ Backup ข้อมูลที่ชัดเจนและอัตโนมัติ ไม่ว่าจะเป็นการใช้ Cron Job รันสคริปต์ Backup จากโฮสต์ หรือใช้คอนเทนเนอร์สำหรับ Backup โดยเฉพาะ

- Configuration: ตั้งค่า Database และ Caching ให้เหมาะสมกับ Production เช่น การจำกัดการเชื่อมต่อ, การใช้ Replica Sets (หากรองรับ), การกำหนดหน่วยความจำ, และการใช้รหัสผ่านที่แข็งแกร่ง

# ตัวอย่างการตั้งค่า Database Volume และ Health Check

services:

db:

image: postgres:13

environment:

POSTGRES_DB: mydb

POSTGRES_USER: user

POSTGRES_PASSWORD: password

volumes:

- /mnt/data/prod-db:/var/lib/postgresql/data # แนะนำให้ใช้ bind mount ไปยังพาร์ทจริงบนโฮสต์

healthcheck:

test: ["CMD-SHELL", "pg_isready -U user -d mydb"]

interval: 10s

timeout: 5s

retries: 5

start_period: 30s # ให้เวลานานขึ้นสำหรับ database ในการเริ่มต้น

restart: unless-stopped

# ... การตั้งค่าอื่นๆ

redis:

image: redis:6-alpine

volumes:

- /mnt/data/prod-redis:/data # Persistent volume สำหรับ Redis

restart: unless-stopped

# ...

Load Balancing และ Reverse Proxy

แม้ Docker Compose จะไม่ได้มี Load Balancer ในตัวเหมือน Kubernetes แต่เราสามารถใช้บริการ Reverse Proxy/Load Balancer เช่น Nginx หรือ Traefik เป็นคอนเทนเนอร์ในไฟล์ Compose ได้ครับ

- Nginx: เป็นตัวเลือกยอดนิยมสำหรับการทำ Reverse Proxy และ Load Balancing ทั่วไป สามารถใช้ Nginx เป็นบริการใน Compose และกำหนดค่าให้ส่งต่อ Request ไปยังบริการ Web/API ของเรา

- Traefik: เป็น Edge Router ที่ออกแบบมาสำหรับ Microservices โดยเฉพาะ สามารถค้นหาบริการ Docker ได้โดยอัตโนมัติ (Service Discovery) และจัดการ SSL/TLS ได้ง่ายกว่า Nginx ในบางกรณี

# ตัวอย่างการใช้ Nginx เป็น Reverse Proxy

services:

nginx:

image: nginx:stable-alpine

ports:

- "80:80"

- "443:443" # สำหรับ HTTPS

volumes:

- ./nginx/nginx.conf:/etc/nginx/nginx.conf:ro

- ./nginx/certs:/etc/nginx/certs:ro # สำหรับ SSL/TLS Certificates

depends_on:

- web

networks:

- app-network

restart: always

web:

# ... (service web ของคุณ)

expose: # ไม่จำเป็นต้องเปิด Port สู่ภายนอกโดยตรง เพราะ Nginx จะจัดการให้

- "80"

networks:

- app-network

# ...

networks:

app-network:

ไฟล์ nginx.conf จะกำหนดค่าให้ Nginx ส่งต่อ Request ไปยังบริการ web ภายในเครือข่าย Docker ครับ การใช้ Reverse Proxy ยังช่วยให้เราสามารถจัดการ SSL/TLS, Caching, และ Rate Limiting ได้อีกด้วย

การจัดการ Network สำหรับ Production

การกำหนดค่า Network ใน Docker Compose อย่างเหมาะสมเป็นสิ่งสำคัญสำหรับความปลอดภัยและประสิทธิภาพ

- Custom Networks: ควรสร้าง Custom Bridge Network สำหรับแอปพลิเคชันของเราเอง แทนที่จะใช้ Default Bridge Network ครับ สิ่งนี้ช่วยให้บริการต่างๆ ในแอปพลิเคชันของเราสามารถสื่อสารกันได้อย่างปลอดภัยและแยกจากคอนเทนเนอร์อื่นๆ บนโฮสต์เดียวกัน

- Network Isolation: หากมีแอปพลิเคชันหลายตัวบนโฮสต์เดียวกัน ควรแยก Network ของแต่ละแอปพลิเคชันออกจากกัน เพื่อเพิ่มความปลอดภัย

- External Networks: หากต้องการเชื่อมต่อกับ Infrastructure ภายนอก (เช่น Database Server ที่ไม่ได้รันใน Docker) สามารถกำหนด

external: trueใน Network Definition ได้

# ตัวอย่างการใช้ Custom Network

networks:

app-network:

driver: bridge # default driver for single host

# optional: configure IPAM for specific subnet

ipam:

driver: default

config:

- subnet: 172.20.0.0/24

# ... service definitions

services:

web:

networks:

- app-network

api:

networks:

- app-network

db:

networks:

- app-network

การปรับแต่ง Docker Compose สำหรับประสิทธิภาพและความเสถียรใน Production

เพื่อให้แอปพลิเคชันของเราทำงานได้อย่างราบรื่นและทนทานใน Production เราต้องปรับแต่งการตั้งค่าต่างๆ อย่างละเอียดครับ

การกำหนด Resource Limits (CPU, Memory)

การจำกัดทรัพยากรที่คอนเทนเนอร์สามารถใช้ได้เป็นสิ่งสำคัญเพื่อป้องกันไม่ให้บริการใดบริการหนึ่งใช้ทรัพยากรมากเกินไปจนส่งผลกระทบต่อบริการอื่นๆ หรือทำให้ระบบล่มครับ

cpus: กำหนดจำนวน CPU cores ที่คอนเทนเนอร์สามารถใช้ได้ เช่น'0.5'หมายถึง 50% ของ 1 CPU corememory: กำหนดขีดจำกัดสูงสุดของ RAM ที่คอนเทนเนอร์สามารถใช้ได้ (e.g.,512M,1G)mem_reservation: กำหนดจำนวน RAM ที่ Docker จะพยายามสำรองไว้สำหรับคอนเทนเนอร์เสมอ

services:

api:

image: myapp/api:latest

deploy: # ใช้ deploy key สำหรับ resource limits

resources:

limits:

cpus: '1.0' # สูงสุด 1 CPU core

memory: 1024M # สูงสุด 1GB RAM

reservations:

cpus: '0.25' # สำรองไว้ 0.25 CPU cores

memory: 512M # สำรองไว้ 512MB RAM

# ...

Restart Policies เพื่อความทนทาน

การกำหนด restart policy ช่วยให้คอนเทนเนอร์เริ่มต้นใหม่โดยอัตโนมัติหากเกิดความล้มเหลว หรือเมื่อ Docker daemon เริ่มต้นใหม่ ซึ่งเป็นสิ่งจำเป็นใน Production ครับ

no: ไม่มีการรีสตาร์ทอัตโนมัติ (Default)on-failure: รีสตาร์ทเฉพาะเมื่อคอนเทนเนอร์ Exit ด้วย Non-zero Exit Codealways: รีสตาร์ทเสมอ แม้คอนเทนเนอร์จะ Exit ด้วย Zero Exit Code (มักใช้กับบริการที่ไม่ต้องการ Manual Start/Stop)unless-stopped: รีสตาร์ทเสมอ ยกเว้นว่าถูกหยุดด้วยคำสั่งdocker stopหรือdocker compose stop

แนะนำให้ใช้ restart: always หรือ restart: unless-stopped สำหรับบริการใน Production ครับ

services:

web:

image: myapp/web:latest

restart: unless-stopped # แนะนำสำหรับ Production

# ...

Health Checks สำหรับความพร้อมใช้งาน

healthcheck เป็นฟีเจอร์สำคัญที่ช่วยให้ Docker ทราบว่าบริการของเราพร้อมใช้งานจริงหรือไม่ ไม่ใช่แค่รันอยู่เฉยๆ แต่ยังสามารถตอบสนองต่อ Request ได้

services:

api:

image: myapp/api:latest

healthcheck:

test: ["CMD-SHELL", "curl -f http://localhost/health || exit 1"] # ตรวจสอบ Health Endpoint

interval: 30s # ตรวจสอบทุก 30 วินาที

timeout: 10s # รอการตอบสนองสูงสุด 10 วินาที

retries: 3 # หากล้มเหลว 3 ครั้ง ถือว่าไม่ Healthy

start_period: 20s # ช่วงเวลาที่คอนเทนเนอร์เพิ่งเริ่มต้น ไม่นับรวมใน retries

# ...

การใช้ Health Checks ช่วยให้บริการอื่นๆ ที่ depends_on บริการนี้สามารถรอจนกว่าบริการจะพร้อมใช้งานจริง ซึ่งช่วยลดปัญหา “Service Unavailable” ในช่วงเริ่มต้นครับ

การจัดการ Log ที่มีประสิทธิภาพ

การจัดการ Log ใน Production เป็นสิ่งจำเป็นสำหรับการ Debug และ Monitoring ครับ

- Logging Drivers: Docker Compose อนุญาตให้เรากำหนด Logging Driver ได้ (เช่น

json-file,syslog,fluentd,awslogs) - Centralized Logging: สำหรับ Production แนะนำให้ส่ง Log ไปยัง Centralized Logging System เช่น ELK Stack (Elasticsearch, Logstash, Kibana), Grafana Loki หรือ Cloud Logging Services (AWS CloudWatch, Google Cloud Logging)

services:

api:

image: myapp/api:latest

logging:

driver: "fluentd" # หรือ "json-file", "syslog"

options:

fluentd-address: localhost:24224 # ที่อยู่ของ Fluentd Collector

tag: "docker.api.{{.ID}}"

max-size: "10m" # สำหรับ json-file driver

max-file: "5" # สำหรับ json-file driver

# ...

การ Optimize Docker Images

Docker Image ที่มีขนาดเล็กและสร้างอย่างมีประสิทธิภาพจะช่วยลดเวลาในการ Build, Push, Pull, และ Deploy ครับ

- Multi-stage Builds: ใช้ Multi-stage Builds ใน Dockerfile เพื่อแยก Build Environment ออกจาก Runtime Environment ทำให้ Image สุดท้ายมีเฉพาะสิ่งที่จำเป็น

- Smaller Base Images: ใช้ Base Image ขนาดเล็ก เช่น Alpine Linux (

node:alpine,python:alpine) - Remove Unnecessary Files: ลบไฟล์ที่ไม่จำเป็นออกจาก Image

- Leverage Layer Caching: จัดเรียงคำสั่งใน Dockerfile ให้คำสั่งที่ไม่ค่อยเปลี่ยนแปลงอยู่ด้านบน เพื่อให้ Docker สามารถใช้ Layer Caching ได้อย่างมีประสิทธิภาพ

การจัดการ Volume อย่างเหมาะสม

สำหรับข้อมูลที่ต้องคงอยู่ถาวร (Persistent Data) เช่น Database หรือไฟล์ที่ผู้ใช้ Upload มา ควรใช้ Docker Volumes ครับ

- Bind Mounts: เหมาะสำหรับ Configuration Files, Source Code (ใน Dev) หรือการ Mount Directory เฉพาะเจาะจงบนโฮสต์ไปยังคอนเทนเนอร์ใน Production (เช่น

/mnt/data/prod-db:/var/lib/postgresql/data) - Named Volumes: เหมาะสำหรับข้อมูลที่ไม่ต้องการให้ผูกติดกับ Path บนโฮสต์โดยตรง Docker จะจัดการ Location ให้เอง (เช่น

db_data:/var/lib/postgresql/data) - Permissions: ตรวจสอบสิทธิ์การเข้าถึงไฟล์และ Folder บน Volume ให้ถูกต้อง เพื่อป้องกันปัญหา Permission Denied

- Network Storage: ในบางกรณี อาจจำเป็นต้องใช้ Network Storage Solutions (เช่น NFS, AWS EFS) ร่วมกับ Docker Volumes เพื่อความยืดหยุ่นและการสำรองข้อมูลที่ดีขึ้น

อ่านเพิ่มเติมเกี่ยวกับการจัดการ Docker Volumes

กลยุทธ์การ Deploy และ Update แอปพลิเคชันด้วย Docker Compose

การ Deploy และ Update แอปพลิเคชันใน Production ต้องทำอย่างระมัดระวังเพื่อให้เกิด Downtime น้อยที่สุดและสามารถ Rollback ได้ง่าย

Zero-downtime Deployment (แนวทางสำหรับ Compose)

การทำ Zero-downtime Deployment ด้วย Docker Compose บน Single Host นั้นค่อนข้างท้าทายกว่าเมื่อเทียบกับ Orchestrator อย่าง Kubernetes ที่มี Rolling Updates ในตัวครับ อย่างไรก็ตาม เราสามารถใช้เทคนิคบางอย่างเพื่อลด Downtime ได้

- Graceful Shutdown: ตรวจสอบให้แน่ใจว่าแอปพลิเคชันของคุณรองรับ Graceful Shutdown (เช่น การรอให้ Request ที่กำลังประมวลผลอยู่เสร็จก่อนที่จะปิดตัวลง) Docker จะส่ง SIGTERM ไปยังคอนเทนเนอร์ก่อน SIGKILL

- Pre-pull Images: ก่อนที่จะรัน

docker compose upให้ใช้docker compose pullเพื่อดึง Image เวอร์ชันใหม่มาเก็บไว้ล่วงหน้า จะช่วยลดเวลาในการ Deploy - Reverse Proxy (Nginx/Traefik): ใช้ Reverse Proxy เป็นด่านหน้า เมื่ออัปเดตแอปพลิเคชัน ให้ Reverse Proxy ชี้ไปยังคอนเทนเนอร์เวอร์ชันเก่าจนกว่าคอนเทนเนอร์เวอร์ชันใหม่จะพร้อม จากนั้นค่อยเปลี่ยนไปชี้คอนเทนเนอร์ใหม่ (Blue/Green Deployment แบบแมนนวล)

depends_onและhealthcheck: ใช้depends_onร่วมกับcondition: service_healthyเพื่อให้บริการเริ่มต้นตามลำดับและรอจนกว่าบริการจะพร้อมใช้งานจริง

# ตัวอย่างขั้นตอนการอัปเดต

# 1. ดึง Image ใหม่ทั้งหมด

docker compose -f docker-compose.yml -f docker-compose.prod.yml pull

# 2. รันคอนเทนเนอร์ใหม่ (Docker จะหยุดและลบคอนเทนเนอร์เก่า และสร้างใหม่)

# การใช้ --no-build จะช่วยให้ไม่ Build Image ซ้ำ

docker compose -f docker-compose.yml -f docker-compose.prod.yml up -d --no-build

# 3. ตรวจสอบสถานะ (เช่น ตรวจสอบ Health Endpoint ของแอปพลิเคชัน)

# หากใช้ Reverse Proxy, อาจจะต้องสลับ Traffic ไปยังเวอร์ชันใหม่

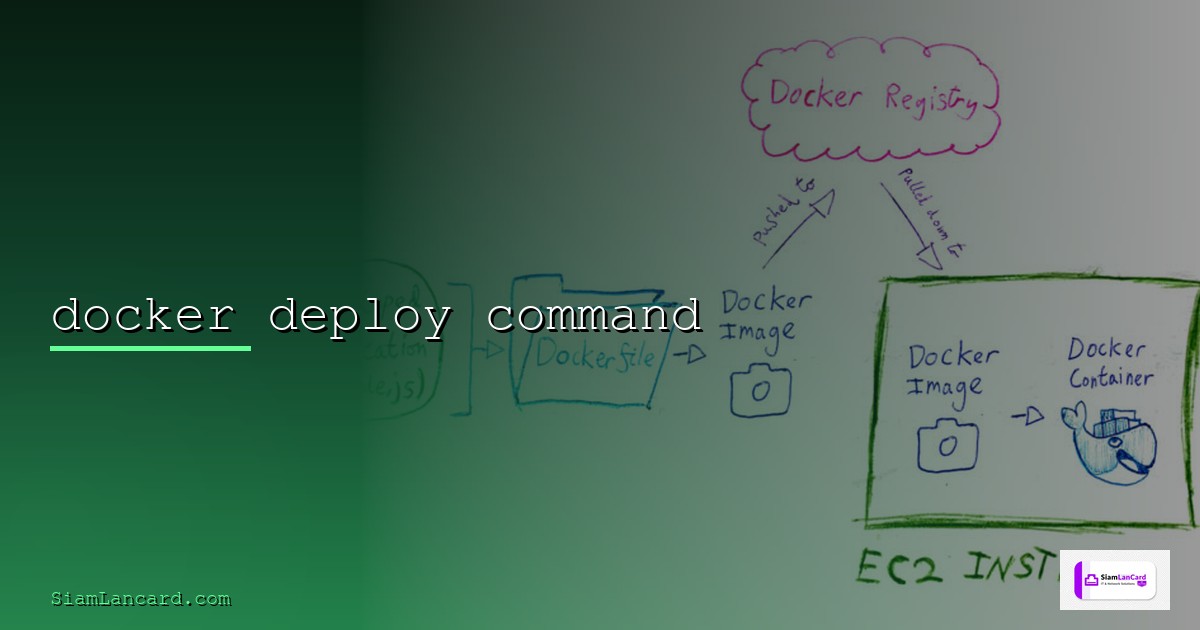

การผสานรวมกับ CI/CD Pipeline

การใช้ CI/CD (Continuous Integration/Continuous Deployment) Pipeline เป็นสิ่งสำคัญใน Production เพื่อให้กระบวนการ Deploy เป็นไปโดยอัตโนมัติและสม่ำเสมอ

- Build Images: ใน CI/CD Pipeline ให้ Build Docker Images สำหรับแต่ละบริการ

- Push to Registry: Push Images ที่ Build เสร็จแล้วไปยัง Container Registry (Docker Hub, AWS ECR, GitLab Container Registry)

- SSH to Server: ใช้ SSH เชื่อมต่อไปยัง Production Server

- Pull and Deploy: รันคำสั่ง

docker compose pull && docker compose up -dบน Production Server - Automated Tests: รัน Automated Tests (Unit, Integration, E2E) ก่อนและหลังการ Deploy

ตัวอย่าง Workflow ใน GitHub Actions:

name: Deploy to Production

on:

push:

branches:

- main

jobs:

deploy:

runs-on: ubuntu-latest

environment: production # ใช้ GitHub Environments

steps:

- name: Checkout code

uses: actions/checkout@v3

- name: Set up Docker BuildX

uses: docker/setup-buildx-action@v2

- name: Login to Docker Hub

uses: docker/login-action@v2

with:

username: ${{ secrets.DOCKER_USERNAME }}

password: ${{ secrets.DOCKER_PASSWORD }}

- name: Build and push backend image

uses: docker/build-push-action@v4

with:

context: ./api

push: true

tags: myapp/api:latest

- name: Build and push frontend image

uses: docker/build-push-action@v4

with:

context: ./web

push: true

tags: myapp/web:latest

- name: Deploy to Production Server

uses: appleboy/ssh-action@master

with:

host: ${{ secrets.PROD_HOST }}

username: ${{ secrets.PROD_USER }}

key: ${{ secrets.PROD_SSH_KEY }}

script: |

cd /path/to/your/app

# ดึง .env.prod และ secrets จาก secure storage หรือ Environment Variables ของ Runner

echo "DB_USER=${{ secrets.DB_USER }}" > .env.prod

echo "DB_PASSWORD=${{ secrets.DB_PASSWORD }}" >> .env.prod

echo "API_KEY_STRIPE=${{ secrets.STRIPE_API_KEY }}" > secrets/stripe_key_prod.txt

docker compose -f docker-compose.yml -f docker-compose.prod.yml pull

docker compose -f docker-compose.yml -f docker-compose.prod.yml up -d --no-build

docker system prune -f # ลบ Image เก่าที่ไม่ใช้งาน

กลยุทธ์การ Rollback

ความสามารถในการ Rollback ไปยังเวอร์ชันที่เสถียรล่าสุดเป็นสิ่งสำคัญเมื่อเกิดปัญหาหลังการ Deploy

- Image Tagging: ใช้ Image Tag ที่มีความหมาย (เช่น

myapp/api:1.0.1,myapp/api:latest) เพื่อให้สามารถระบุและดึง Image เวอร์ชันเก่ามาใช้งานได้ - Versioned Compose Files: เก็บไฟล์

docker-compose.ymlของแต่ละเวอร์ชันไว้ใน Version Control System (Git) เมื่อต้องการ Rollback ก็แค่ Checkout ไฟล์ Compose ของเวอร์ชันก่อนหน้า แล้วรันdocker compose up -dใหม่

# ตัวอย่างการ Rollback

# สมมติว่าเวอร์ชันล่าสุด (v2.0) มีปัญหา ต้องการกลับไป v1.0

# 1. แก้ไขไฟล์ docker-compose.prod.yml ให้ชี้ไปยัง Image v1.0

# หรือ Checkout ไฟล์ Compose ของ v1.0 จาก Git

# เช่น เปลี่ยน image: myapp/api:latest เป็น image: myapp/api:1.0

# 2. Deploy ใหม่

docker compose -f docker-compose.yml -f docker-compose.prod.yml pull

docker compose -f docker-compose.yml -f docker-compose.prod.yml up -d --no-build

อ่านเพิ่มเติมเกี่ยวกับการทำ CI/CD สำหรับ Docker

การจัดการ Secrets ใน Production ด้วย Docker Compose

ข้อมูลที่อ่อนไหว (Secrets) เช่น รหัสผ่านฐานข้อมูล, API Keys, หรือ Private Keys ไม่ควรถูก Hardcode ไว้ในไฟล์ Compose หรือ Environment Variables ที่มองเห็นได้โดยง่าย การจัดการ Secrets อย่างปลอดภัยเป็นสิ่งสำคัญสูงสุดใน Production ครับ

Docker Compose มีฟีเจอร์ secrets ที่ช่วยจัดการข้อมูลลับได้ดีขึ้น

version: '3.8'

services:

api:

image: myapp/api:latest

environment:

# ใช้ชื่อ secret เป็น environment variable

DATABASE_PASSWORD_FILE: /run/secrets/db_password

secrets:

- db_password

- api_key_stripe

# ...

secrets:

db_password:

file: /path/to/host/secrets/db_password.txt # Path บนโฮสต์ที่เก็บไฟล์ secret

api_key_stripe:

file: /path/to/host/secrets/stripe_key.txt

เมื่อคอนเทนเนอร์ api เริ่มต้น Docker จะ Mount ไฟล์ Secret เหล่านั้นไปยัง /run/secrets/db_password และ /run/secrets/api_key_stripe ภายในคอนเทนเนอร์ แอปพลิเคชันของคุณสามารถอ่านค่าจากไฟล์เหล่านี้ได้โดยตรง

ข้อควรพิจารณาเพิ่มเติมในการจัดการ Secrets:

- Permissions: ตรวจสอบให้แน่ใจว่าไฟล์ Secret บนโฮสต์มี Permission ที่จำกัดการเข้าถึงเฉพาะผู้ใช้ที่จำเป็นเท่านั้น

- External Secret Management: สำหรับ Production ที่มีความซับซ้อนสูง อาจพิจารณาใช้ External Secret Management Tools เช่น HashiCorp Vault, AWS Secrets Manager, Google Secret Manager หรือ Azure Key Vault โดยดึง Secret มาใส่ในไฟล์ชั่วคราวบนโฮสต์ก่อนรัน Compose

- Environment Variables จาก CI/CD: ใน CI/CD Pipeline สามารถส่ง Secret เป็น Environment Variables ไปยัง Runner ได้ แต่ควรระมัดระวังไม่ให้ Secret เหล่านั้นถูกพิมพ์ลงใน Log หรือเก็บไว้ในไฟล์ที่ไม่ปลอดภัย

“Never put secrets directly into your version control system. Always use a dedicated secrets management solution or environment variables with proper access controls.”

การ Monitoring และ Troubleshooting แอปพลิเคชันบน Docker Compose

การเฝ้าระวัง (Monitoring) และแก้ไขปัญหา (Troubleshooting) เป็นสิ่งสำคัญในการดูแล Production Environment ให้ทำงานได้อย่างราบรื่นครับ

Centralized Logging

การรวบรวม Log จากทุกบริการไปยังที่เดียวช่วยให้เราสามารถค้นหา, วิเคราะห์, และเฝ้าระวังปัญหาได้อย่างมีประสิทธิภาพ

- ELK Stack (Elasticsearch, Logstash, Kibana): เป็นชุดเครื่องมือยอดนิยมสำหรับ Centralized Logging

- Grafana Loki: เป็นระบบ Logging ที่ออกแบบมาสำหรับ Kubernetes โดยเฉพาะ แต่ก็สามารถใช้กับ Docker Compose ได้ดีเช่นกัน

- Cloud Logging Services: เช่น AWS CloudWatch Logs, Google Cloud Logging, Azure Monitor Logs

คุณสามารถใช้ Fluentd หรือ Filebeat เป็น Agent ในคอนเทนเนอร์แยกต่างหาก หรือกำหนด Logging Driver ในไฟล์ Compose เพื่อส่ง Log ไปยัง Centralized Logging System ได้ครับ

services:

api:

image: myapp/api:latest

logging:

driver: "fluentd"

options:

fluentd-address: fluentd:24224

tag: "docker.api.{{.ID}}"

# ...

fluentd:

image: fluent/fluentd:latest

volumes:

- ./fluentd/conf:/fluentd/etc

ports:

- "24224:24224"

- "24224:24224/udp"

networks:

- app-network

# ...

การเก็บ Metrics และ Alerting

การเก็บ Metrics (เช่น CPU Usage, Memory Usage, Request Rate, Error Rate) ช่วยให้เราเข้าใจพฤติกรรมของแอปพลิเคชันและสามารถตรวจจับปัญหาได้ตั้งแต่เนิ่นๆ

- Prometheus + Grafana: เป็นชุดเครื่องมือมาตรฐานสำหรับการเก็บ Metrics และสร้าง Dashboard ที่สวยงาม

- cAdvisor: สามารถใช้ cAdvisor เพื่อเก็บ Metrics ของคอนเทนเนอร์แต่ละตัว

- Node Exporter: เพื่อเก็บ Metrics ของโฮสต์

- Application-specific Exporters: สำหรับ Metrics ของ Database, Redis หรือแอปพลิเคชันของคุณเอง

# ตัวอย่างการรัน Prometheus และ Grafana ด้วย Docker Compose

services:

prometheus:

image: prom/prometheus:latest

volumes:

- ./prometheus/prometheus.yml:/etc/prometheus/prometheus.yml:ro

- prometheus_data:/prometheus

ports:

- "9090:9090"

command:

- '--config.file=/etc/prometheus/prometheus.yml'

- '--storage.tsdb.path=/prometheus'

networks:

- monitoring-network

restart: always

grafana:

image: grafana/grafana:latest

volumes:

- grafana_data:/var/lib/grafana

ports:

- "3000:3000"

environment:

GF_SECURITY_ADMIN_USER: admin

GF_SECURITY_ADMIN_PASSWORD: password_secure_it

networks:

- monitoring-network

restart: always

# สมมติว่ามี Node Exporter และ cAdvisor

node-exporter:

image: prom/node-exporter:latest

ports:

- "9100:9100"

networks:

- monitoring-network

restart: always

pid: "host" # ต้องใช้ host PID namespace เพื่อเข้าถึงข้อมูลของโฮสต์

volumes:

- /proc:/host/proc:ro

- /sys:/host/sys:ro

- /:/rootfs:ro

cadvisor:

image: gcr.io/cadvisor/cadvisor:latest

ports:

- "8080:8080"

volumes:

- /:/rootfs:ro

- /var/run:/var/run:rw

- /sys:/sys:ro

- /var/lib/docker:/var/lib/docker:ro

networks:

- monitoring-network

restart: always

networks:

monitoring-network:

driver: bridge

volumes:

prometheus_data:

grafana_data:

ในไฟล์ prometheus.yml คุณจะต้องเพิ่ม Target สำหรับ Scrape Metrics จากบริการต่างๆ เช่น Node Exporter, cAdvisor และแอปพลิเคชันของคุณเอง

เครื่องมือสำหรับการ Debugging

docker compose logs -f: ดู Log แบบ Real-time ของบริการใดบริการหนึ่งdocker compose exec: เข้าไปรันคำสั่งในคอนเทนเนอร์ที่กำลังทำงานอยู่ (เช่นdocker compose exec api bash) เพื่อตรวจสอบไฟล์, Process, หรือ Debuggingdocker inspect: ดูรายละเอียดทั้งหมดของคอนเทนเนอร์ รวมถึง Network Configuration, Volumes, Environment Variables และสถานะ Health Checkdocker stats: ดูการใช้ทรัพยากร (CPU, Memory, Network I/O) ของคอนเทนเนอร์ทั้งหมดแบบ Real-time

Docker Compose กับอนาคตของ Container Orchestration (2026 Perspective)

ในปี 2026 Docker Compose ยังคงมีวิวัฒนาการและบทบาทที่สำคัญครับ

- Compose Specification: Docker Compose ได้ถูกพัฒนาเป็น Open Standard ภายใต้ชื่อ Compose Specification ซึ่งหมายความว่ามันไม่ได้ผูกติดอยู่กับ Docker Engine เพียงอย่างเดียว แต่สามารถนำไปใช้กับ Orchestration Engine อื่นๆ ได้ด้วย ทำให้มีความยืดหยุ่นมากขึ้น

- Cloud Integration: บริการคลาวด์หลายแห่งได้เริ่มรองรับ Compose แล้ว เช่น AWS ECS Compose CLI ที่ช่วยให้ Deploy Compose Files ไปยัง Amazon ECS ได้, หรือ Azure Container Apps ที่รองรับการ Deploy จาก Compose File สิ่งนี้ทำให้ Compose เป็นสะพานเชื่อมที่ดีสำหรับผู้ที่ต้องการย้ายจาก On-premise Compose ไปยัง Cloud Services

- Stepping Stone to Kubernetes/Swarm: Docker Compose ยังคงเป็นจุดเริ่มต้นที่ดีสำหรับนักพัฒนาและทีมเล็กๆ ในการเรียนรู้ Containerization และ Orchestration ก่อนที่จะก้าวไปสู่แพลตฟอร์มที่ซับซ้อนกว่าอย่าง Kubernetes หรือ Docker Swarm เมื่อความต้องการด้าน Scale และ High Availability เพิ่มขึ้น

- Simplicity for Specific Use Cases: สำหรับแอปพลิเคชันที่มีขนาดไม่ใหญ่มาก, Microservices ที่รันบนเซิร์ฟเวอร์เดี่ยว, หรือการสร้าง Development Environment ที่สอดคล้องกับ Production, Docker Compose ยังคงเป็นตัวเลือกที่ไม่มีใครเทียบได้ในเรื่องของความง่ายในการใช้งานและการตั้งค่าครับ

ดังนั้นในปี 2026 Docker Compose ไม่ได้หายไปไหน แต่กลับแข็งแกร่งขึ้นด้วยมาตรฐานที่เปิดกว้างและการสนับสนุนจาก Cloud Provider ซึ่งทำให้มันยังคงเป็นเครื่องมือที่ทรงพลังและมีประโยชน์ใน Ecosystem ของ Containerization ครับ

ตารางเปรียบเทียบ: Docker Compose vs. Kubernetes (สำหรับ Production)

การเลือกใช้ระหว่าง Docker Compose และ Kubernetes สำหรับ Production ขึ้นอยู่กับความต้องการและบริบทของโปรเจกต์ของคุณครับ ตารางนี้จะช่วยให้คุณเห็นภาพความแตกต่างที่สำคัญ

| คุณสมบัติ | Docker Compose | Kubernetes |

|---|---|---|

| ความซับซ้อน | ต่ำ – ง่ายต่อการเรียนรู้และใช้งาน เหมาะสำหรับผู้เริ่มต้นและทีมขนาดเล็ก | สูง – มี Learning Curve ที่ชันกว่า ต้องทำความเข้าใจแนวคิดจำนวนมาก |

| การจัดการ Orchestration | ส่วนใหญ่เน้น Single-Host หรือการจัดการด้วยตนเองบนหลายโฮสต์ (แต่ไม่ใช่ Distributed Orchestration ในตัว) | Distributed Orchestration เต็มรูปแบบ รองรับ Multi-Host Cluster และจัดการ Node Failures |

| Scalability | จำกัด – การ Scale ต้องทำด้วยตนเองหรือใช้เครื่องมือภายนอก (เช่น Load Balancer) | สูง – ออกแบบมาเพื่อ Scale ได้อย่างง่ายดายและอัตโนมัติ (Horizontal Pod Autoscaling) |

| High Availability (HA) | จำกัด – ไม่ได้มี HA ในตัว ต้องใช้เทคนิคภายนอก หรือ Redundancy ของโฮสต์ | สูง – มี HA ในตัวสำหรับ Control Plane และ Workloads (ReplicaSets, Deployments) |

| Zero-downtime Deployment | เป็นไปได้ แต่ต้องใช้เทคนิคเพิ่มเติมและอาจซับซ้อน (เช่น Blue/Green Manual) | มี Rolling Updates ในตัว ทำ Zero-downtime Deployment ได้ง่าย |

| Resource Management | จำกัดการกำหนด Resource Limits ต่อคอนเทนเนอร์ | ละเอียดและยืดหยุ่นกว่า (Requests, Limits, Quality of Service) |

| Service Discovery & Load Balancing | ต้องตั้งค่าด้วยตนเอง (เช่น ใช้ Nginx/Traefik ใน Compose) | มี Service Discovery และ Internal Load Balancing ในตัว |

| Secrets Management | มีฟีเจอร์ secrets ในตัว หรือใช้ไฟล์จากโฮสต์ |

มี Secrets Object ที่เข้ารหัสและจัดการได้ดีกว่า |

| Community & Ecosystem | ดีและใช้งานได้จริง | ใหญ่โตและเติบโตอย่างรวดเร็ว มีเครื่องมือและ Ecosystem ที่กว้างขวาง |

| Use Cases ที่เหมาะสม |

|

|

โดยสรุปคือ หากคุณต้องการความเรียบง่าย รวดเร็ว และแอปพลิเคชันของคุณไม่ได้ต้องการ Scale หรือ HA ที่ซับซ้อนมาก Docker Compose เป็นตัวเลือกที่ยอดเยี่ยม แต่หากคุณกำลังสร้างระบบที่ต้องการ Scale สูง, HA ระดับองค์กร, และมีทรัพยากรทีม DevOps พร้อม Kubernetes คือคำตอบครับ

ตัวอย่าง Docker Compose สำหรับ Production จริง

เรามาดูตัวอย่างไฟล์ Docker Compose สำหรับแอปพลิเคชัน Production จริง ที่ประกอบด้วย Node.js API, Nginx Reverse Proxy, PostgreSQL Database และ Redis Cache ครับ

# docker-compose.yml (ไฟล์หลัก - Base Configuration)

version: '3.8'

services:

nginx:

image: nginx:stable-alpine

networks:

- app-network

restart: unless-stopped

volumes:

- ./nginx/nginx.conf:/etc/nginx/nginx.conf:ro

- ./nginx/certs:/etc/nginx/certs:ro # สำหรับ SSL/TLS

depends_on:

api:

condition: service_healthy # รอ API พร้อมใช้งาน

api:

build:

context: ./api # Dockerfile สำหรับ Node.js API

dockerfile: Dockerfile

networks:

- app-network

restart: unless-stopped

healthcheck:

test: ["CMD-SHELL", "curl -f http://localhost:3000/health || exit 1"]

interval: 10s

timeout: 5s

retries: 5

start_period: 20s

depends_on:

db:

condition: service_healthy

redis:

condition: service_started

db:

image: postgres:13-alpine

networks:

- app-network

restart: unless-stopped

healthcheck:

test: ["CMD-SHELL", "pg_isready -U ${DB_USER} -d ${DB_NAME}"]

interval: 10s

timeout: 5s

retries: 5

start_period: 30s

redis:

image: redis:6-alpine

networks:

- app-network

restart: unless-stopped

command: redis-server --appendonly yes # เปิด AOF สำหรับ Persistent Data

healthcheck:

test: ["CMD", "redis-cli", "ping"]

interval: 5s

timeout: 3s

retries: 5

networks:

app-network:

driver: bridge

volumes:

db_data:

redis_data:

# docker-compose.prod.yml (ไฟล์สำหรับ Production - Override และเพิ่ม Production-specific settings)

version: '3.8'

services:

nginx:

ports:

- "80:80"

- "443:443"

environment:

# ตั้งค่า Nginx สำหรับ Production เช่น Access Log format

NGINX_HOST: example.com

api:

environment:

NODE_ENV: production

DATABASE_URL: postgresql://${DB_USER}:${DB_PASSWORD}@db:5432/${DB_NAME}

REDIS_URL: redis://redis:6379

JWT_SECRET: ${JWT_SECRET} # อ่านจาก Secret

secrets:

- jwt_secret_key

- stripe_api_key

volumes:

- api_logs:/app/logs # เก็บ Log ของ API ใน Volume แยก

deploy:

resources:

limits:

cpus: '1.0'

memory: 1024M

reservations:

cpus: '0.5'

memory: 512M

# expose: - "3000" # ไม่จำเป็นต้องเปิด Port สู่ภายนอกโดยตรง เพราะ Nginx จะจัดการให้

db:

environment:

POSTGRES_USER: ${DB_USER}

POSTGRES_PASSWORD: ${DB_PASSWORD}

POSTGRES_DB: ${DB_NAME}

volumes:

- /mnt/prod-data/postgresql:/var/lib/postgresql/data # Bind Mount ไปยัง Host Path จริง

deploy:

resources:

limits:

cpus: '1.5'

memory: 2048M

reservations:

cpus: '0.75'

memory: 1024M

redis:

volumes:

- /mnt/prod-data/redis:/data # Bind Mount ไปยัง Host Path จริง

deploy:

resources:

limits:

cpus: '0.5'

memory: 256M

reservations:

cpus: '0.25'

memory: 128M

secrets:

jwt_secret_key:

file: ./secrets/jwt_secret_prod.txt

stripe_api_key:

file: ./secrets/stripe_key_prod.txt

volumes:

api_logs: # Volume สำหรับ Log ของ API

# ./nginx/nginx.conf (ตัวอย่าง Nginx Configuration)

user nginx;

worker_processes auto;

events {

worker_connections 1024;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log /var/log/nginx/access.log main;

error_log /var/log/nginx/error.log warn;

sendfile on;

keepalive_timeout 65;

gzip on;

gzip_vary on;

gzip_proxied any;

gzip_comp_level 6;

gzip_buffers 16 8k;

gzip_http_version 1.1;

gzip_types text/plain text/css application/json application/javascript text/xml application/xml application/xml+rss text/javascript;

upstream api_backend {

server api:3000; # ชี้ไปยังชื่อบริการ 'api' และ Port 3000 ภายใน Docker Network

keepalive 64;

}

server {

listen 80;

listen 443 ssl;

server_name example.com; # หรือ IP Address ของคุณ

ssl_certificate /etc/nginx/certs/fullchain.pem;

ssl_certificate_key /etc/nginx/certs/privkey.pem;

ssl_protocols TLSv1.2 TLSv1.3;

ssl_ciphers 'TLS_AES_128_GCM_SHA256:TLS_AES_256_GCM_SHA384:TLS_CHACHA20_POLY1305_SHA256:ECDHE-RSA-AES128-GCM-SHA256:ECDHE-RSA-AES256-GCM-SHA384';

ssl_prefer_server_ciphers on;

ssl_session_cache shared:SSL:10m;

ssl_session_timeout 1d;

ssl_session_tickets off;

ssl_stapling on;

ssl_stapling_verify on;

resolver 8.8.8.8 8.8.4.4 valid=300s;

resolver_timeout 5s;

# Redirect HTTP to HTTPS

if ($scheme = http) {

return 301 https://$host$request_uri;

}

location / {

proxy_pass http://api_backend;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

proxy_connect_timeout 60s;

proxy_read_timeout 60s;

proxy_send_timeout 60s;

}

# Optional: serve static files directly if you have them in nginx container

# location /static/ {

# alias /usr/share/nginx/html/static/;

# expires 30d;

# add_header Cache-Control "public, no-transform";

# }

}

}

ในการรัน:

# สร้างไฟล์ .env.prod สำหรับ Environment Variables (ไม่ควร Commit เข้าระบบ Git)

echo "DB_USER=myuser" > .env.prod

echo "DB_PASSWORD=secure_password" >> .env.prod

echo "DB_NAME=mydatabase" >> .env.prod

# สร้างไฟล์ Secrets (ไม่ควร Commit เข้าระบบ Git)

mkdir -p secrets

echo "my_jwt_secret_123" > secrets/jwt_secret_prod.txt

echo "sk_live_XXXXXXXXXXXXXXXXXXXXXXXX" > secrets/stripe_key_prod.txt

# รัน Docker Compose สำหรับ Production

docker compose -f docker-compose.yml -f docker-compose.prod.yml --env-file .env.prod up -d --build

ตัวอย่างนี้แสดงให้เห็นถึงการใช้ฟีเจอร์ต่างๆ เช่น Multiple Compose Files, Health Checks, Resource Limits, Secrets และการใช้ Reverse Proxy เพื่อสร้าง Production Environment ที่แข็งแกร่งครับ

FAQ (คำถามที่พบบ่อย)

1. Docker Compose เหมาะกับ Production ขนาดใหญ่ไหมครับ?

โดยทั่วไปแล้ว Docker Compose เหมาะสำหรับ Production ขนาดเล็กถึงกลาง หรือแอปพลิเคชันที่ต้องการรันบนเซิร์ฟเวอร์เดี่ยวครับ ถ้าคุณมีแอปพลิเคชัน Microservices ที่ซับซ้อนมาก ต้องการการ Scale ระดับสูง, High Availability ข้ามหลายโหนด, หรือมีความต้องการจัดการทรัพยากรที่ละเอียดอ่อนอย่างมาก Kubernetes จะเป็นตัวเลือกที่ดีกว่าครับ แต่สำหรับโปรเจกต์ส่วนใหญ่ Compose ก็เพียงพอแล้วครับ

2. ควรใช้ Docker Compose ร่วมกับ Swarm หรือ Kubernetes ไหมครับ?

Docker Compose ถูกใช้เป็นเครื่องมือสำหรับกำหนด (define) แอปพลิเคชันครับ โดยสามารถนำไฟล์ Compose ไปใช้กับ Docker Swarm (ซึ่งเป็น Orchestrator ของ Docker เอง) ได้โดยตรง หรือใช้เครื่องมืออย่าง Kompose ในการแปลงไฟล์ Compose เป็น Kubernetes Manifest ได้ครับ การใช้ร่วมกันทำให้คุณสามารถเริ่มต้นด้วย Compose ที่ง่ายกว่า แล้วค่อยขยายไปยัง Swarm หรือ Kubernetes เมื่อต้องการฟีเจอร์การ Orchestration ที่ซับซ้อนขึ้นครับ

3. การจัดการ Backup ของ Database ที่รันบน Compose ทำอย่างไรครับ?

สิ่งสำคัญที่สุดคือการใช้ Persistent Volumes สำหรับ Database ครับ เพื่อให้ข้อมูลไม่หายไปพร้อมกับคอนเทนเนอร์ จากนั้นคุณสามารถกำหนด Cron Job บนโฮสต์เพื่อรันสคริปต์ Backup (เช่น pg_dump สำหรับ PostgreSQL) โดยเชื่อมต่อไปยัง Database Container ผ่าน Docker Network หรือใช้คอนเทนเนอร์แยกสำหรับ Backup โดยเฉพาะครับ และอย่าลืมว่าต้องเก็บไฟล์ Backup ไว้ในที่ปลอดภัยและแยกจากเซิร์ฟเวอร์หลักด้วยครับ

4. มีวิธีทำ Zero-downtime deployment ด้วย Compose ไหมครับ?

การทำ Zero-downtime deployment โดยสมบูรณ์ด้วย Compose บน Single Host นั้นทำได้ยากกว่า Orchestrator ที่มี Rolling Updates ในตัวครับ อย่างไรก็ตาม คุณสามารถลด Downtime ได้โดยใช้เทคนิคต่างๆ เช่น การใช้ Reverse Proxy (Nginx/Traefik) เป็นด่านหน้า, การทำให้แอปพลิเคชันรองรับ Graceful Shutdown, และการใช้ docker compose pull && docker compose up -d เพื่อให้ Docker จัดการสร้างคอนเทนเนอร์ใหม่และสลับไปใช้เวอร์ชันใหม่โดยเร็วที่สุดครับ